MCP 是什么?

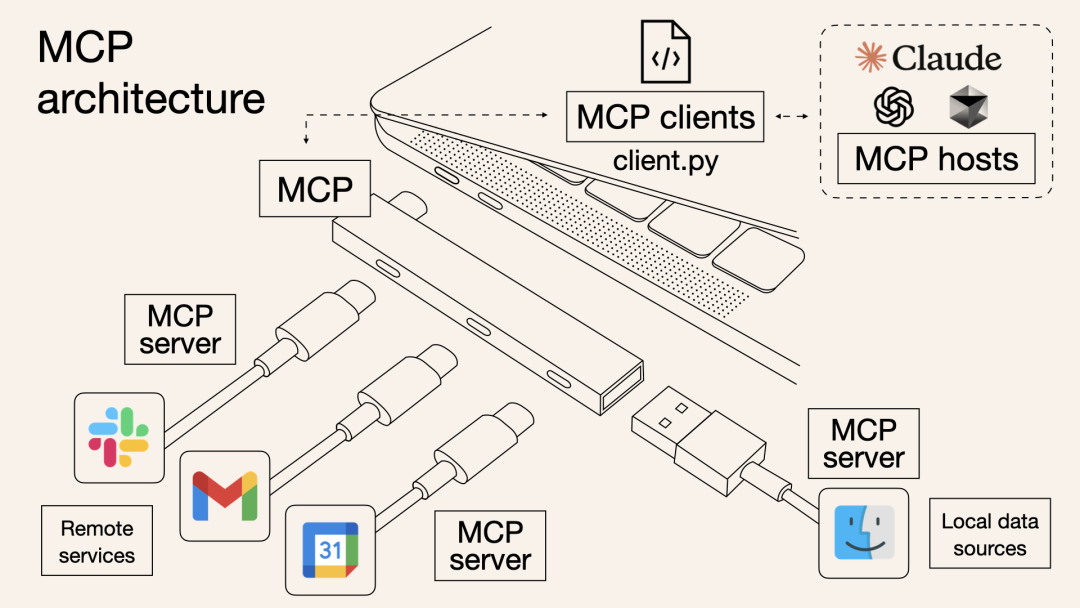

MCP(Model Context Protocol,模型上下文协议)是一种开源通信协议,旨在为大型语言模型(LLM)与外部数据源、工具或服务之间建立标准化、安全且灵活的双向连接。它类似于“AI 的 USB-C 接口”,通过统一的协议规范,简化了 LLM 与数据库、API、文件系统、硬件设备等资源的集成。

MCP 的核心特点

- 标准化:提供通用接口(如 JSON-RPC),替代碎片化的 API 调用方式。

- 双向通信:支持 LLM 主动调用外部工具(如查询数据库),也允许外部系统主动推送数据到模型。

- 安全性:通过权限控制和加密机制保障数据交互的安全性。

- 灵活性:适用于本地资源(如文件系统)和远程服务(如 GitHub、Slack)。

MCP 与 AI Agent 的区别

| 维度 | MCP(Model Context Protocol) | AI Agent(人工智能代理) |

|---|---|---|

| 本质定位 | 标准化通信协议:仅作为工具调用的桥梁,不涉及决策逻辑。 | 自主决策系统:具备任务规划、推理和执行能力。 |

| 技术架构 | 客户端-服务器架构(如 JSON-RPC)。 | 基于 LLM 的任务规划框架(如 LangChain、Autonomous Agents)。 |

| 功能特性 | 被动调用:需外部指令触发(如用户请求)。 | 主动决策:可自主分解任务并调用工具(如自动订票)。 |

| 典型应用场景 | 连接 LLM 与数据库、API、支付系统等。 | 执行复杂任务(如旅行规划、客服对话)。 |

举例说明区别

- MCP 的场景:

用户问“北京天气如何?”,LLM 通过 MCP 调用天气 API 获取数据并返回结果。- MCP 的作用:将请求标准化并转发给天气服务。

- AI Agent 的作用:若用户说“明天下雨就取消会议”,Agent 会自动调用 MCP 查询天气、更新日历并发送邮件通知。

如何应用 MCP?

案例:使用 MCP 实现天气查询

搭建 MCP Server

- 开发一个天气服务的 MCP Server(如 Python 脚本),封装

get_forecast和get_alerts两个工具。 - 示例代码(简化版):

# weather_server.py import uvicorn from fastapi import FastAPI app = FastAPI() @app.get("/forecast") def get_forecast(city: str): # 模拟调用真实天气 API return {"city": city, "temperature": "25°C", "condition": "Sunny"} if __name__ == "__main__": uvicorn.run(app, host="0.0.0.0", port=8000)

- 开发一个天气服务的 MCP Server(如 Python 脚本),封装

配置 MCP Client(如 Cursor IDE)

- 在客户端的

mcp.json文件中注册 Server 地址和工具描述:{ "mcpServers": { "weather": { "url": "http://localhost:8000", "tools": { "get_forecast": { "description": "获取城市天气预报", "parameters": { "city": "str" } } } } } }

- 在客户端的

用户交互流程

- 用户输入:“北京今天天气如何?”

- LLM 分析:识别需要调用

get_forecast工具。 - MCP Client 调用 Server:向

http://localhost:8000/forecast?city=北京发送请求。 - 返回结果:LLM 将 Server 返回的天气信息整合成自然语言回答。

其他应用场景

企业服务:

- 支付系统:支付宝通过 MCP Server 实现自然语言支付(如“给张三转账 100 元”)。

- 智能客服:客服 Agent 通过 MCP 调用订单数据库、物流接口等,自动处理退款请求。

个人助手:

- 日程管理:用户说“下周三下午 3 点开会”,Agent 调用 MCP 更新日历并提醒参会者。

- 智能家居:通过 MCP 控制家电(如“调高空调温度”)。

开发工具:

- 代码生成:Cursor IDE 通过 MCP Server 调用代码仓库(如 GitHub),实现代码补全和文档查询。

总结

- MCP 是 AI 能力与现实世界的“神经接口”,解决 LLM 与外部工具的集成难题。

- AI Agent 是“大脑”,利用 MCP 等工具实现复杂任务的自主执行。

- 两者协同:MCP 提供标准化接口,Agent 利用其构建智能闭环,推动 AI 从“回答问题”到“解决问题”的跃迁。

MCP 与 AI Agent 的核心区别

MCP 无法取代 AI Agent,它是 AI Agent 的重要组成部分。两者在功能定位和作用上存在本质区别,且相互依赖、协同工作。

(1)功能定位不同

MCP(Model Context Protocol)

- 本质:标准化通信协议,负责 LLM 与外部工具/数据源之间的连接。

- 核心能力:提供安全、灵活的接口,实现 LLM 对数据库、API、硬件设备等资源的调用。

- 角色:类似“USB 接口”,是 连接层,解决“如何让 AI 调用外部资源”的问题。

AI Agent(人工智能代理)

- 本质:自主决策系统,具备 感知环境、规划任务、执行动作 的能力。

- 核心能力:基于 LLM 的推理能力,结合记忆、规划、工具调用等模块,完成复杂任务。

- 角色:类似“大脑+双手”,是 决策层和执行层,解决“AI 如何自主完成任务”的问题。

(2)技术层级不同

MCP:

- 处于 基础设施层,专注于标准化通信和接口管理。

- 无需理解任务逻辑,仅需按协议传递请求和返回结果。

AI Agent:

- 处于 应用层,依赖 LLM 进行任务分解、逻辑推理和自主决策。

- 需要理解用户意图、规划步骤,并调用 MCP 等工具完成闭环任务。

为什么 MCP 无法取代 AI Agent

(1)MCP 缺乏自主决策能力

MCP 的被动性:

- 它本身不进行任务规划或决策,仅作为 被动的通信桥梁。

- 例如:用户问“北京天气如何?”,LLM 需要通过 MCP 调用天气 API,但 MCP 无法主动判断“是否需要提醒带伞”。

AI Agent 的主动性:

- AI Agent 可以自主分析需求并调用工具。

- 例如:用户说“明天下雨就取消会议”,Agent 会自动调用 MCP 查询天气、更新日历并发送通知。

(2)MCP 无法处理复杂任务链

- 单点调用 vs 多步骤规划:

- MCP 仅能执行单一工具调用(如调用天气 API),而 AI Agent 可以串联多个步骤(如查天气→查会议→发通知)。

- 如果没有 AI Agent,LLM 无法自主分解任务,只能依赖人工指令逐个调用工具。

(3)MCP 无法替代 LLM 的核心能力

- LLM 的不可替代性:

- AI Agent 的核心是 LLM 提供的自然语言理解、推理和生成能力,而 MCP 仅是 LLM 与外部世界的连接器。

- 即使 MCP 完善,LLM 仍需要 AI Agent 来组织其能力,否则只能作为“问答工具”。

MCP 与 AI Agent 的协同关系

(1)MCP 是 AI Agent 的“手脚”

- 赋能 AI Agent 的行动力:

- AI Agent 通过 MCP 调用工具(如数据库、支付系统、IoT 设备),才能完成实际操作。

- 例如:

- 场景:用户要求“订机票并发送确认邮件”。

- 流程:

- AI Agent 分解任务 →

- 通过 MCP 调用航班 API 查询航班 →

- 通过 MCP 调用支付系统完成付款 →

- 通过 MCP 调用邮件服务发送通知。

(2)AI Agent 是 MCP 的“大脑”

- 驱动 MCP 的调用逻辑:

- MCP 本身不理解任务上下文,AI Agent 需要判断“何时调用哪个工具”。

- 例如:

- 场景:用户问“帮我找附近好吃的川菜”。

- 流程:

- AI Agent 分析用户位置和偏好 →

- 通过 MCP 调用地图 API 获取川菜馆列表 →

- 通过 MCP 调用点评 API 筛选高分餐厅。

实际场景中的对比

| 需求 | 仅使用 MCP 的局限性 | AI Agent + MCP 的解决方案 |

|---|---|---|

| 查询天气并提醒 | 无法判断是否需要提醒,只能返回天气数据。 | Agent 分析天气后,自动推送提醒。 |

| 订票并支付 | 需手动依次调用航班 API 和支付 API。 | Agent 自动串联航班查询、比价、支付流程。 |

| 跨部门协作任务 | 无法协调多个系统(如 HR、财务、项目管理)。 | Agent 通过 MCP 调用各系统接口,统一处理。 |

未来趋势:MCP 与 AI Agent 的深度融合

尽管 MCP 无法取代 AI Agent,但两者的结合将推动 AI 应用的普及:

标准化生态:

- MCP 的标准化接口降低了工具集成的复杂度,使 AI Agent 开发者更聚焦于任务逻辑而非底层通信。

- 例如:开发者无需为每个 API 单独开发适配器,只需调用 MCP 标准接口。

智能化升级:

- AI Agent 通过 MCP 调用更多实时数据(如传感器、IoT 设备),实现物理世界与数字世界的联动。

- 例如:智能家居 Agent 通过 MCP 控制灯光、温控和安防系统。

行业落地加速:

- 在金融、医疗、教育等领域,AI Agent + MCP 可快速构建复杂应用(如自动风控、辅助诊断、个性化教学)。

MCP 是 AI Agent 的关键基础设施,但无法取代 AI Agent。两者的关系类似于“USB 接口与电脑”——MCP 提供连接能力,而 AI Agent 是具备自主决策的完整系统。未来,MCP 的标准化将进一步释放 AI Agent 的潜力,但 AI Agent 的核心价值(自主性、规划能力)仍不可替代。

MCP与Function Calling有什么样的区别

MCP与Function Calling是两种不同的技术方案,服务于大模型(LLM)与外部资源的交互,但它们的设计理念、技术实现和应用场景存在显著差异。

1. 定位与目标

| 维度 | MCP(Model Context Protocol) | Function Calling |

|---|---|---|

| 核心定位 | 开放协议层的基础设施,旨在统一LLM与外部数据源、工具的交互规范,解决碎片化问题。类比为“AI领域的HTTP协议”。 | 特定模型的增值功能,是厂商为LLM设计的私有接口特性,允许模型生成结构化请求调用预定义函数。类比为“品牌专属充电协议”。 |

| 设计目标 | 通过标准化实现安全、可扩展的互联互通,支持本地/远程数据的无缝访问(如文件系统、数据库、Web自动化)。 | 通过函数调用实现任务执行自动化(如调用API、执行代码),但缺乏协议层的通用性。 |

| 适用场景 | 需要连接多数据源、维护长期上下文、处理安全敏感操作的复杂场景(如企业级自动化、医疗诊断、客服机器人)。 | 需要快速获取结果的简单任务(如天气查询、数据库读取、图片生成)。 |

2. 技术实现差异

| 维度 | MCP | Function Calling |

|---|---|---|

| 架构 | 客户端-服务器模式,分离MCP Host(客户端)与MCP Server(服务端),支持异步通信。 | 直接集成于模型API,用户定义函数后由模型触发调用,通常采用同步通信。 |

| 通信规范 | 强制遵循JSON-RPC 2.0标准,强调协议统一性,允许不同服务商通过统一协议接入大模型生态。 | 厂商自定义格式(如OpenAI的JSON参数结构),无强制协议要求,依赖厂商的API规范。 |

| 上下文管理 | 支持多轮对话、历史状态维护,适用于长序列依赖任务(如医疗诊断需持续跟踪患者历史记录)。 | 单次请求-响应模式,上下文依赖需开发者自行处理(如手动维护对话历史)。 |

| 安全性 | 数据本地化处理,用户授权控制敏感操作(如文件编辑、代码执行)。 | 依赖云端服务,需通过API密钥管理权限,数据可能暴露在云端。 |

3. 应用场景对比

MCP的典型场景

- 复杂数据交互:需同时连接文件系统、数据库、Web服务等多数据源的场景(如企业级自动化)。

- 长期上下文管理:如医疗诊断需持续跟踪患者历史记录,或客服机器人维护多轮对话。

- 安全敏感操作:本地资源访问(如编辑文件、执行代码)需用户实时授权。

Function Calling的典型场景

- 即时任务执行:如天气查询、股票价格查询、简单数据库查询。

- 单次结果需求:后续代码不依赖结果的场景(如生成一张图片后直接展示)。

- 快速原型开发:开发者希望快速集成第三方API(如调用天气API)。

4. 同步与异步的区别

| 特性 | Function Calling | MCP |

|---|---|---|

| 执行方式 | 同步调用:调用函数后程序会一直等待结果返回,再继续执行后续代码。类似“点菜后等菜做好才能干其他事”。 | 异步通信:发送请求后程序不会等待结果,继续执行其他代码。类似“网上购物后去做其他事,等快递到了再处理”。 |

| 适用场景 | 需要立即得到结果的场景(如查询当前时间)。 | 处理时间较长的场景(如网络请求、文件读写)。 |

5. 核心差异总结

| 对比维度 | MCP | Function Calling |

|---|---|---|

| 标准化程度 | 开放协议,统一规范,支持跨平台、跨服务商的互联互通。 | 私有化接口,依赖厂商的API规范,兼容性受限。 |

| 扩展性 | 通过MCP Server接入各类工具(如数据库、浏览器自动化、物联网设备),扩展性强。 | 工具数量一多时,模型难以在长列表中准确选择,提示词复杂且效果下降。 |

| 上下文管理 | 自动维护多轮对话和历史状态,适合复杂任务。 | 需手动维护上下文,适合简单任务。 |

| 安全性 | 数据本地化处理,用户授权控制敏感操作。 | 依赖云端服务,数据可能暴露在外部。 |

6. 类比理解

- Function Calling:如同家里的电器遥控器,每个遥控器需单独编接口才能控制对应电器(如天气查询需对接第三方API)。

- MCP:如同全屋智能中枢,通过统一协议接入所有家电(如窗帘、灯光、空调),只需一个“万能遥控器”即可完成多设备联动。

7. 如何选择?

选择MCP:

- 需要连接多种数据源(如文件系统、数据库、Web服务)。

- 需要维护长期上下文(如医疗诊断、客服机器人)。

- 需要高安全性(如本地资源访问需用户授权)。

选择Function Calling:

- 任务简单且需要即时结果(如查询天气、生成图片)。

- 工具数量较少,无需复杂上下文管理。

- 快速原型开发,直接调用第三方API。

8. 实际案例

MCP案例:

- 将Claude与Blender结合,一句话生成3D模型。

- 将Figma原型稿与LLM结合,自动转换为前端代码。

- 企业级自动化:LLM通过MCP连接CRM、邮件服务、日历,完成销售合同查询、发邮件、安排会议等多步骤任务。

Function Calling案例:

- 调用天气API查询城市天气。

- 调用股票API获取实时股价。

- 调用图像生成API生成特定主题的图片。

9. 未来趋势

MCP的潜力:

- Anthropic计划开发MCP服务器注册表和发现协议,实现工具的自动发现与集成。

- 成为AI世界的“Type-C”接口,统一各类工具和数据源的接入方式。

Function Calling的局限:

- 工具碎片化问题(每个工具需单独对接)。

- 上下文管理能力弱,难以处理复杂任务。

总结

MCP与Function Calling并非对立关系,而是互补的层级关系:

- Function Calling 是基础层,解决“模型能调用工具”的问题。

- MCP 是扩展层,解决“高效接入大量工具”的问题。

- AI Agent 则是上层应用,通过整合两者实现复杂任务的自主执行(如管家机器人调用MCP连接智能家居设备)。