LVS( Linux virual server)

主机名 |

角色 |

server1 |

调度器(VS) |

server2 |

真实服务器(RS) |

server3 |

真实服务器(RS) |

server4 |

测试机 |

2.1.系统性能扩展方式

![]() Scale UP:向上扩展,增强

Scale UP:向上扩展,增强

![]() Scale Out:向外扩展,增加设备,调度分配问题, Cluster

Scale Out:向外扩展,增加设备,调度分配问题, Cluster

2.2.集群Cluster

Cluster: 集群是为了解决某个特定问题将堕胎计算机组合起来形成的单个系统

Cluster常见的三种类型:

![]() LB: LoadBalancing (负载均衡)由多个主机组成,每个主机只承担一部分访问

LB: LoadBalancing (负载均衡)由多个主机组成,每个主机只承担一部分访问

![]() HA: High Availiablity (高可用) SPOF(single Point Of failure)

HA: High Availiablity (高可用) SPOF(single Point Of failure)

MTBF:Mean Time Between Failure 平均无故障时间,正常时间

MTTR:Mean Time To Restoration(repair)平均恢复前时间,故障时间

A=MTBF/( MTBF+MTTR) (0,1):99%, 99.5%, 99.9%, 99.99%, 99.999%

SLA:Service level agreement(服务等级协议)是在一定开销下为保障服务的性能和可用性,服 务提供商与用户间定义的一种双方认可的协定。通常这个开销是驱动提供服务质量的主要因素。在 常规的领域中,总是设定所谓的三个9,四个9来进行表示,当没有达到这种水平的时候,就会有一 些列的惩罚措施,而运维,最主要的目标就是达成这种服务水平。

停机时间又分为两种, 一种是计划内停机时间, 一种是计划外停机时间,而运维则主要关注计划外 停机时间

![]() HPC: High-performance computing(高性能计算,国家战略资源,不在课程范围内)

HPC: High-performance computing(高性能计算,国家战略资源,不在课程范围内)

2.3.分布式

分布式存储:Ceph ,GlusterFs , FastDFS , MogileFs

分布式计算:hadoop ,Spark

分布式常见应用

![]() 分布式应用-服务按照功能拆分,使用微服务

分布式应用-服务按照功能拆分,使用微服务

![]() 分布式静态资源--静态资源放在不同的存储集群上

分布式静态资源--静态资源放在不同的存储集群上

![]() 分布式数据和存储--使用key-value缓存系统

分布式数据和存储--使用key-value缓存系统

![]() 分布式计算--对特殊业务使用分布式计算,比如Hadoop集群

分布式计算--对特殊业务使用分布式计算,比如Hadoop集群

2.4.集群和分布式

![]() 集群:同一个业务系统,部署在多台服务器上,集群中,每一台服务器实现的功能没有差别,数据 和代码都是一样的

集群:同一个业务系统,部署在多台服务器上,集群中,每一台服务器实现的功能没有差别,数据 和代码都是一样的

![]() 分布式: 一个业务被拆成多个子业务,或者本身就是不同的业务,部署在多台服务器上。分布式

分布式: 一个业务被拆成多个子业务,或者本身就是不同的业务,部署在多台服务器上。分布式

中,每一台服务器实现的功能是有差别的,数据和代码也是不一样的,分布式每台服务器功能加起 来,才是完整的业务

![]() 分布式是以缩短单个任务的执行时间来提升效率的,而集群则是通过提高单位时间内执行的任务数 来提升效率,

分布式是以缩短单个任务的执行时间来提升效率的,而集群则是通过提高单位时间内执行的任务数 来提升效率,

![]() 对于大型网站,访问用户很多,实现一个群集,在前面部署一个负载均衡服务器,后面几台服务器 完成同一业务。如果有用户进行相应业务访问时,负载均衡器根据后端哪台服务器的负载情况,决 定由给哪一台去完成响应,并且台服务器垮了,其它的服务器可以顶上来。分布式的每一个节点, 都完成不同的业务,如果一个节点垮了,那这个业务可能就会失败

对于大型网站,访问用户很多,实现一个群集,在前面部署一个负载均衡服务器,后面几台服务器 完成同一业务。如果有用户进行相应业务访问时,负载均衡器根据后端哪台服务器的负载情况,决 定由给哪一台去完成响应,并且台服务器垮了,其它的服务器可以顶上来。分布式的每一个节点, 都完成不同的业务,如果一个节点垮了,那这个业务可能就会失败

三.lvs(Linux virtual server)运行原理

3.1 lvs简介

LVS:Linux Virtual Server,负载调度器,内核集成,章文嵩,阿里的四层SLB(Server LoadBalance)是基 于LVS+keepalived实现

LVS 官网: The Linux Virtual Server Project - Linux Server Cluster for Load Balancing

LVS 相关术语

![]() VS: Virtual Server,负责调度

VS: Virtual Server,负责调度

![]() RS:RealServer,负责真正提供服务

RS:RealServer,负责真正提供服务

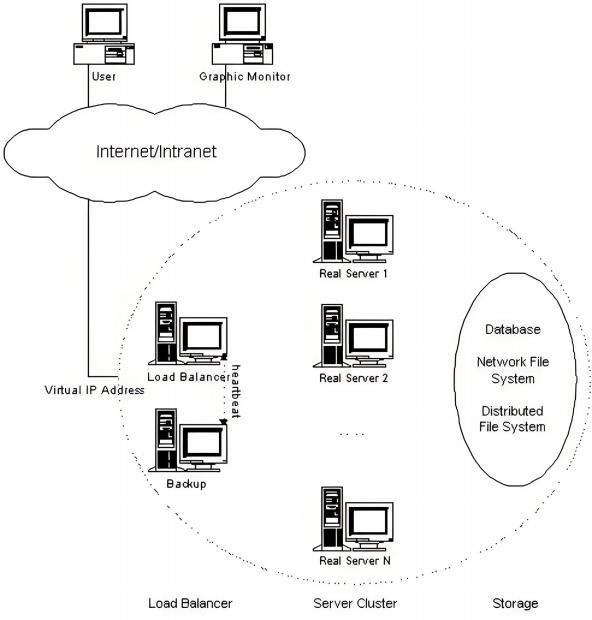

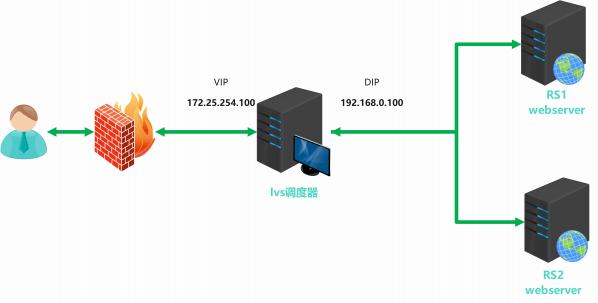

3.2 lvs集群体系结构

工作原理:

VS根据请求报文的目标IP和目标协议及端口将其调度转发至某RS,根据调度算法来挑选RS

3.3.LVS概念

![]() VS:Virtual Server

VS:Virtual Server

![]() RS: Real Server

RS: Real Server

● CIP:Client IP

![]() VIP: Virtual serve IP VS外网的IP

VIP: Virtual serve IP VS外网的IP

![]() DIP: Director IP VS内网的IP

DIP: Director IP VS内网的IP

![]() RIP: Real server IP

RIP: Real server IP

访问流程: CIP <--> VIP == DIP <--> RIP

3.4.lvs集群的类型

lvs-nat: 修改请求报文的目标IP,多目标IP的DNAT

lvs-dr: 操纵封装新的MAC地址

lvs-tun: 在原请求IP报文之外新加一个IP首部

lvs-fullnat: 修改请求报文的源和目标IP

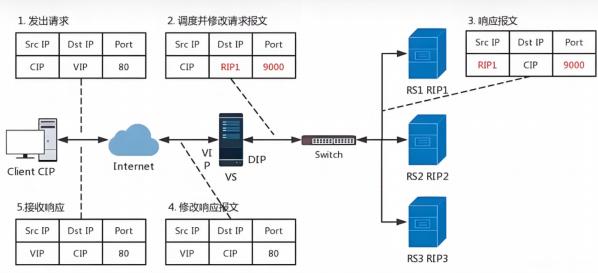

3.4.1.nat模式

Ivs-nat:

![]() 本质是多目标IP的DNAT,通过将请求报文中的目标地址和目标端口修改为某挑出的RS的RIP和 PORT实现转发

本质是多目标IP的DNAT,通过将请求报文中的目标地址和目标端口修改为某挑出的RS的RIP和 PORT实现转发

![]() RIP和DIP应在同一个IP网络,且应使用私网地址;RS的网关要指向DIP

RIP和DIP应在同一个IP网络,且应使用私网地址;RS的网关要指向DIP

![]() 请求报文和响应报文都必须经由Director转发, Director易于成为系统瓶颈

请求报文和响应报文都必须经由Director转发, Director易于成为系统瓶颈

![]() 支持端口映射,可修改请求报文的目标PORT

支持端口映射,可修改请求报文的目标PORT

![]() VS必须是Linux系统, RS可以是任意OS系统

VS必须是Linux系统, RS可以是任意OS系统

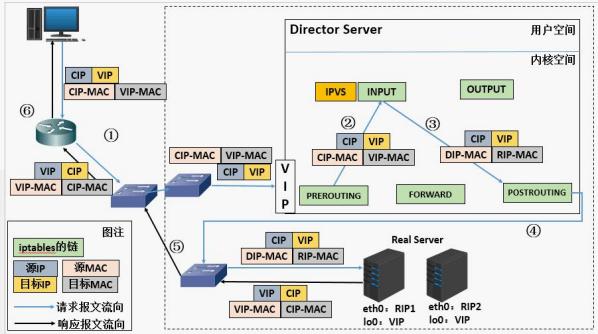

3.4.2.nat模式数据逻辑

1.客户端发送访问请求,请求数据包中含有请求来源(cip),访问目标地址(VIP)访问目标端口 (9000port)

2.VS服务器接收到访问请求做DNAT把请求数据包中的目的地由VIP换成RS的RIP和相应端口

3.RS1相应请求,发送响应数据包,包中的相应保温为数据来源(RIP1)响应目标(CIP)相应端口 (9000port)

4.VS服务器接收到响应数据包,改变包中的数据来源(RIP1-->VIP),响应目标端口(9000-->80)

5.VS服务器把修改过报文的响应数据包回传给客户端

6.lvs的NAT模式接收和返回客户端数据包时都要经过lvs的调度机,所以lvs的调度机容易阻塞

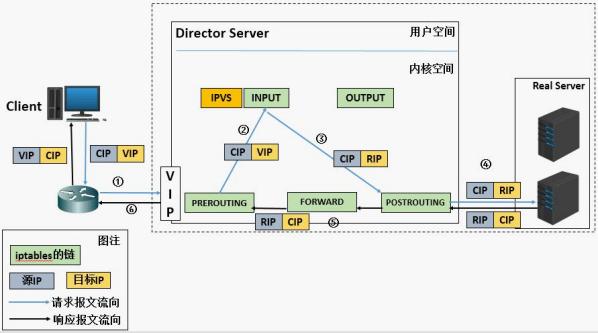

客户请求到达vip后进入PREROUTING,在没有ipvs的时候因该进入本机INPUT,当IPVS存在后访问请求在通 过PREROUTING后被ipvs结果并作nat转发

因为ipvs的作用点是在PREROUTING和INPUT链之间,所以如果在prerouting中设定规则会干扰ipvs的工

作。所以在做lvs时要把iptables的火墙策略全清理掉。

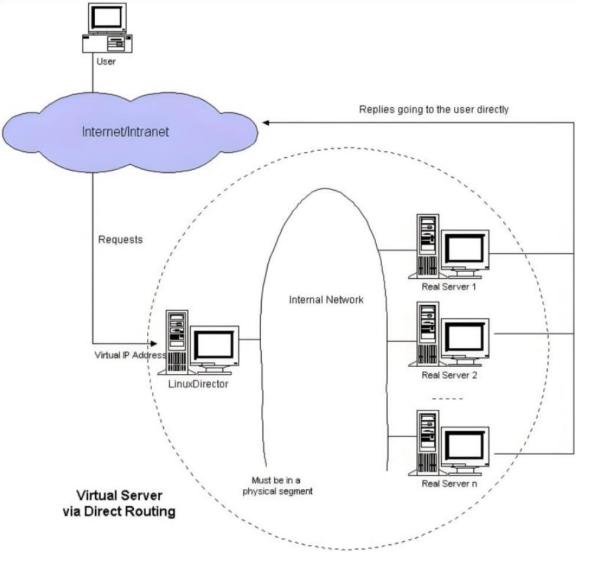

3.4.3.DR模式

DR: Direct Routing,直接路由, LVS默认模式,应用最广泛,通过为请求报文重新封装一个MAC首部进行 转发,源MAC是DIP所在的接口的MAC,目标MAC是某挑选出的RS的RIP所在接口的MAC地址;源

IP/PORT,以及目标IP/PORT均保持不变

3.4.4.DR模式数逻辑

在DR模式中, RS接收到访问请求后不需要回传给VS调度器,直接把回传数据发送给client,所以RS和vs 上都要有vip

3.4.6.DR模式数据传输过程

1.客户端发送数据帧给vs调度主机帧中内容为客户端IP+客户端的MAC+VIP+VIP的MAC

2.VS调度主机接收到数据帧后把帧中的VIP的MAC该为RS1的MAC,此时帧中的数据为客户端IP+客户端 的MAC+VIP+RS1的MAC

3.RS1得到2中的数据包做出响应回传数据包,数据包中的内容为VIP+RS1的MAC+客户端IP+客户端IP的 MAC

3.4.6.DR模式的特点

1.Director和各RS都配置有VIP

2.确保前端路由器将目标IP为VIP的请求报文发往Director

3.在前端网关做静态绑定VIP和Director的MAC地址

![]() 在RS上使用arptables工具

在RS上使用arptables工具

arptables -A IN -d $VIP -j DROP arptables -A OUT -s $VIP -j mangle --mangle-ip-s $RIP |

![]() 在RS上修改内核参数以限制arp通告及应答级别

在RS上修改内核参数以限制arp通告及应答级别

/proc/sys/net/ipv4/conf/all/arp_ignore /proc/sys/net/ipv4/conf/all/arp_announce |

4.RS的RIP可以使用私网地址,也可以是公网地址; RIP与DIP在同一IP网络;

5.RIP的网关不能指向DIP,以确保响应报文不会经由Director

6.RS和Director要在同一个物理网络

7.请求报文要经由Director,但响应报文不经由Director,而由RS直接发往Client

8.不支持端口映射(端口不能修败)

9.RS可使用大多数OS系统

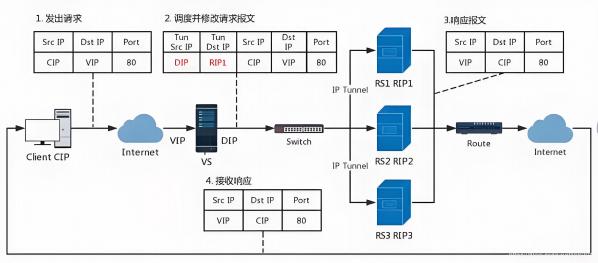

3.4.7.TUN模式

转发方式:不修改请求报文的IP首部(源IP为CIP,目标IP为VIP),而在原IP报文之外再封装一个IP首部 (源IP是DIP,目标IP是RIP),将报文发往挑选出的目标RS; RS直接响应给客户端(源IP是VIP,目标IP 是CIP)

3.4.8.TUN模式数据传输过程

1.客户端发送请求数据包,包内有源IP+vip+dport

2.到达vs调度器后对客户端发送过来的数据包重新封装添加IP报文头,新添加的IP报文头中包含 TUNSRCIP(DIP)+TUNDESTIP(RSIP1)并发送到RS1

3.RS收到VS调度器发送过来的数据包做出响应,生成的响应报文中包含SRCIP(VIP)+DSTIP(CIP) +port,响应数据包通过网络直接回传给client

3.4.9.TUN模式特点

1.DIP, VIP, RIP都应该是公网地址

2.RS的网关一般不能指向DIP

3.请求报文要经由Director,但响应不能经由Director

4.不支持端口映射

5.RS的OS须支持隧道功能

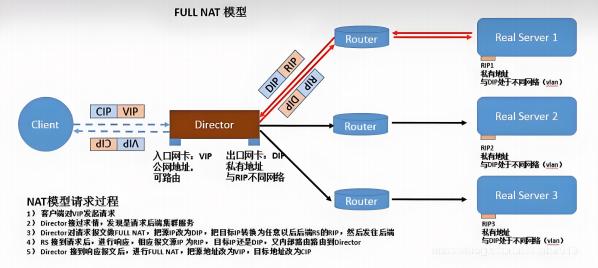

3.4.10.fullnet模式

fullnat:通过同时修改请求报文的源IP地址和目标IP地址进行转发

CIP --> DIP

VIP --> RIP

1.VIP是公网地址, RIP和DIP是私网地址,且通常不在同一IP网络;因此, RIP的网关一般不会指向DIP

2.RS收到的请求报文源地址是DIP,因此,只需响应给DIP;但Director还要将其发往Client

3.请求和响应报文都经由Director

4.支持端口映射

3.4.11.LVS工作模式总结

NAT模式 |

TUN模式 |

DR模式 |

|

RS操作系统 |

不限 |

支持隧道 |

禁用arp |

调度器和服务器网络 |

可跨网络 |

可跨网络 |

不可跨网络 |

调度服务器数量服务器数量 |

少 |

多 |

多 |

RS服务器网关 |

指向到调度器DIP |

指向到路由 |

指向到路由 |

![]() lvs-nat与lvs-fullnat:请求和响应报文都经由Director

lvs-nat与lvs-fullnat:请求和响应报文都经由Director

![]() lvs-nat: RIP的网关要指向DIP

lvs-nat: RIP的网关要指向DIP

![]() lvs-fullnat: RIP和DIP未必在同一IP网络,但要能通信

lvs-fullnat: RIP和DIP未必在同一IP网络,但要能通信

![]() lvs-dr与lvs-tun:请求报文要经由Director,但响应报文由RS直接发往Client

lvs-dr与lvs-tun:请求报文要经由Director,但响应报文由RS直接发往Client

![]() lvs-dr:通过封装新的MAC首部实现,通过MAC网络转发

lvs-dr:通过封装新的MAC首部实现,通过MAC网络转发

![]() lvs-tun:通过在原IP报文外封装新IP头实现转发,支持远距离通信

lvs-tun:通过在原IP报文外封装新IP头实现转发,支持远距离通信

3.5.lvs的调度算法

3.5.1.lvs调度算法类型

ipvs scheduler:根据其调度时是否考虑各RS当前的负载状态被分为两种:静态方法和动态方法

静态方法:仅根据算法本身进行调度,不考虑RS的负载情况

动态方法:主要根据每RS当前的负载状态及调度算法进行调度Overhead=value较小的RS将被调度

3.5.2.lvs静态调度算法

1、 RR: roundrobin 轮询 RS分别被调度,当RS配置有差别时不推荐

2、WRR:Weighted RR,加权轮询根据RS的配置进行加权调度,性能差的RS被调度的次数少

3、SH:Source Hashing,实现session sticky,源IP地址hash;将来自于同一个IP地址的请求始终发往 第一次挑中的RS,从而实现会话绑定

4、 DH: Destination Hashing;目标地址哈希,第一次轮询调度至RS,后续将发往同一个目标地址的请 求始终转发至第一次挑中的RS,典型使用场景是正向代理缓存场景中的负载均衡,如:宽带运营商

主要根据RS当前的负载状态及调度算法进行调度Overhead=value较小的RS会被调度

1、 LC: least connections(最少链接发)

适用于长连接应用Overhead(负载值) =activeconns(活动链接数) x 256+inactiveconns (非活 动链接数)

2、WLC:Weighted LC (权重最少链接)

默认调度方法Overhead=(activeconns x 256+inactiveconns)/weight

3、SED:Shortest Expection Delay,

初始连接高权重优先Overhead=(activeconns+1+inactiveconns) x 256/weight

但是,当node1的权重为1 , node2的权重为10,经过运算前几次的调度都会被node2承接

4、 NQ: Never Queue,第一轮均匀分配,后续SED

5、 LBLC: Locality-Based LC,动态的DH算法,使用场景:根据负载状态实现正向代理

6、 LBLCR: LBLC with Replication,带复制功能的LBLC,解决LBLC负载不均衡问题,从负载重的复制 到负载轻的RS

1.FO(Weighted Fai Over)调度算法:常用作灰度发布

在此FO算法中,遍历虚拟服务所关联的真实服务器链表,找到还未过载(未设置IP_VS_DEST_F OVERLOAD标志)的且权重最高的真实服务器,进行调度

当服务器承接大量链接,我们可以对此服务器进行过载标记(IP_VS_DEST_F OVERLOAD),那么vs调度 器就不会把链接调度到有过载标记的主机中。

2.OVF(Overflow-connection)调度算法

基于真实服务器的活动连接数量和权重值实现。将新连接调度到权重值最高的真实服务器,直到其活动 连接数量超过权重值,之后调度到下一个权重值最高的真实服务器,在此OVF算法中,遍历虚拟服务相关

联的真实服务器链表,找到权重值最高的可用真实服务器。 一个可用的真实服务器需要同时满足以下条 件:

· 未过载(未设置IP_VS_DEST_F OVERLOAD标志)

![]() 真实服务器当前的活动连接数量小于其权重值

真实服务器当前的活动连接数量小于其权重值

![]() 其权重值不为零

其权重值不为零

四.lvs部署命令介绍

4.1.lvs软件相关信息

![]() 程序包: ipvsadm

程序包: ipvsadm

![]() Unit File: ipvsadm.service

Unit File: ipvsadm.service

![]() 主程序: /usr/sbin/ipvsadm

主程序: /usr/sbin/ipvsadm

![]() 规则保存工具: /usr/sbin/ipvsadm-save

规则保存工具: /usr/sbin/ipvsadm-save

![]() 规则重载工具: /usr/sbin/ipvsadm-restore

规则重载工具: /usr/sbin/ipvsadm-restore

![]() 配置文件: /etc/sysconfig/ipvsadm-config

配置文件: /etc/sysconfig/ipvsadm-config

![]() ipvs调度规则文件: /etc/sysconfig/ipvsadm

ipvs调度规则文件: /etc/sysconfig/ipvsadm

4.2.ipvsadm命令

核心功能:

![]() 集群服务管理:增、删、改

集群服务管理:增、删、改

![]() 集群服务的RS管理:增、删、改

集群服务的RS管理:增、删、改

![]() 查看

查看

命令参数

|

管理集群服务 ipvsadm -A|E -t(tcp) |u(udp) |f(防护墙标签) \ service-address(集群地址) \ [-s scheduler(调度算法)] \ [-p [timeout]] \ [-M netmask] \ [--pepersistence_engine] \ [-b sched-flags] ipvsadm -D -t|u|f service-address 删除 ipvsadm –C 清空 ipvsadm –R 重载 ipvsadm -S [-n] 保存 管理集群中的real server ipvsadm -a|e -t|u|f service-address -r server-address [-g | -i| -m](工作模式) [-w weight](权重) ipvsadm -d -t|u|f service-address -r server-address 删除RS ipvsadm -L|l [options] 查看rs |

4.3.lvs集群中的增删改

1.管理集群服务中的增删改

ipvsadm -A|E -t|u|f service-address [-s scheduler] [-p [timeout]]

-A #添加

-E #修改

-t #tcp服务

-u #udp服务

-s #指定调度算法,默认为WLC

-p #设置持久连接超时,持久连接可以理解为在同一个时间段同一个来源的请求调度到同一Realserver

-f #firewall mask 火墙标记,是一个数字

2.管理集群中RealServer的曾增删

ipvsadm -a|e -t|u|f service-address -r realserver-address [-g|i|m] [-w weight]

|

-a #添加realserver -e #更改realserver -t #tcp协议 -u #udp协议 -f #火墙 标签 -r #realserver地址 -g #直连路由模式 -i #ipip隧道模式 -m #nat模式 -w #设定权重 -Z #清空计数器 -C #清空lvs策略 -L #查看lvs策略 -n #不做解析 --rate :输出速率信息 |

5.1部署NAT模式集群案例

网络部署

Client

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入配置

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

rs1

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入配置

关闭防火墙

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

安装httpd

dnf install httpd

开启服务

systemctl start httpd

写入apache默认页面

echo rs1 192.168.245.210 > /var/www/html/index.html

rs2

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入配置

关闭防火墙

![]()

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

安装httpd

dnf install httpd

开启服务

systemctl start httpd

写入apache默认页面

echo RS1 192.168.245.220 > /var/www/html/index.html

lvs

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入网卡eth1配置

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入网卡eth0配置

重启网卡使配置生效

Nmcli connetction reload

Nmcli connection up eth0

Nmcli connection uo eth1

开启内核路由功能

编辑内核参数文件

vim /etc/sysctl.conf

启用IP转发,让主机内网卡可以通信,使Linux系统充当路由器

net.ipv4.ip_forward = 1

安装ipvsadm

dnf install ipvsadm-1.31-6.el9.x86_64 -y

关闭防火墙

systemctl stop firewalld.service

添加调度策略

测试

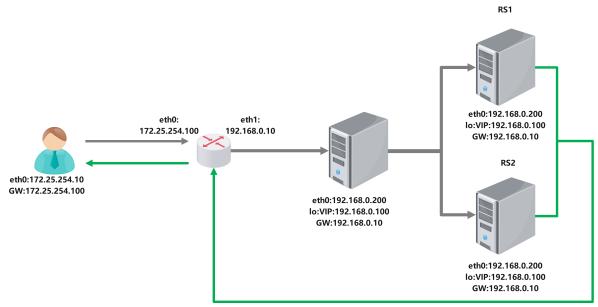

5.2部署DR模式集群案例

Client

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入配置

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

编辑eth0网卡配置文件

vim /etc/NetworkManager/system-connections/eth0.nmconnection 写入配置

Eth1网卡配置

使配置生效

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

nmcli connection up eth1

开启内核路由功能

编辑内核参数文件

vim /etc/sysctl.conf

#启用IP转发,让主机内网卡可以通信,使Linux系统充当路由器

net.ipv4.ip_forward = 1

Lvs

安装ipvsadm

dnf install ipvsadm-1.31-6.el9.x86_64 -y

关闭防火墙

systemctl disable --now firewalld.service

编辑eth0网卡配置文件

vim /etc/NetworkManager/system-connections/eth0.nmconnection

写入配置

编辑lo网卡配置文件

vim /etc/NetworkManager/system-connections/lo.nmconnection

写入配置

修改权限

chmod 600 /etc/NetworkManager/system-connections/lo.nmconnection

使配置生效

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

nmcli connection up lo

lo 配置生效

Rs1

编辑eth0网卡配置文件

vim /etc/NetworkManager/system-connections/eth0.nmconnection

写入配置

编辑lo网卡配置文件

vim /etc/NetworkManager/system-connections/lo.nmconnection

写入配置

修改权限

chmod 600 /etc/NetworkManager/system-connections/lo.nmconnection

使配置生效

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

nmcli connection up lo

设定lo不对外响应

vim /etc/sysctl.conf

写入

arp_ignore(ARP 忽略策略):仅当 ARP 请求的目标 IP 配置在接收请求的网卡上时,才响应;否则忽略。

arp_announce(ARP 宣告策略):强制使用与目标 IP 同网段的本地 IP 作为源 IP(必须同网段,否则不发送)。

net.ipv4.conf.all.arp_ignore =1

net.ipv4.conf.all.arp_announce = 2

net.ipv4.conf.lo.arp_ignore =1

net.ipv4.conf.lo.arp_announce =2

安装httpd

dnf install httpd

开启服务,启用80端口

systemctl start httpd

写入apache默认页面

echo rs1 192.168.245.210 > /var/www/html/index.html

关闭防火墙

systemctl disable --now firewalld.service

Rs2

vim /etc/NetworkManager/system-connections/eth0.nmconnection

写入配置

编辑lo网卡配置文件

vim /etc/NetworkManager/system-connections/lo.nmconnection

写入配置

修改权限

chmod 600 /etc/NetworkManager/system-connections/lo.nmconnection

使配置生效

nmcli connection reload 重新加载网络配置

nmcli connection up eth0 重启网卡

nmcli connection up lo

设定lo不对外响应

vim /etc/sysctl.conf

写入

net.ipv4.conf.all.arp_ignore =1

net.ipv4.conf.all.arp_announce = 2

net.ipv4.conf.lo.arp_ignore =1

net.ipv4.conf.lo.arp_announce =2

安装httpd

dnf install httpd

开启服务,启用80端口

systemctl start httpd

写入apache默认页面

echo rs2 192.168.245.220 > /var/www/html/index.html

关闭防火墙

systemctl disable --now firewalld.service

添加调度策略

ipvsadm -A -t 192.168.245.111:80 -s rr

#为虚拟服务器指定后端真实服务器 模式为DR

ipvsadm -a -t 192.168.245.111:80 -r 192.168.245.210:80 -g

ipvsadm -a -t 192.168.245.111:80 -r 192.168.245.220:80 -g

保存规则

ipvsadm -Sn > /etc/sysconfig/ipvsadm

设置开机自启动,需要先将文件规则/etc/sysconfig/ipvsadm

systemctl enable --now ipvsadm.service

测试

5.3.防火墙标签解决轮询错误

Rs1、RS2

安装加密模块,实现https协议服务

yum install mod_ssl -y

重启httpd,是配置生效

systemctl restart httpd

lvs

设定策略

向mangele PREROUTING链 添加规则 用于匹配ip-192.168.245.111 协议-tcp 端口:80\443 ,满足以上条件者打上标记666

将80和443归为同一组,使用同一个集群服务调度

iptables -t mangle -A PREROUTING -d 192.168.245.111 -p tcp -m multiport --dports 80,443 -j MARK --set-mark 666

#写入规则

ipvsadm -A -f 666 -s rr

ipvsadm -a -f 666 -r 192.168.245.210 -g

ipvsadm -a -f 666 -r 192.168.245.220 -g

测试