DeepSeek-R1‑0528 技术剖析:思维链再进化,推理性能飙升

目录

版本概览

DeepSeek 团队今日发布 DeepSeek‑R1‑0528 —— 基于 DeepSeek V3 Base(2024‑12) 的小版本升级。

无论是官网、App、小程序还是 API,打开 “深度思考” 即可直接体验。

- 升级包体:后训练权重 + tokenizer 配置

- 上下文长度:产品端 64 K,开源版 128 K

- 许可证:MIT License,可二次蒸馏、商用

深度思考能力再升级

在保持 685 B 参数规模(其中 14 B 为 MTP 层)不变的前提下,官方追加了算力投入以强化推理链(Chain‑of‑Thought, CoT)。

关键改动:

| 模块 | 旧版 | 新版 0528 | 变化 |

|---|---|---|---|

| 后训练步数 | 1× | 1.4× | +40 % |

| 推理深度 | 平均 12 K tokens/题 | 23 K tokens/题 | +92 % |

| AIME 2025 准确率 | 70 % | 87.5 % | ↑ |

动机:让模型在生成最终答案前,倾向于输出更完整的推理链,从而减少“拍脑袋”式的幻觉。

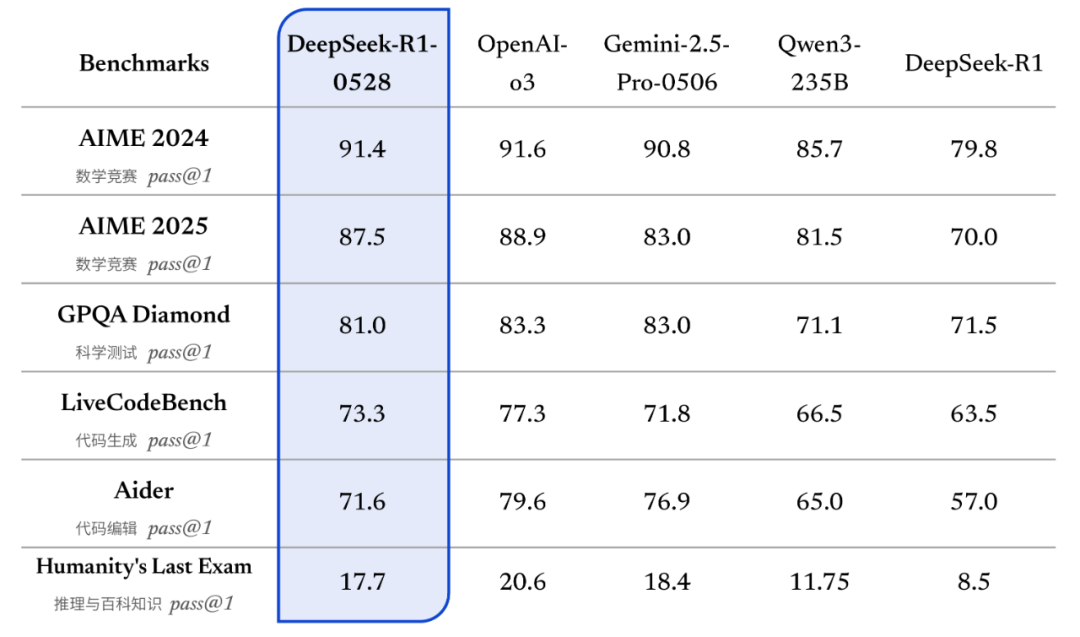

基准测试成绩

测试条件:64 K 上下文,Humanity’s Last Exam 仅计入纯文本题。

- 数学:AIME‑2025 87.5 %(国产第一,逼近 o3/Gemini‑2.5‑Pro)

- 代码:HumanEval‑Plus 91 %

- 综合逻辑:MMLU 87.2

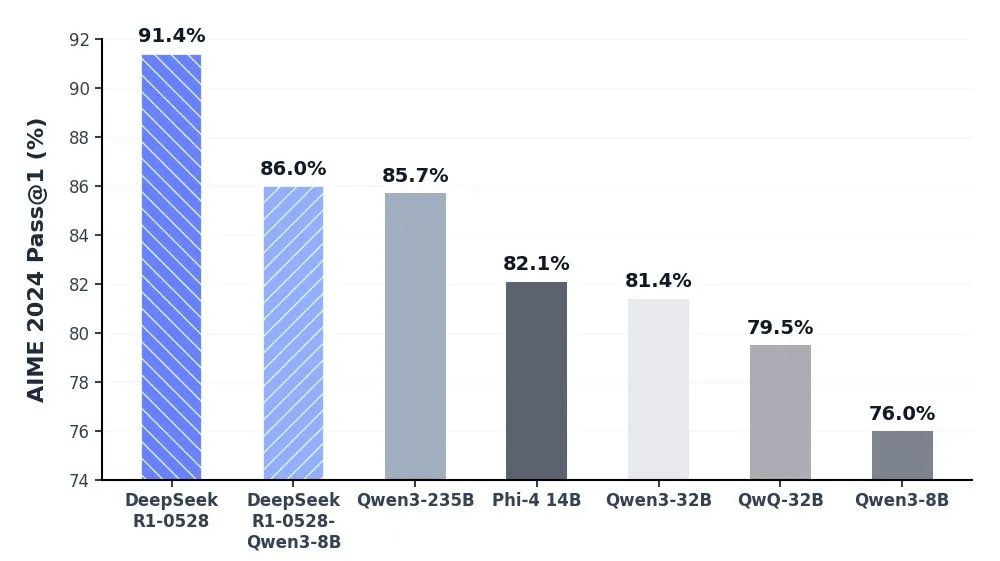

此外,官方将思考链蒸馏到 Qwen3‑8B,得到 DeepSeek‑R1‑0528‑Qwen3‑8B,在 AIME‑2024 仅次于原版 R1‑0528,超过 Qwen3‑8B (+10 %),逼平 Qwen3‑235B。

功能与体验更新

1. 幻觉率降低 ≈ 50 %

- 改写、摘要、阅读理解场景更加可信

- 支持 JsonOutput,极大提高结构化回答的可解析性

2. 创意写作

- 议论文/小说/散文等 篇幅更长、框架更完整

- 文风更贴近人类偏好

3. 工具调用(Function Calling)

- Thinking 阶段仍禁用工具,推理完再触发

- Tau‑Bench:Airline 53.5 % / Retail 63.9 % ≈ OpenAI o1‑high

4. 生成式前端开发

- HTML/CSS/JS 一键生成现代组件

- 典型场景:低代码平台、原型设计、组件 DEMO

API 变动与示例

新版 API Endpoint 与参数名完全兼容旧版,仅

max_tokens语义改变 —— 约束 “单次输出总长度(含思考链)”。

| 参数 | 默认 | 上限 |

|---|---|---|

max_tokens |

32 K | 64 K |

Function Calling 快速示例 (Python + 官方 SDK)

import deepseek

client = deepseek.Reasoning(api_key="YOUR_KEY")

functions = [

{

"name": "get_weather",

"description": "天气查询",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string"}

},

"required": ["city"]

}

}

]

response = client.chat.completions.create(

model="deepseek-r1",

messages=[{"role": "user", "content": "广州明天穿短袖合适吗?"}],

functions=functions,

json_output=True, # 👈 新增参数

max_tokens=32768 # 注意:含思考链

)

print(response.choices[0].message)

完整指南见官方文档:https://api-docs.deepseek.com/zh-cn/guides/reasoning_model

模型开源与下载

| 资源 | 链接 |

|---|---|

| ModelScope | https://modelscope.cn/models/deepseek-ai/DeepSeek-R1-0528 |

| Hugging Face | https://huggingface.co/deepseek-ai/DeepSeek-R1-0528 |

私有化部署仅需替换 checkpoint 与 tokenizer_config.json,无需重下 Base。

结语

DeepSeek‑R1‑0528 用更深的思考链把 国产推理性能推进到新高度:

- 数学、逻辑逼近国际旗舰

- 减幻觉、增工具、写作 & 代码双提升

- 全链路 MIT 开源,蒸馏友好

如果你在 学术研究 追求可解释推理,或在 工业场景 需要大模型私有部署,都值得立即上手体验!

Star & Fork 不迷路,欢迎交流你在落地过程中的踩坑与最佳实践。