目录

一、安装软件

软件安装:https://mp.weixin.qq.com/s/JCN5H7op35wfQpyvSMAeow,讲的很详细了,一步步来就行。

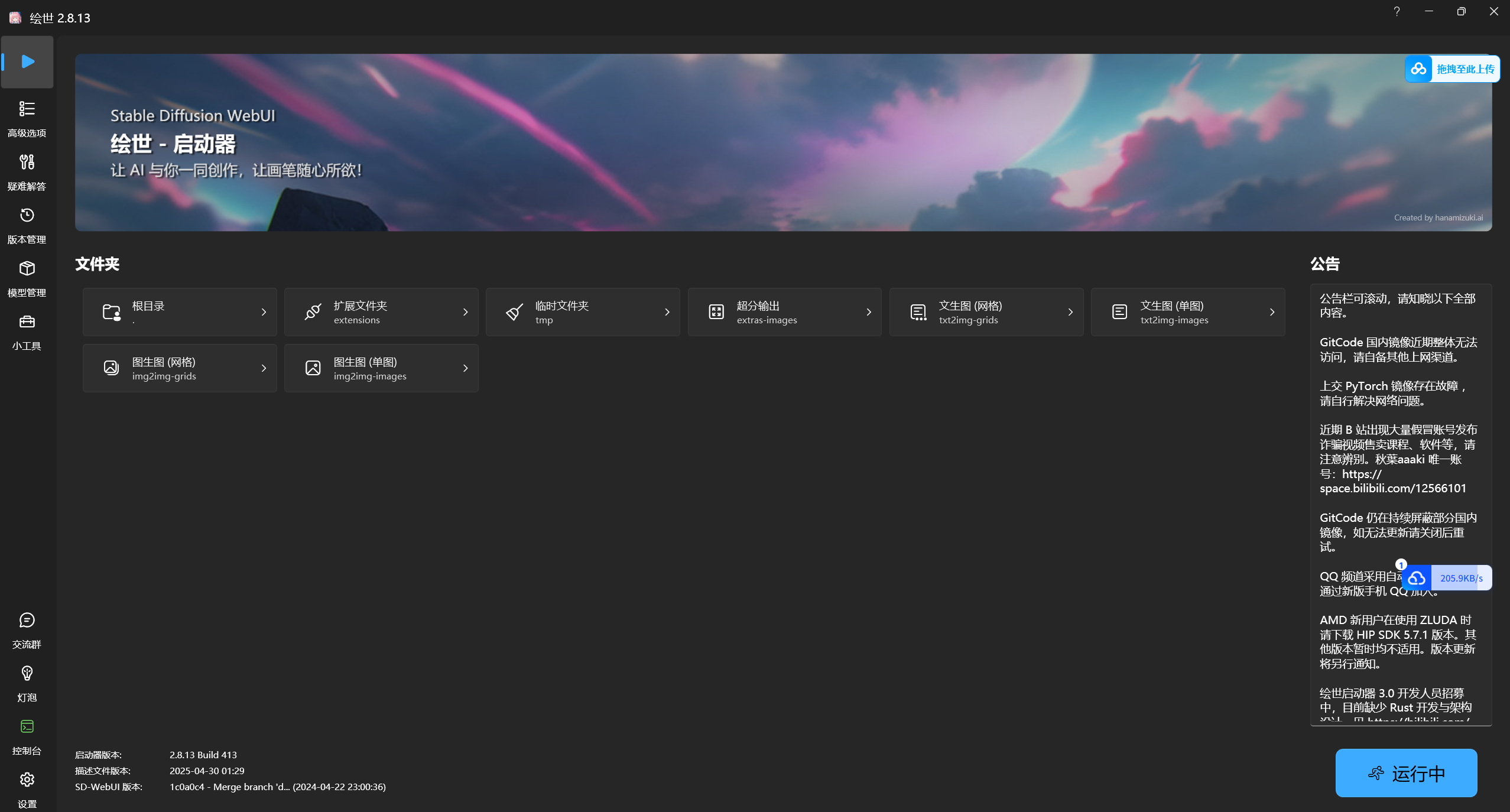

运行界面:

启动器:

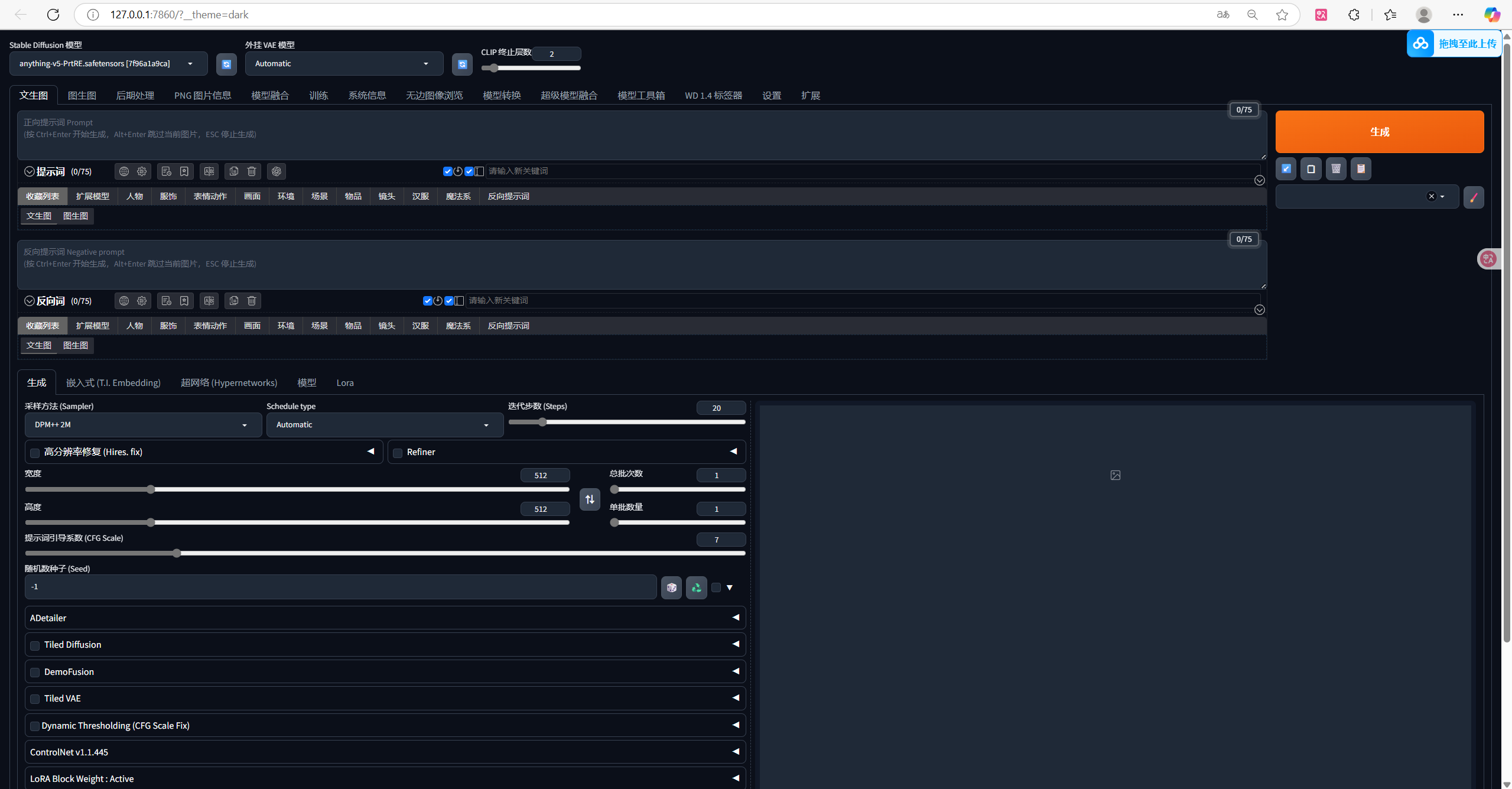

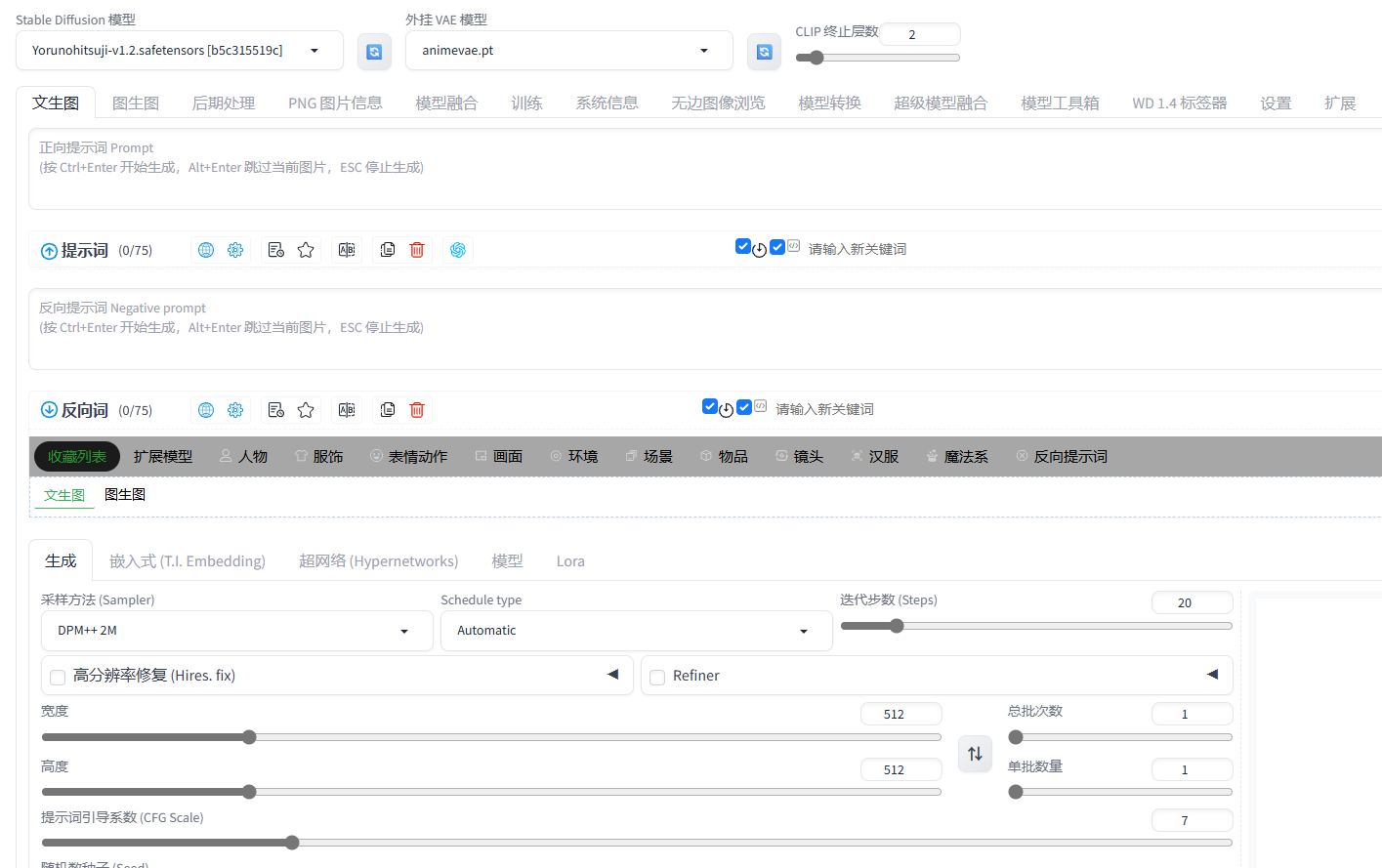

绘图ui界面:

二、文生图各部分模块

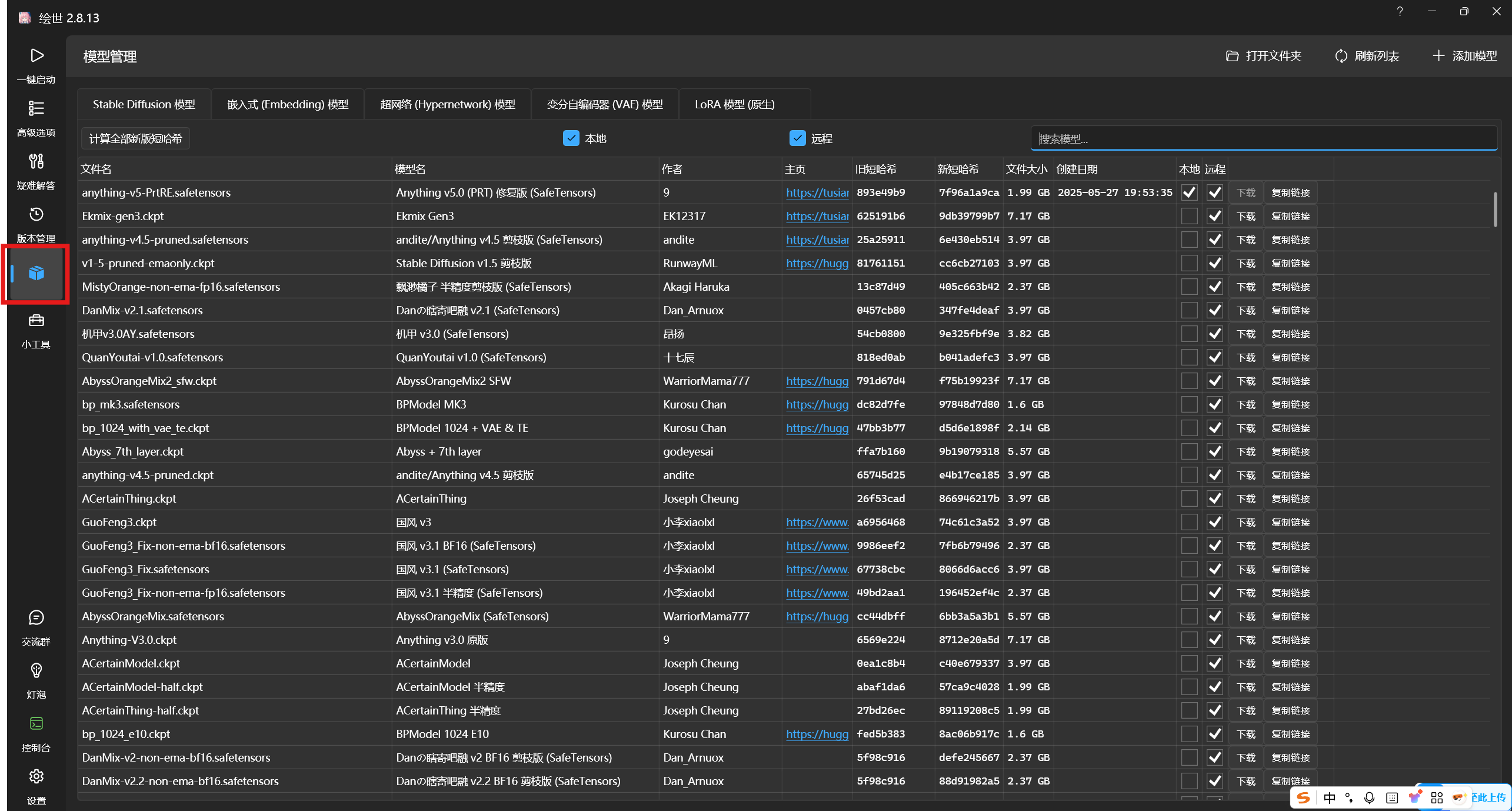

1. 下载新模型 & 画出第一张图

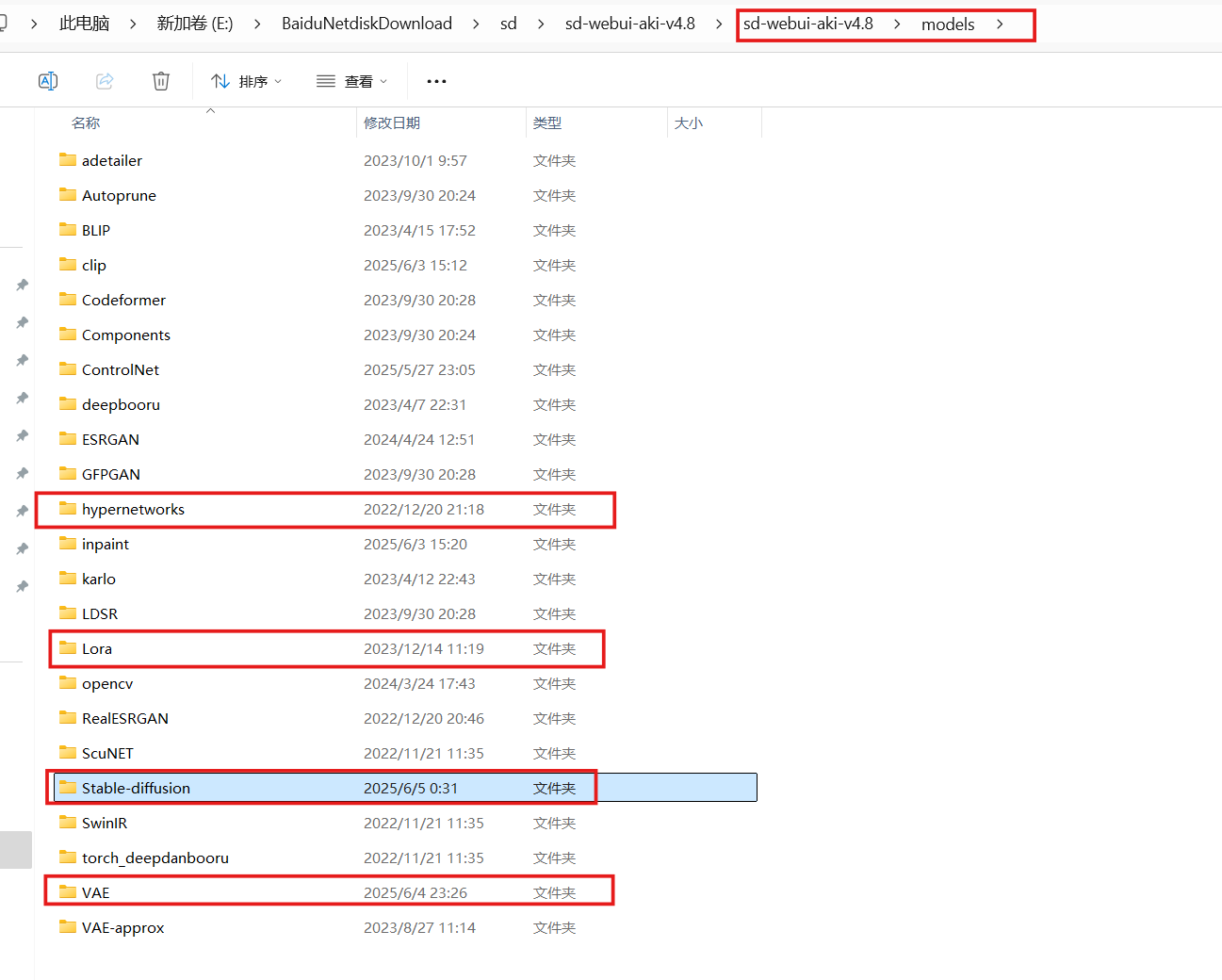

我们的启动器就有模型下载功能,但是下载有点问题,我更倾向于把这个当成一个检索台,真正下载可以点击"复制链接"然后去对应的网址中下载(绝大多数是个huggingface链接,要魔法上网),保存到安装目录model底下的子文件夹中。比如你下载的是stable diffusion模型,应该放到models/Stable_diffusion文件夹,其他同理。

也可以去huggingface或者https://civitai.com/这种开源平台下载。

如图所示,根据下载文件的类型,放到不同的文件夹目前下。

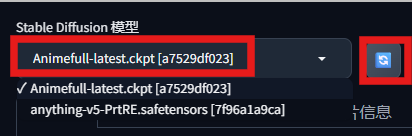

下载完成后,在左上角可以点击刷新,就可以切换模型了。

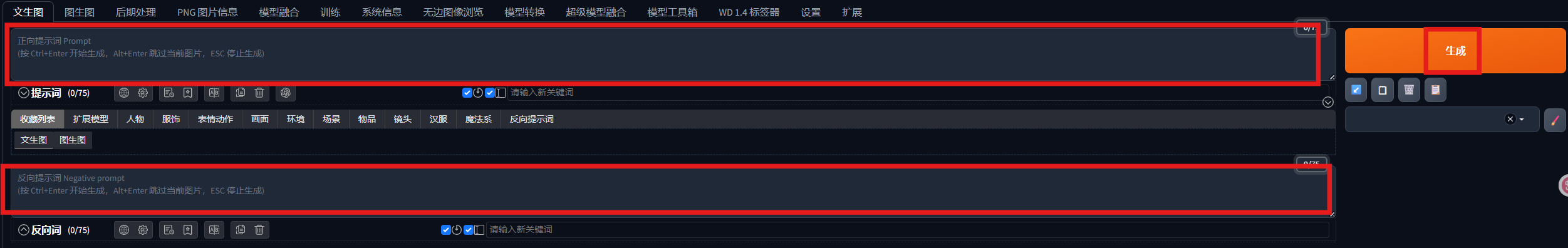

切换到想要的模型后,在正向提示词框里面输入你想要绘制的内容,在反向提示词里面输入你不想要的内容,再点击橙色的生成按钮,就可以绘制你的第一张图了!

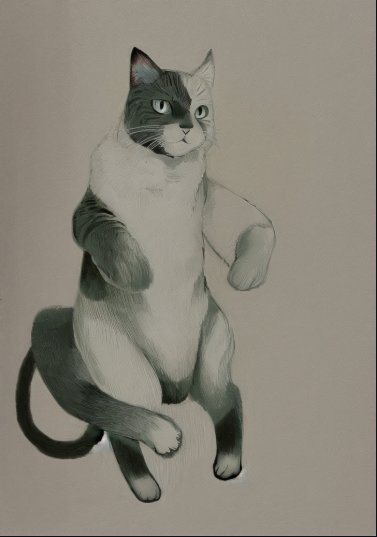

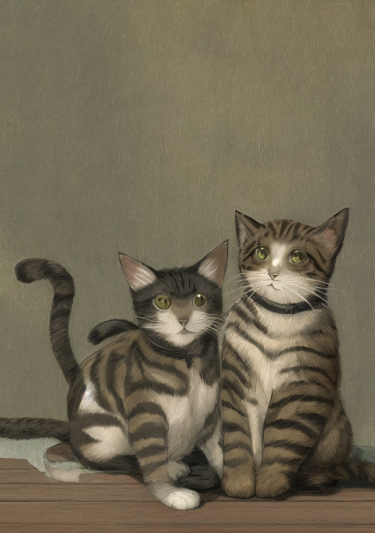

比如:在正向提示词里面输入:a cat

你便成功得到了一只猫!

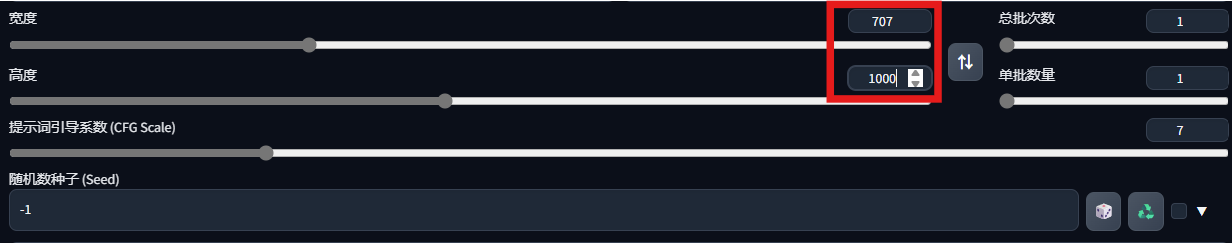

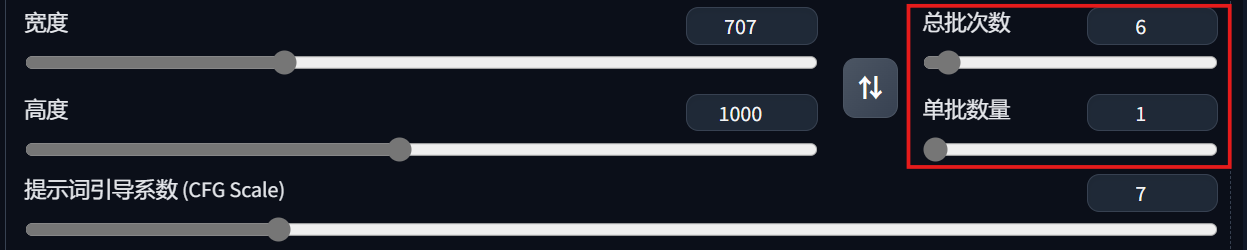

在宽度和高度这边可以选取你想要绘制的图片大小(我选了707x1000,模拟a4纸1:$ \sqrt{2} $的长宽比)

在这里可以选择总批次数和单批数量(总共生成a次,每次b张,因此最后有a*b张图片。单批数量很吃显存,建议4gb显存选1,8gb显存不超过3)

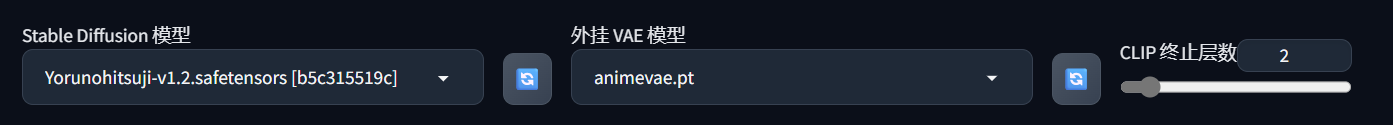

然后是整个界面最上方的三个参数:sd模型,VAE模型,CLIP终止层数。sd模型是决定整个生成基调的,需要根据你所运用的领域来选择,上方下载模型主要就是指下载sd模型。

“外挂 VAE 模型” 的作用是 修正色彩偏差、强化风格特征、修复细节丢失,选不同 VAE,会让同一组提示词生成的图,在 色调、质感 上天差地别。该软件会自带两个vae,简介如下:

animevae.pt:

专门优化 二次元风格 的 VAE,适合生成动漫、插画,让色彩更鲜亮,线条更硬朗。vae-ft-mse-840000-ema-pruned.safetensors:

通用型 VAE(常被称为 “SD 1.5 官方 VAE” ),对写实、二次元都有适配性,细节还原好,适合解决 “画面发灰” 问题。

CLIP 负责文本与图像的语义对齐,其终止层数影响文本与图像关联强度,直接控制模型对提示词的理解深度。层数给的越低,创作更自由,但是会导致提示内容缺失,甚至忽略提示词;层数越高,会越抠提示词的细节,产出内容也会更贴合提示词。

但是但是,如果你的提示词模糊不清(比如只有a girl),clip层数别太高了,不然会因为"过度抠细节",导致作画崩坏,产出古神级作品。

比如我只输出a cat,clip层数给12,看一眼结果:古神级别

clip层数给8:

clip层数给4:

clip层数给1:可以看到,提示词a cat的a已经没了

因此,当提示词相当明确或者你想要ai绘画结果更贴合提示词更不发散,可以提高clip层数,反之则降低clip层数。

2. 提示词输入

2.1 设置

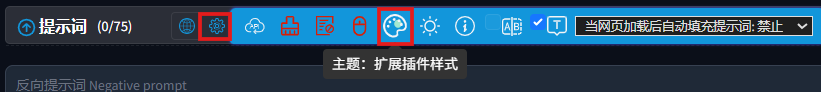

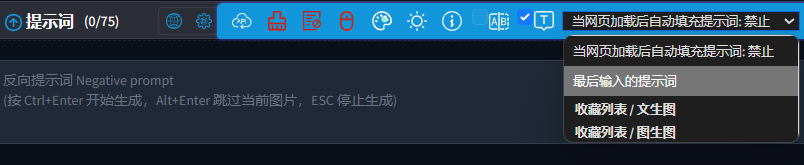

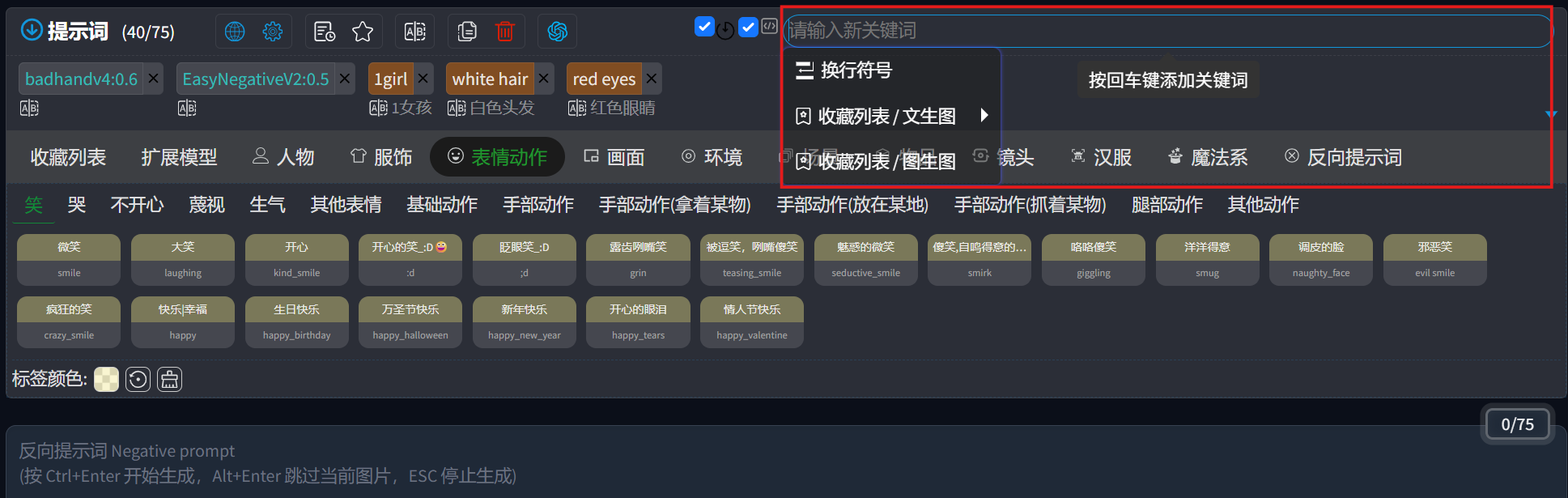

提示词右边的小按钮,分别是语言、设置、历史记录、收藏列表、翻译关键词、复制关键词、删除关键词,当我们的鼠标放在上面的时候会有详细说明。

当鼠标停留在设置按钮上,右侧会弹出一系列设置选项,选择这个调色盘可以改变样式,选择一个比较好看的。再右边一格的太阳可以切换深色与浅色主题,还是深色好看。

浅色主题预览:

这边建议修改为"最后输入的提示词",不然卡机刷新一下,你的提示词就得重写了

2.2 扩展模型

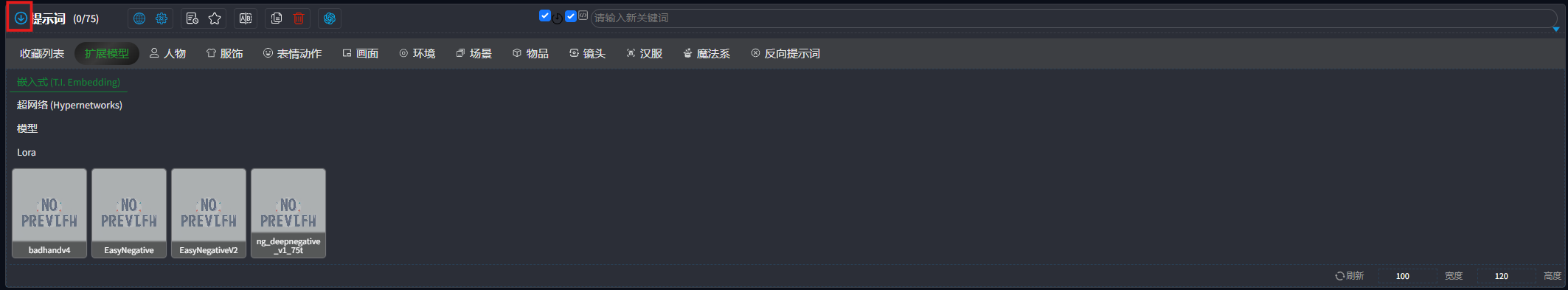

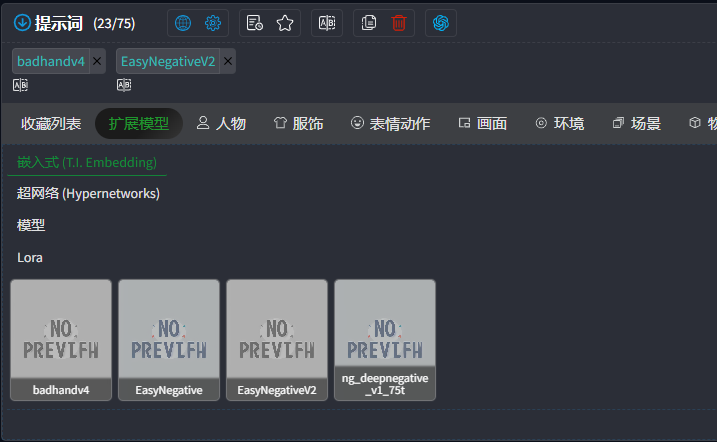

点击提示词左边的箭头后,会出现如下ui,这个是内置了github上的开源仓库,可以快速帮助大家选择提示词!

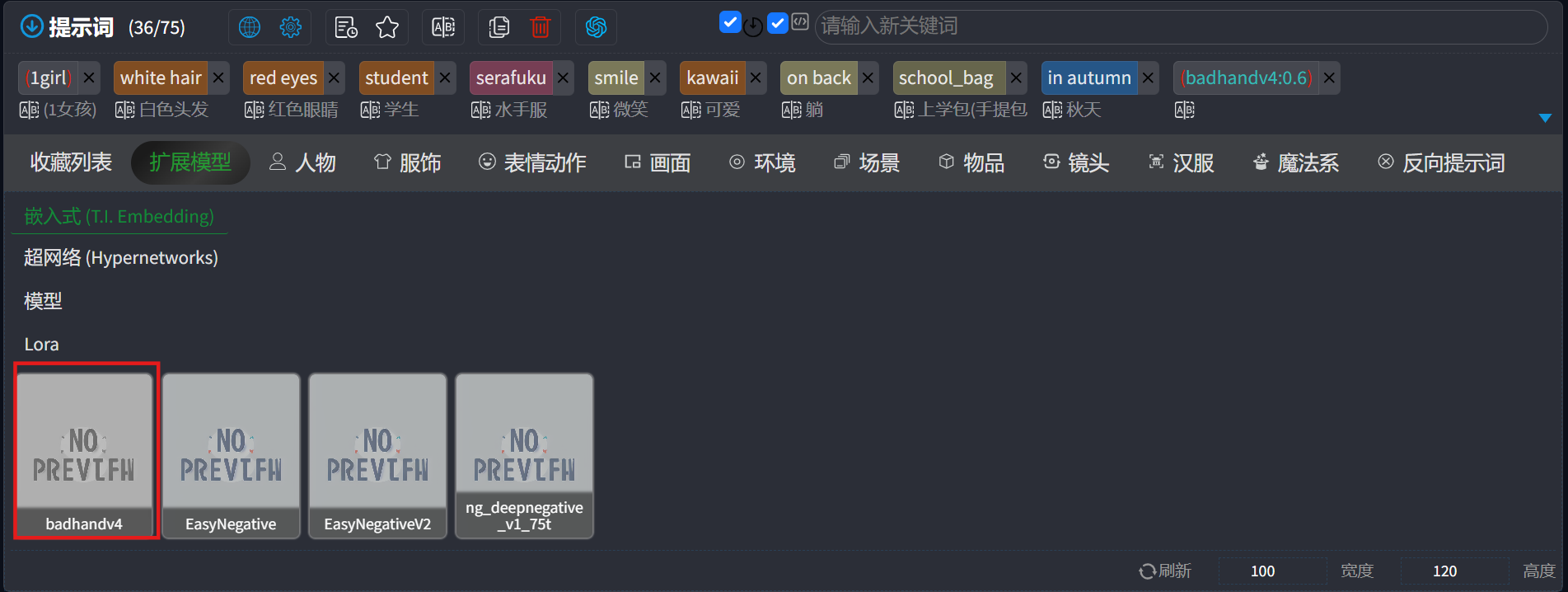

先介绍一下这个扩展模型,专门放额外加载的辅助模型(不是基础大模型),可以在原始模型的基础上添加少量可训练的参数来适应特定任务。说白了就是快速转变风格。这些可以在启动器的模型下载界面下载。三个扩展模型介绍如下:

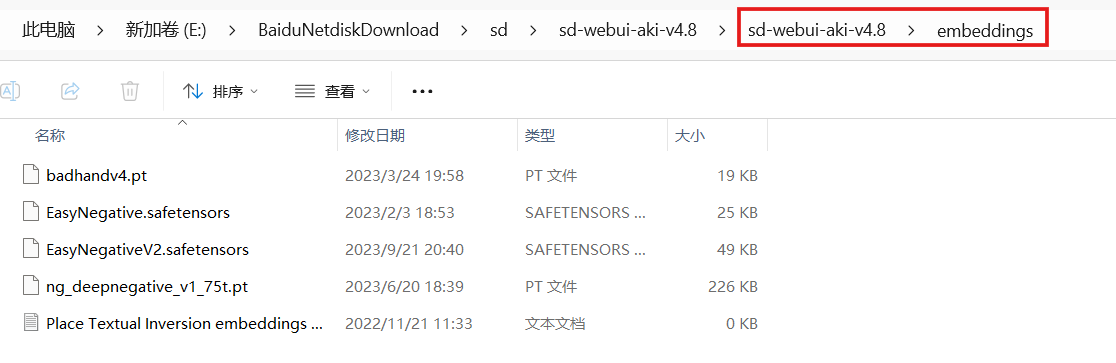

- Lora:最常用!能给绘图快速加特定风格(比如汉服、动漫脸)、属性(比如手绘质感),你界面里显示的

badhandv4、EasyNegative这些,就是 Lora 文件(EasyNegative系列是用来减少画面瑕疵、优化构图的 “反向优化” Lora)。 - Embedding(嵌入式):通过注入特定语义,影响绘图风格/元素,比如让人物更符合某种审美,体积小、针对性强。

- Hypernetworks(超网络):调整模型生成逻辑,影响整体风格走向,比 Lora 影响范围大,新手用得少些。

从图中可以看到,已经预置了4个lora模型,作用分别如下:

- badhandv4:专门优化手部绘制,解决 AI 绘图常见的 “手畸形、比例怪异、细节错乱” 问题,让人物手部更自然合理,是修手 “刚需” Lora 。

- EasyNegative:把一堆通用负面提示词(比如画面杂乱、比例失调、画风怪异等)“打包”,只需调用它,就能让 AI 主动避开这些瑕疵,简化负面提示词输入,提升出图整体质量 。

- EasyNegativeV2:是 EasyNegative 的升级版,在规避画面问题上更精准,对色彩、质感的优化也有提升,相比旧版,能让画面细节更干净、风格更统一 。

- ng_deepnegative_v1_75t:深度优化负面效果,除了基础的画面瑕疵,还能抑制一些 “诡异风格、不合理元素”(比如奇怪光影、不自然的装饰),让画面更贴合正常审美,适合追求高品质出图的场景 。

但是当你下载一堆模型后,别一股脑使用,注意如下:

看需求精简:

如果只是画普通人物,badhandv4 + 1 个通用负向 Lora(比如 EasyNegativeV2)就够。叠加太多负向 Lora,可能让画面 “过度优化”(比如色彩变寡淡、细节被压没),尤其新手容易忽略这点~

控制权重:

每个 Lora 后面的 :权重 别太高(比如 0.3 - 0.8 之间)。Lora 权重总和建议别超 1.5,否则模型难平衡效果,画面容易变怪。

搭配正向提示词测试:

叠加后,一定得用不同正向词测试,看负向 Lora 会不会 “误伤” 你想要的风格。要是发现画面变僵硬、风格被压制,就减 Lora 数量或调低权重。

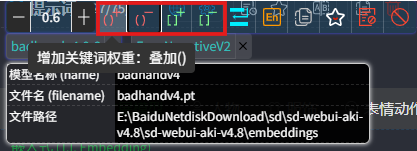

2.3 扩展模型权重调整

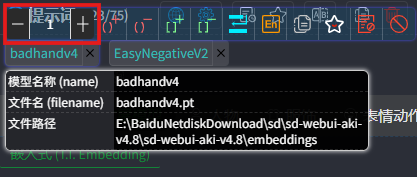

调整权重:将鼠标停留在模型上后,会浮现出选项框,第一个就是权重,可以便捷调整,默认为1。

Lora 模型的权重建议值需根据 模型类型(正向/负向)、功能强度、与基础模型的兼容性 来调整,以下是分情况的推荐范围:

负向优化类 Lora(如修手、去瑕疵):

推荐权重:0.3 - 0.8

这类 Lora 主要 “抑制” 瑕疵(如手部畸形、画面杂乱),权重过高会导致 过度优化(如画面变模糊、细节丢失)。badhandv4(修手):建议 0.5 - 0.7,手崩严重时可用 0.8。EasyNegativeV2(通用去瑕疵):建议 0.4 - 0.6。ng_deepnegative_v1_75t(深度去瑕疵):建议 0.3 - 0.5(因其效果较强)。同时用多个负向 Lora 时,总权重建议不超过 1.5(如 badhandv4:0.6 + EasyNegativeV2:0.6 + ng_deepnegative:0.3),否则可能让画面 “失去活力”。

正向风格类 Lora(如特定画风、角色):

推荐权重:0.7 - 1.2

这类 Lora 需要足够强度才能 “覆盖” 基础模型风格,权重过低会导致效果不明显。动漫风格 Lora(如 anime_style):建议 0.8 - 1.0。特定角色 Lora(如 character_name):建议 0.9 - 1.2(需贴合角色特征)。混合风格 Lora(如 “赛博朋克 + 古风”):建议 0.7 - 0.9(避免风格冲突)。若基础模型与 Lora 风格差异大(如用写实模型加载动漫 Lora),可能需更高权重(如 1.0 - 1.2)。但是权重过高可能导致 风格溢出(如皮肤质感异常、光影不自然),需通过 反向提示词 修正(如 bad anatomy, strange lighting)。

这四个是括号语法,是通用的 “权重调节语言”。

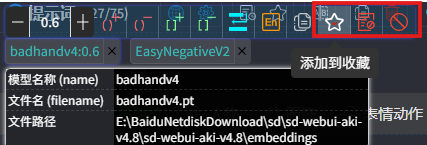

这边可以选择收藏词条,禁用词条和删除词条,建议常用的可以收藏。

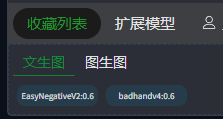

收藏后,在收藏列表里面可以快速选择

经过我的反复多次实验,对于这一部分,我只推荐用bandhandv4这个模型,其他模型引入了全是负提升…无论给多少的权重。

2.4 其他提示词输入

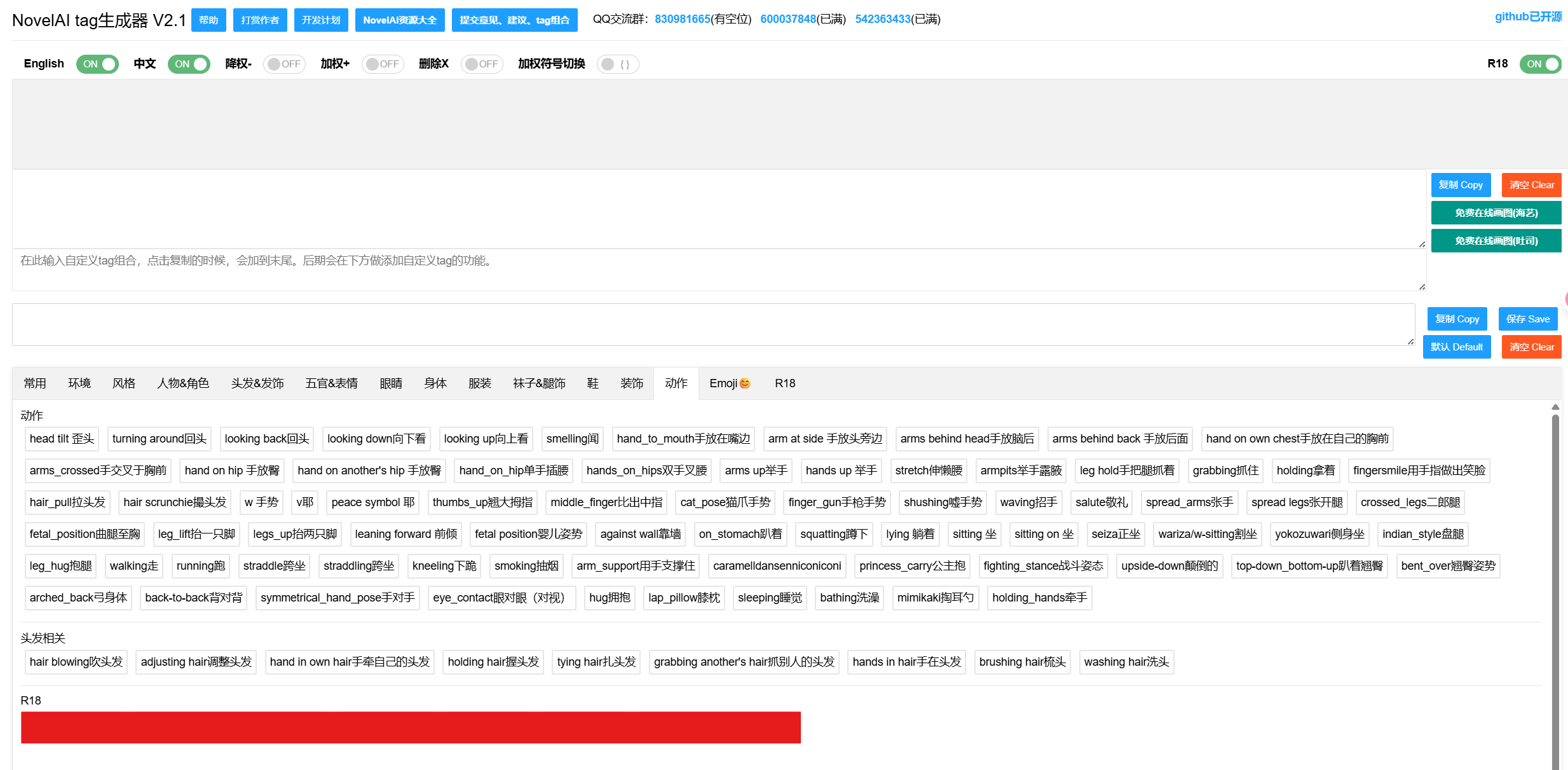

其他提示词很好理解,都有中英文对照,成百上千的关键词等你挑选

同时我推荐一个网站:https://wolfchen.top/tag/

这是一个标签生成的网站,也是蛮好用的

同时每个类型的标签都有一个标签颜色以供区分,可以在这里切换各类提示词的颜色以及重置颜色。

在这里可以自己添加提示词,按回车键即可添加

2.5 负向提示词

负向提示词就是选择你不想要出现什么,比如你想要角色不笑,但是花了几张都在笑,你就可以把笑给添加到反向提示词,如果你不想出现天空,可以把天空加入反向提示词。

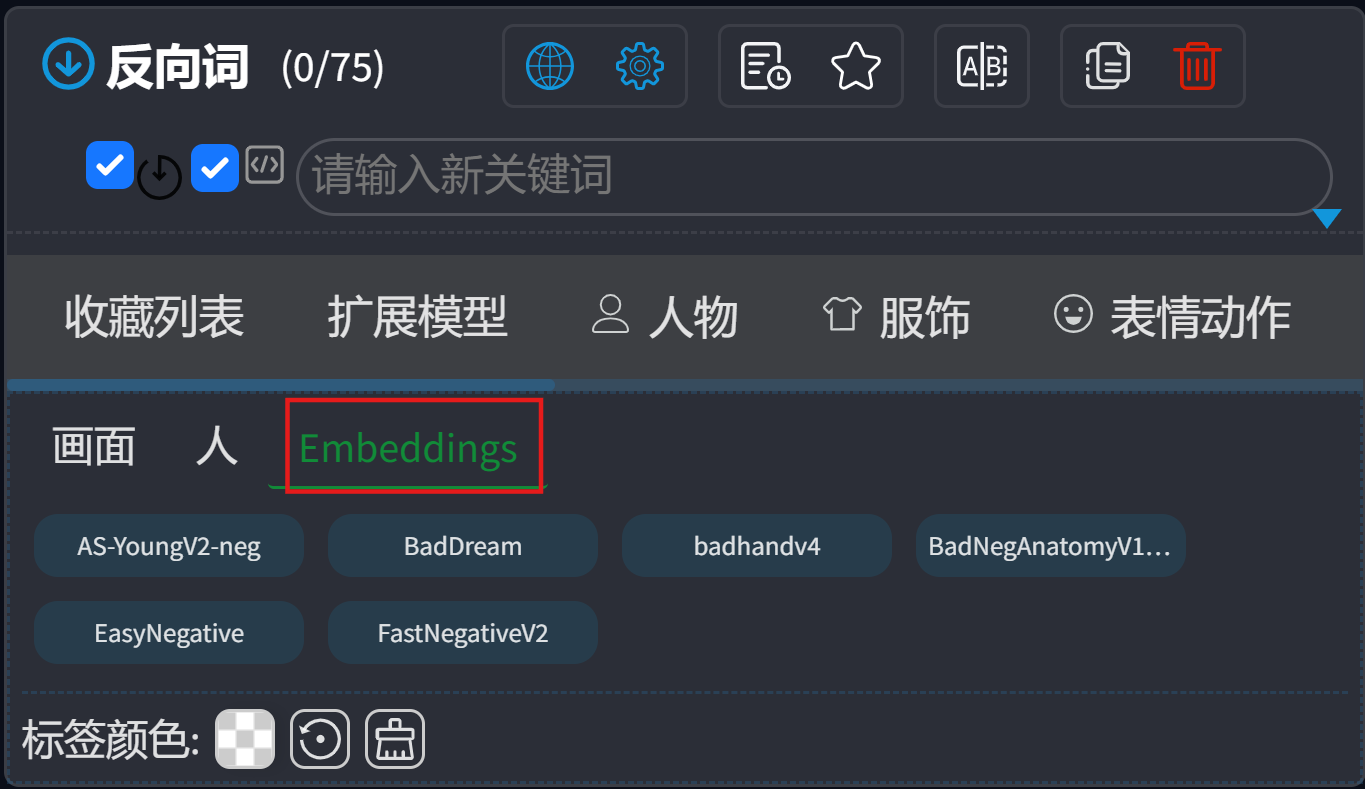

然而,反向提示词还有一个重要的功能,就是优化画面。这个软件已经帮我们整理好了常用的标签并转为了Embedding,这里着重介绍一下

Embedding 是一种 “预训练关键词集合”,把一堆负面描述(比如画面杂乱、比例失调、画风诡异)“打包” 成一个模型。放到反向提示词里,AI 就会主动 规避这些瑕疵,让生成的图更贴合预期。

可以看到,软件里面有6个Embedding。作用如下:

- AS-YoungV2-neg:针对 “AS-YoungV2” 风格(年轻女性画风)的反向优化,减少该风格下常见的瑕疵(比如面部不自然、色彩怪异)。

- BadDream:抑制 “诡异梦境感” 的元素,避免画面出现奇怪的扭曲、不合理的光影(比如让图别太像 “噩梦场景”)。

- badhandv4:专门优化手部绘制!解决 AI 绘图最头疼的 “手畸形、比例奇怪” 问题,反向词里加它,手部崩坏概率大幅降低(和同名 Lora 功能互补,一个是反向词 Embedding,一个是模型插件)。

- BadNegAnatomyV1:抑制 “人体结构错误”,比如奇怪的肢体比例、骨骼扭曲,让人物/生物的身体结构更合理。

- EasyNegative:通用型负面包,涵盖一堆基础瑕疵(画面杂乱、模糊、比例失调),新手必备,反向词里加它,能解决 80% 的 “低级错误”。

- FastNegativeV2:EasyNegative 的升级版,优化更精准,对色彩、细节的把控更好,适合追求高质量出图的场景。

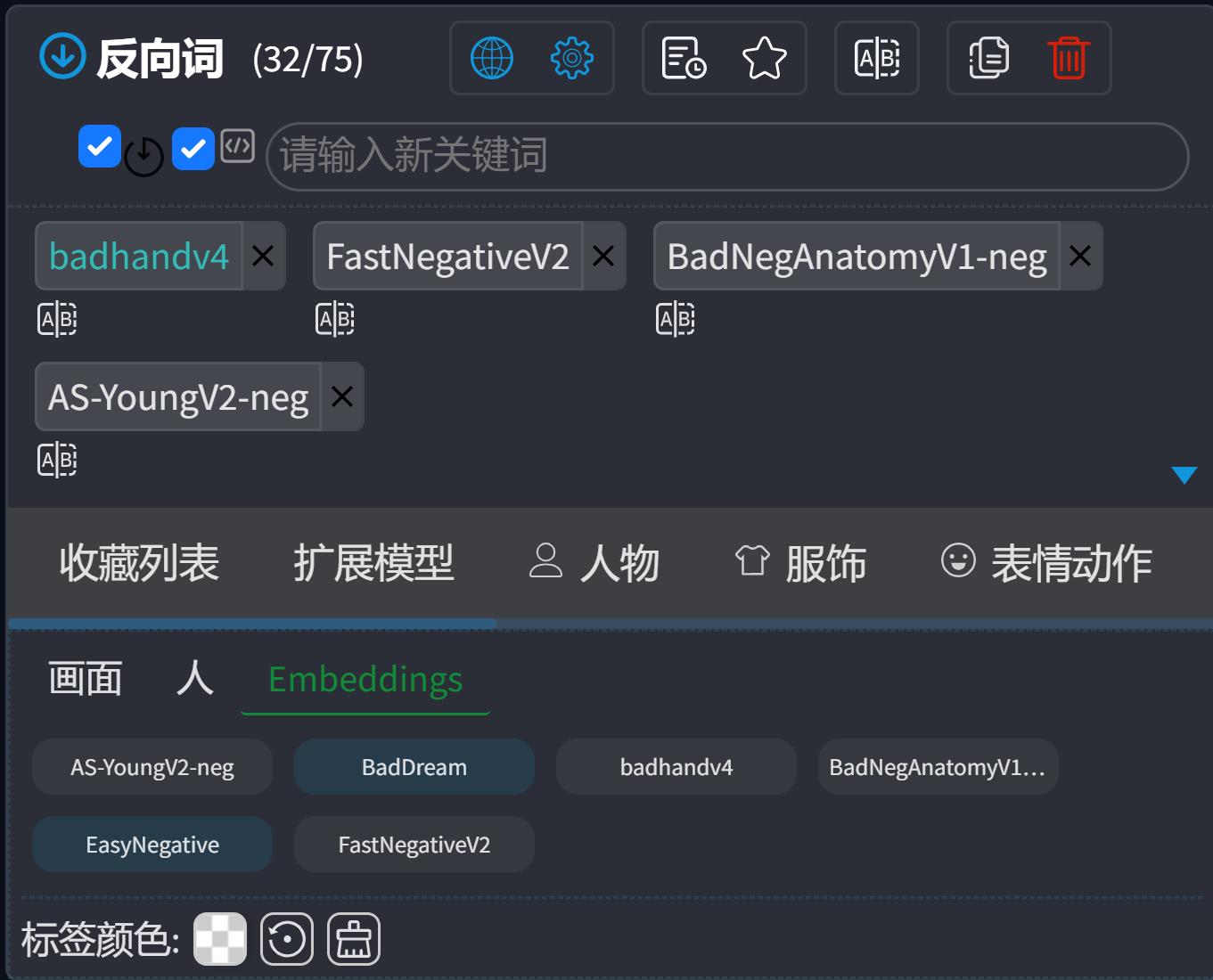

这个一般不需要改权重。我选择了以下作为反向词

2.6 生成参考

纯扩散模型随机性实在是太强了!质量也参差不齐,往往需要生成很多张才能挑到一张想要的。使用controlnet可以缓解这一点,这个之后再说。下面跑个例子:

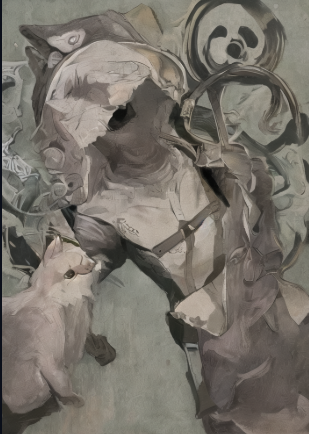

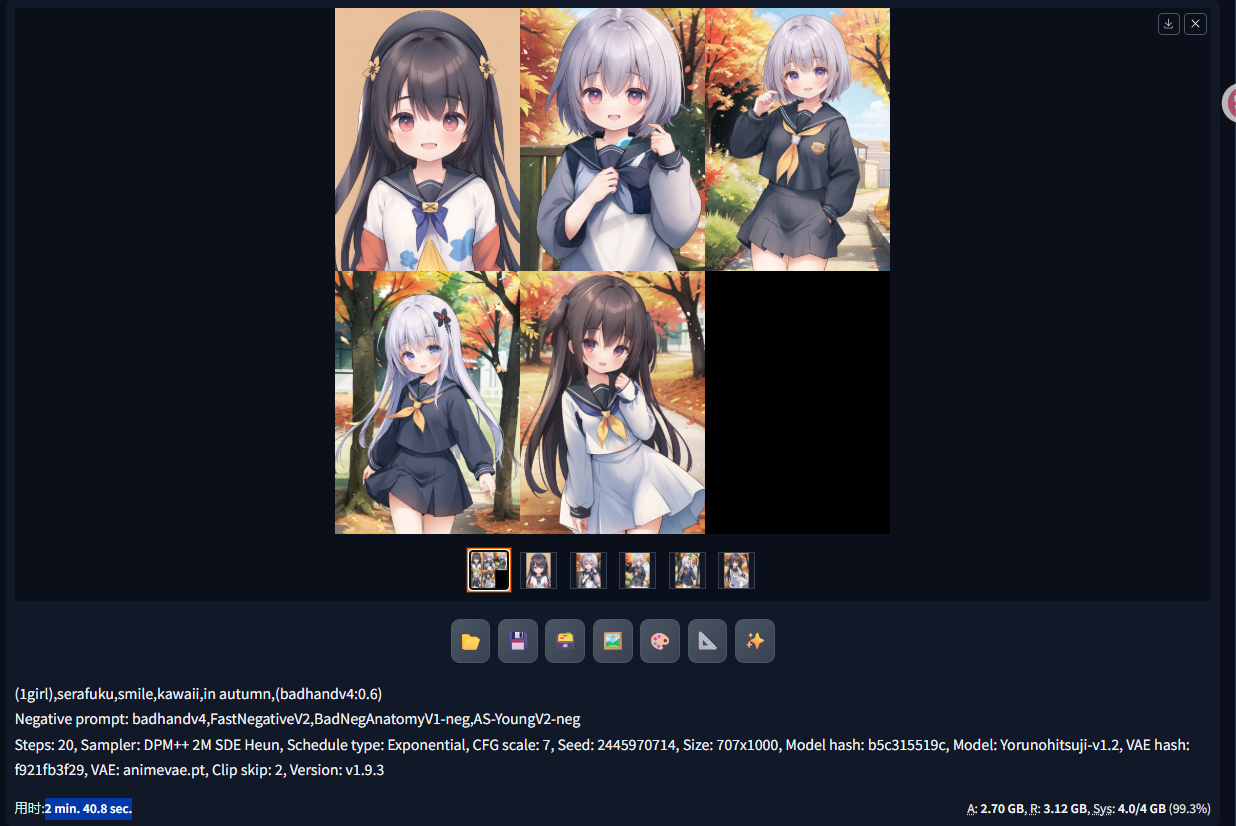

选择sd模型:夜羊社v1.2

选择vae模型:animevae.pt

clip层数:2

正向提示词:(1girl),serafuku,smile,kawaii,in autumn,(badhandv4:0.6)

反向提示词:badhandv4,FastNegativeV2,BadNegAnatomyV1-neg,AS-YoungV2-neg

大小:707x1000

生成结果如下:

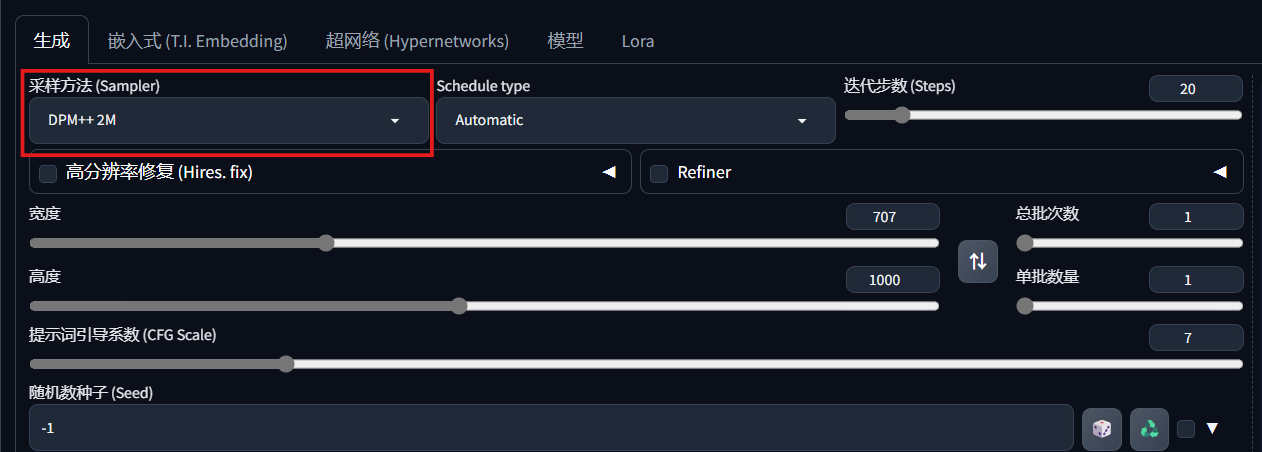

3. 采样方法

位于图中位置

有如下选项

采样方法控制图像生成的迭代优化逻辑 ,决定了模型如何逐步优化图像 :从随机噪声开始,每一步 “采样” 修正细节,直到生成最终画面。不同方法的差异在于优化策略(比如 “大步修正” 还是 “精细调整” ),进而影响出图效果,主要是细节和生成速度 。

选择合适的采样器:理论上应该这么选

- 追求速度 → LCM(速度较快)> UniPC(5 - 10 步)> Euler(20 - 30 步)

- 追求细节 → DPM++ 2M SDE Heun(极致细节)> DPM++ 2M SDE(高细节)> DPM++ 2M(平衡)

- 追求创意 → Euler a(艺术感)> DPM2 a(创意 + 细节)

- 日常通用 → DPM++ 2M(新手首选,适配绝大多数场景 )

我的显卡是很垃圾的2050,显存4gb,使用前面的提示词。

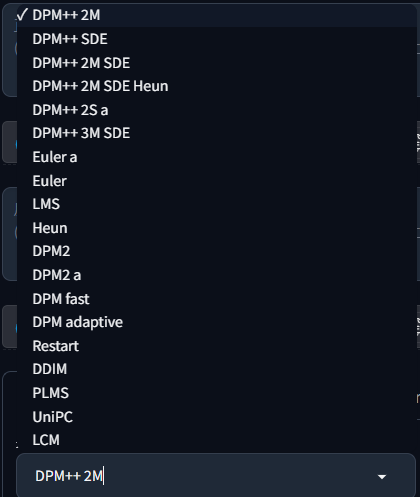

LCM示例:

生成5张耗时2 min. 40.3 sec.这个方法r率怎么这么高…不是哥们

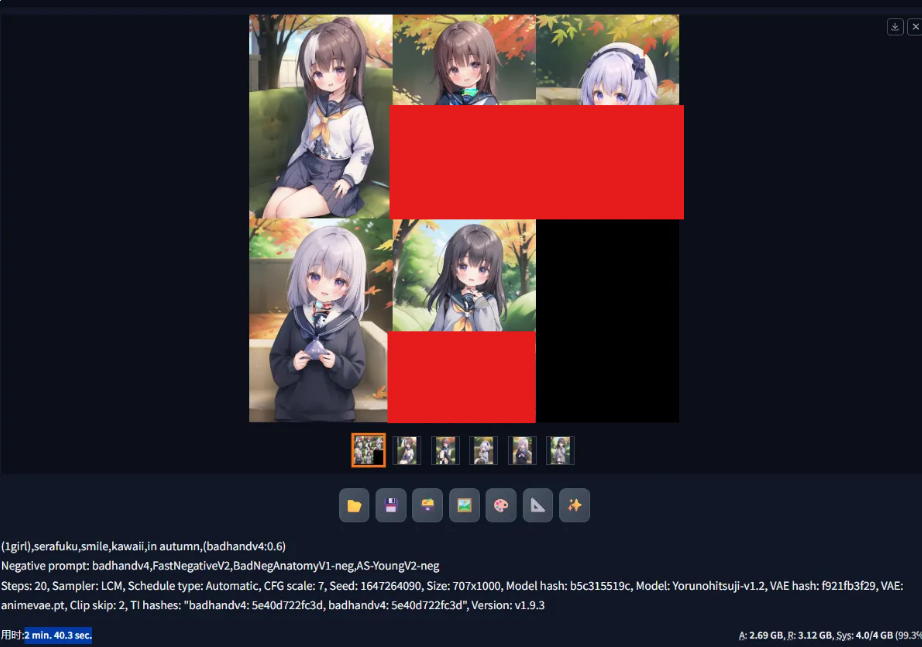

DPM++ 2M示例:

生成5张耗时用时:2 min. 38.9 sec.

DPM++ 2M SDE Heun示例:

生成5张耗时2 min. 40.8 sec.

评价是,大差不差的。后面经过搜索和尝试,发现是我的步数设的太低了,只设置了20步 ,复杂算法的额外计算量还没体现出来,导致时间接近。

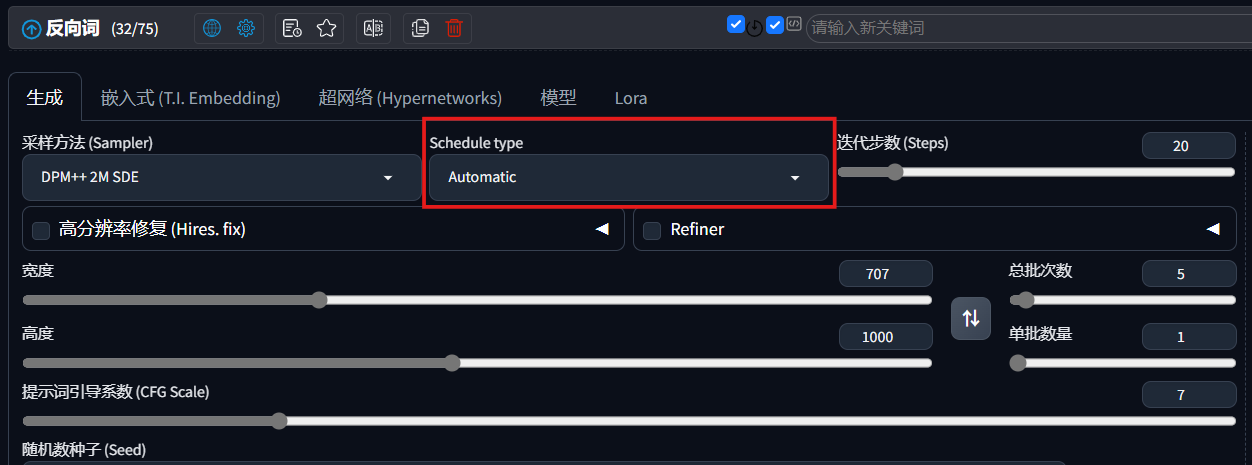

4. 噪声调度器

位于这个位置:

有如下选项:

生成图像时,模型要从全噪声逐步去噪得到清晰画面。噪声调度器决定了每一步去噪时,噪声强度如何降低 ,直接影响画面的 细节、风格和收敛速度。

- 快节奏(如 Uniform ):噪声降得快,画面收敛快但细节少;

- 慢节奏(如 Karras ):噪声降得慢,画面细节多但生成时间长。

只推荐选择如下调度器:

- Karras:

最常用的调度器!由 Stable Diffusion 团队优化,平衡细节和收敛速度,适合绝大多数场景(尤其是写实、二次元 )。

特点:去噪节奏合理,画面细节丰富且稳定,新手无脑选。 - Automatic

自动适配的调度器,会根据采样方法和步数 “智能选节奏”,效果接近 Karras ,适合不想纠结参数的懒人。 - Uniform:

噪声强度 “匀速降低”,去噪节奏最快,画面收敛极快但细节少,适合生成抽象、低精度的图(比如快速测试提示词 )。 - Exponential:

噪声强度 “指数级降低”,前期去噪慢(保留多噪声 → 多创意 ),后期快收敛,适合生成 艺术感强、风格独特 的图(比如印象派、梦幻场景 )。

噪声调度器 + 采样方法相互影响 ,比如:

- Karras(调度器) + DPM++ 2M(采样) → 日常出图最优解;

- Exponential(调度器) + Euler a(采样) → 艺术创意拉满,适合抽象画。

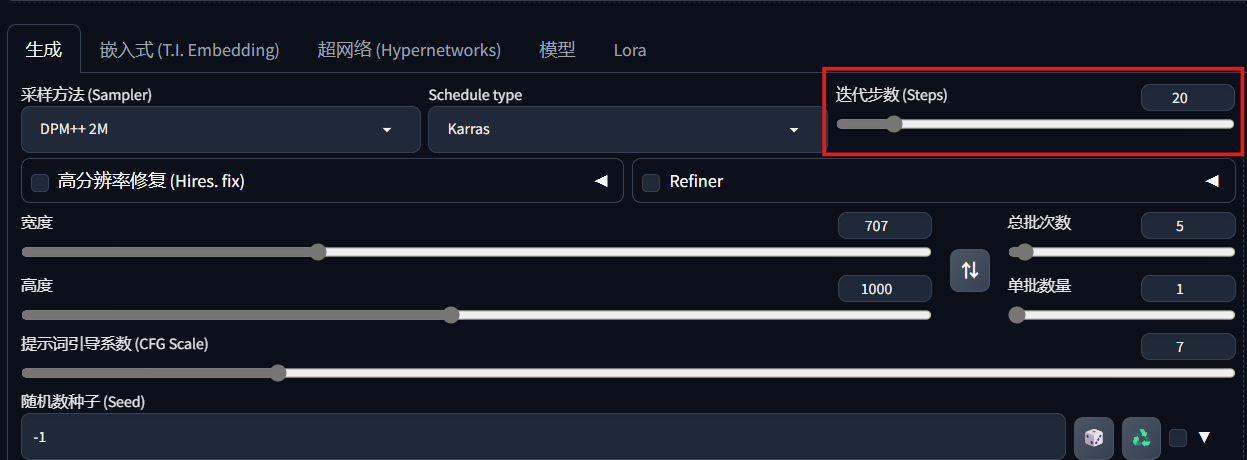

5. 迭代步数

位于ui的这个地方:

生成图像时,模型从全噪声图开始,每一步 “迭代” 都会去除部分噪声、优化细节 ,最终得到清晰画面。迭代步数就是这个过程经历了几次,直接影响画面的细节、质量和生成时间。

1. 低步数(如 10 - 20 步)

- 效果:画面细节少、模糊(噪声没完全去除 ),但生成速度快。

- 适用场景:快速测试提示词(看大致构图是否可行 )、生成草稿图。

2. 中步数(如 20 - 40 步)

- 效果:画面细节逐渐丰富(轮廓清晰、基本元素完整 ),速度和质量平衡。

- 适用场景:日常出图(二次元、插画 )、对细节要求不极致时。

3. 高步数(如 40 - 100 步)

- 效果:画面细节极致(发丝、纹理、光影过渡自然 ),但生成时间长。

- 适用场景:写实肖像、商业级插画、高精度场景(如建筑、风景 )。

步数不是越高越好,步数过高会遇到 “边际效应” :超过50 - 60步后,细节提升越来越不明显,但时间大幅增加。同时步数需和**采样方法、模型、分辨率** 配合。创意采样(如 Euler a )和相关模型需要步数稍高才能体现艺术细节,而图片分辨率越高,步数也要越高才能避免细节丢失。

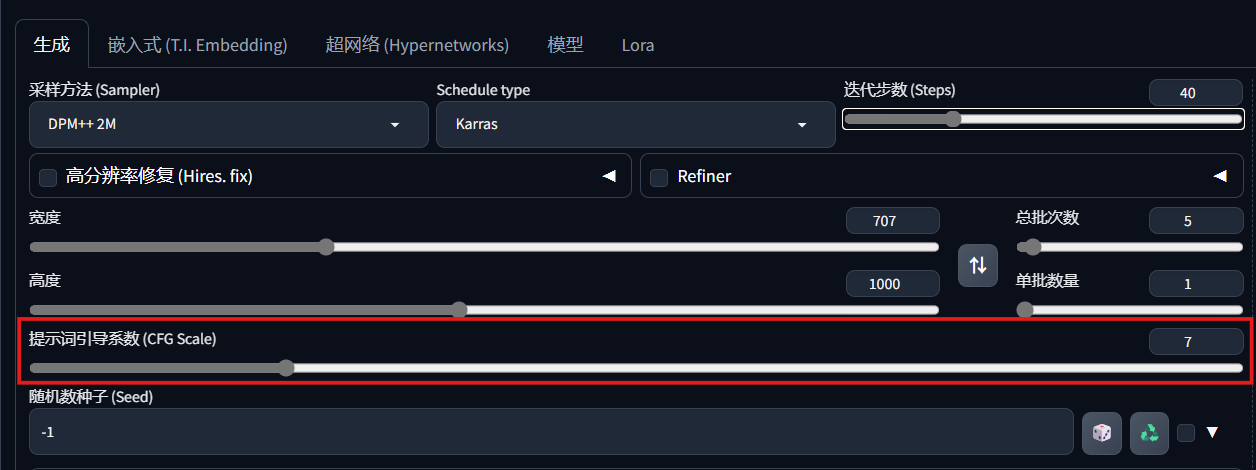

6. 提示词引导系数

位于ui的这个地方:

提示词引导系数控制提示词对生成图像影响强度,值越小,生成的图可能和提示词偏差大,但艺术创意足(适合抽象、超现实风格 )。值越大 ,AI 越 严格听话,生成的图更贴近提示词描述,但可能丢失一些随机性(适合写实、精准需求 )。日常出图首选7。

乍一看和clip层数的效果有点相似。但是clip层数主要影响的是提示词的挖掘深度,cfg影响的是提示词和整个画面的关联程度。比如想生成 “赛博朋克城市”,通过调整 CFG Scale 控制城市与赛博朋克风格的贴合度,调整 CLIP 终止层数控制对 “赛博朋克城市” 语义细节的挖掘深度,共同作用于最终画面 。实际绘图中,改变其中一个参数,可能需要调整另一个来达到最佳效果 。比如调高 CLIP 终止层数(让模型更抠细节 )时,若发现画面生硬,可适当降低 CFG Scale 来平衡;降低 CLIP 终止层数追求创意时,若画面太偏离,可提高 CFG Scale 拉回与提示词的关联 。

备注:

- 日常出图 选 7 - 9(平衡省心又出效果 )。

- 创意风格 选 3 - 5(让 AI 自由发挥 )。

- 写实 / 精准需求 选 10 - 12(但注意别太高,容易崩 )。

- 数值>15 时,必须拉高迭代步数(如 50 + ),否则画面大概率崩坏。

- 迭代步数低, CFG 别太高(否则画面崩 );

- 提示词复杂,CFG 适当拉高(让 AI 抓住细节 );

- 用 LCM 等快速采样, CFG 调低(如 1 - 2 ,否则冲突 )。

示例:以a cat作为提示词,迭代步数为20

cfg=30:

cfg=15:

cfg=7:

cfg=1: