引言

随着大语言模型(LLM)的广泛应用,如何高效地进行 模型微调、推理和服务部署 成为开发者关注的核心问题。

在众多开源框架中,来自阿里巴巴的 Swift(全称:ModelScope Swift 或简称 MS-Swift)正逐渐成为国内开发者首选的大模型训练与部署工具之一。

它不仅支持主流大模型的轻量化微调(如 Qwen、ChatGLM、Baichuan 等),还提供一键式 Web UI、多模态任务支持和生产级服务导出能力。

一、什么是 Swift?

📌 Swift 是由 阿里云 ModelScope 团队 开源的一套面向大模型(LLM)的 全流程训练与部署框架,目标是:

让每个人都能轻松完成大模型的微调、评测与上线。

GitHub 地址:👉 https://github.com/modelscope/swift

虽然名字叫 “Swift”,但它与苹果的编程语言无关,而是取“快速、敏捷”之意,强调其在大模型开发中的高效性。

🔹 主要特性

| 特性 | 说明 |

|---|---|

| ✅ 支持主流大模型 | 包括 Qwen、ChatGLM、Baichuan、InternLM、XVERSE、Yi 等 |

| ✅ 多种微调方式 | LoRA、QLoRA、Freeze、Full-tuning 等 |

| ✅ 高效低显存 | 使用 QLoRA 可在 24GB 显存上微调 7B/14B 模型 |

| ✅ 图形化界面 | 内置 Web UI,无需代码即可操作 |

| ✅ 中文优化好 | 对中文语料、分词、指令微调有专门优化 |

| ✅ 一键部署 | 支持导出为 Hugging Face、ONNX、Triton、vLLM 等格式 |

| ✅ 多模态扩展 | 支持图像描述、语音识别等跨模态任务 |

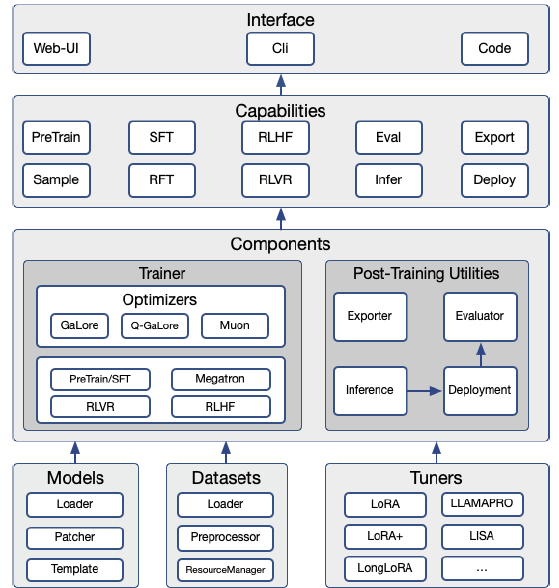

🔹 框架

二、为什么选择 Swift?对比 LLaMA-Factory

Swift 和 LLaMA-Factory 都是当前热门的大模型微调框架,它们有何异同?

| 对比项 | Swift | LLaMA-Factory |

|---|---|---|

| 开发团队 | 阿里云 ModelScope | 社区独立开发者 |

| 支持模型 | Qwen 系列优先,兼容性强 | 支持更广(含 LLaMA3、Yi 等) |

| 微调方式 | LoRA、QLoRA、P-Tuning 等 | 全面支持多种方法 |

| 显存优化 | QLoRA + FlashAttention 支持 | 同样支持 QLoRA |

| Web UI | 内置强大图形界面 | 提供基础 WebUI |

| 部署能力 | 支持 Triton、vLLM、SageMaker | 主要支持本地/HF |

| 中文支持 | 极强,专为中文场景优化 | 良好 |

| 扩展性 | 支持多模态、Agent、Function Call | 以文本为主 |

✅ 总结:

- 如果你主攻 通义千问(Qwen)系列模型,追求 生产级部署能力,推荐使用 Swift。

- 如果你需要最大化的 模型兼容性和灵活性,可以选择 LLaMA-Factory。

三、核心功能详解

3.1 支持的模型类型

Swift 支持数十种主流大模型,尤其对阿里自研模型支持最好:

| 模型家族 | 示例 |

|---|---|

| 通义千问 Qwen | Qwen-7B、Qwen-14B、Qwen-VL(多模态)、Qwen-Audio |

| 智谱 AI | ChatGLM3-6B |

| 百川智能 | Baichuan2-7B/13B |

| 上海AI Lab | InternLM-7B/20B |

| 零一万物 | Yi-6B/34B |

| XVERSE | XVERSE-13B |

只需指定模型名称或路径,即可自动加载配置和分词器。

3.2 支持的微调方法

Swift 提供多种高效微调策略:

| 方法 | 说明 | 推荐场景 |

|---|---|---|

| LoRA | 低秩适配,只训练小矩阵 | 快速实验、资源有限 |

| QLoRA | 4-bit 量化 + LoRA,显存极低 | 单卡微调 7B/14B 模型 |

| Freeze | 冻结大部分层,只训练最后几层 | 小数据集迁移学习 |

| Full Fine-tuning | 全参数微调 | 追求极致性能,资源充足 |

🔹 推荐组合:QLoRA + Qwen-7B

--quantization_bit 4

--lora_rank 64

--lora_alpha 128

--lora_dropout 0.05

可在 RTX 3090(24GB) 上顺利运行!

3.3 内置 Web UI:无需代码也能微调

Swift 提供了基于 Gradio 的图形化界面,启动命令:

python web_demo.py

浏览器访问 http://localhost:7860,即可看到如下功能:

- 模型选择(本地或 HuggingFace)

- 数据集上传(支持 JSON/CSV)

- 微调参数设置(batch size、epoch、learning rate 等)

- 实时训练日志监控

- 对话测试微调效果

非常适合初学者或非技术人员使用。

五、适用场景举例

| 场景 | 实现方式 |

|---|---|

| 企业知识库问答 | 用内部文档微调 Qwen,构建专属客服机器人 |

| 代码生成助手 | 使用 CodeAlpaca 数据微调,提升编程能力 |

| 个性化写作 AI | 用个人写作风格数据训练,打造“数字分身” |

| 教育辅导系统 | 微调数学题解、英语作文批改能力 |

| 多模态应用 | 使用 Qwen-VL 微调图文理解任务 |

六、常见问题解答(FAQ)

❓ Q1:Swift 和 LLaMA-Factory 有什么区别?

- Swift 更侧重 生产级部署和中文优化,尤其是对 Qwen 系列支持最好。

- LLaMA-Factory 更偏向 通用性和模型广度。

❓ Q2:需要多少显存?

- Qwen-7B + QLoRA:24GB 显存足够(如 3090/4090)

- Qwen-14B + QLoRA:建议 48GB(A6000/A100)

❓ Q3:支持 Windows 吗?

✅ 支持!只要能运行 Python 和 CUDA 即可。

结语

Swift 是一个功能强大、易于使用的大模型训练框架,特别适合:

- 希望快速微调 通义千问系列模型 的开发者

- 需要将模型部署到生产环境的企业用户

- 想尝试 QLoRA、多模态、Agent 扩展 的研究人员

它不仅降低了大模型定制的门槛,也打通了从训练到上线的完整链路。