官方论文地址: 论文地址点击即可跳转

官方代码地址: GitCode - 开发者的代码家园

1 总述

当输入数据经过各层的特征提取和变换的时候,都会丢失一定的信息。针对这一问题:

- 论文中提出的可编程梯度信息(PGI)能够为目标检测任务提供完整的信息,进而计算目标函数,得到可靠的梯度信息来更新网络的权重参数。本文引入了DynamicDet架构作为设计可逆分支的基础。此外,可逆信息进一步引入到所提出的PGI中。所提出的新架构在推理过程中不需要额外的连接,因此可以完全保留速度、参数数量和准确性的优势。

- 论文中提出了基于梯度路径规划的新型轻量级网络结构-GELAN(Generalized Efficient Layer Aggregation Network, 广义高效层聚合网络)。GELAN优化了网络架构的参数利用率和计算效率,展现了轻巧、快速和准确的巨大优势。

- 论文使用GELAN改进架构,并使用所提出的PGI改进训练过程,然后得到了新一代YOLO系列对象检测系统-YOLOv9。使用MS COCO数据集进行实验,实验结果验证了提出的YOLOv9的性能相当优秀。

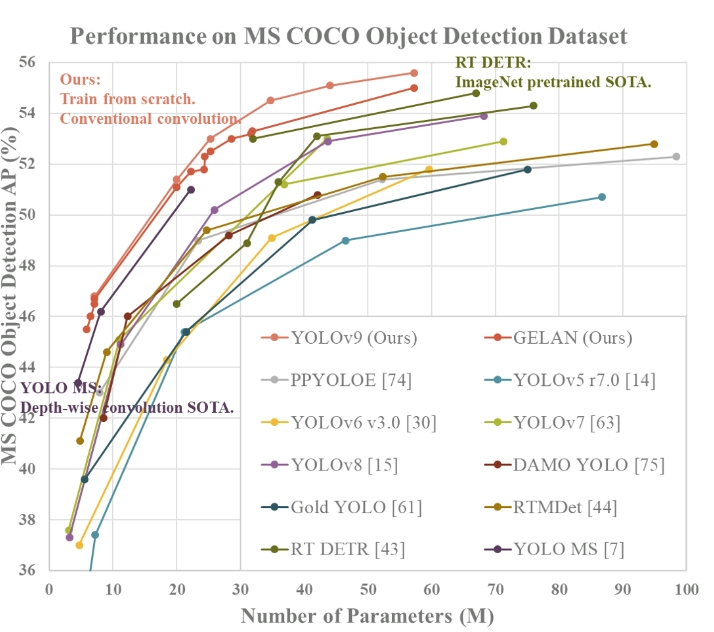

接下来,我们先看看YOLOv9的表现,如下图:

从上图可以看出:基于GELAN和PGI的对象检测方法在对象检测性能方面超越了之前的所有从零开始训练的方法。在准确性方面,新的方法优于预训练的RT - DETR ,并且在参数利用率方面,它也优于基于深度卷积设计的YOLO MS。

2 信息丢失问题

在深度网络中,输入数据在前向传播过程中丢失信息的现象通常被称为信息瓶颈。目前,可以缓解这种现象的主要方法如下:

- 使用可逆架构:这种方法主要通过重复使用输入数据并以显式方式保持输入数据的信息。这种方法需要额外的层来组合重复输入的数据,这将显著增加推理成本。同时还存在输入数据层到输出层的路径不能太深这一限制。

- 使用掩码建模:主要通过重构损失使用隐式方式最大化提取的特征并保留输入信息。掩码建模的重构损失有时与目标损失冲突。除此之外,大多数掩码机制也会有产生错误的数据关联的情况。

- 引入深度监督概念:它使用尚未丢失太多重要信息的浅层特征,预先建立从特征到目标的映射,以确保重要信息可以传输到更深的层。但是,这种方法会产生错误累积,如果浅层监督在训练过程中丢失信息,后续层将无法检索所需的信息。

综上所述,上述方法在训练过程和推理过程中都有不同的缺点或问题,在困难任务和小型模型上会更加显著。

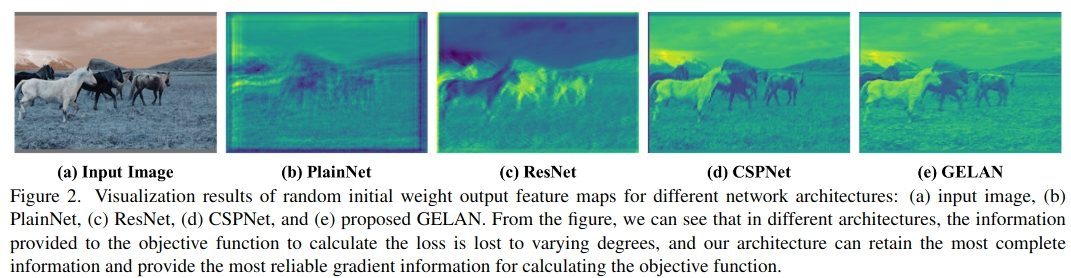

从上图可以看出:不同网络架构的随机初始权重输出特征图的可视化结果。

(a) 输入图像,(b) PlainNet,(c) ResNet,(d) CSPNet,和 (e) 本文的GELAN。从这些可视化结果中,提供给目标函数用以计算损失的信息在不同程度上有所丢失,而提议的GELAN架构能够保留最完整的信息,并为计算目标函数提供最可靠的梯度信息。这对于目标检测等任务至关重要,因为信息的完整性直接关系到网络最后预测的准确性。

3 PGI

可编程梯度信息(PGI)就是为了解决输入数据在前馈过程中丢失信息的问题而设计的。PGI机制(使得轻量级模型能从辅助监督机制中受益)可以应用于各种大小的深度神经网络,更为通用。

① 信息瓶颈

数据X在经过变换时可能会导致信息损失,公式如下:

解决上述问题的方法是增加模型的大小。这一方法允许即使在数据前馈过程中丢失了信息,仍有机会保留足够的信息以执行到目标的映射。上述现象解释了为什么在大多数现代模型中宽度比深度更重要。然而,上述结论不能从根本上解决非常深的神经网络中不可靠梯度的问题。

② 可逆函数

当函数r具有逆变换函数v的时候,称这个函数r为可逆函数,如下述公式(2)所示。

![]()

数据X通过可逆函数转换而不丢失信息,如下述公式(3)所示。当网络的转换函数由可逆函数组成时,可以获得更可靠的梯度来更新模型,如下述公式(4)所示。尝试找到r的逆变换v,以便转换后的特征可以使用稀疏特征保留足够的信息,公式(5)如下所示。信息瓶颈的公式如公式(6)所示。

![]()

![]()

轻量级模型本身处于欠参数化状态,因此在前馈阶段很容易丢失大量重要信息。因此,对轻量级模型的目标是如何从I(X;X)中准确筛选出I(Y;X)。至于完全保留X的信息,那是难以实现的。因此,本文提出一种新的深度神经网络训练方法,不仅能生成可靠的梯度来更新模型,而且也适用于浅层和轻量级神经网络。

③ PGI

PGI的目的是通过辅助可逆分支(上图中虚线框中的部分)来解决信息瓶颈问题,以便在不增加推理成本的情况下为深度网络提供更可靠的梯度。通过这种设计使得轻量级和浅层的神经网络也可以实现有效的信息保留和准确的梯度更新。

- 主分支:只用于推理的架构,因此不需要任何额外的推理成本。

- 辅助可逆分支:生成可靠的梯度,以供给主分支进行反向传播,以帮助提取正确和重要的信息,并使主分支能够获取更有效的目标任务特征。旨在处理由神经网络加深造成的信息瓶颈问题。辅助可逆分支可以在推理阶段移除。

- 多级辅助信息:控制主分支学习可规划的多级语义信息。旨在处理由深度监督造成的误差累积问题,特别是对于具有多个预测分支的架构和轻量型模型。

4 GELAN

GELAN允许支持多种类型的计算块,这使得它可以更好地适应各种不同的计算需求和硬件约束。

5 实验

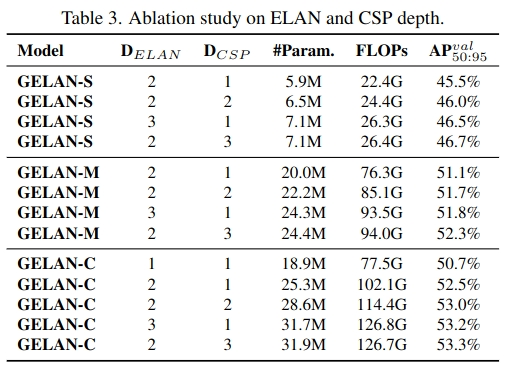

选择CSP-ELAN作为YOLOv9中GELAN的组成单元。

6 可视化

GELAN有更稳定的结果和更清晰的边界信息。

7 结论

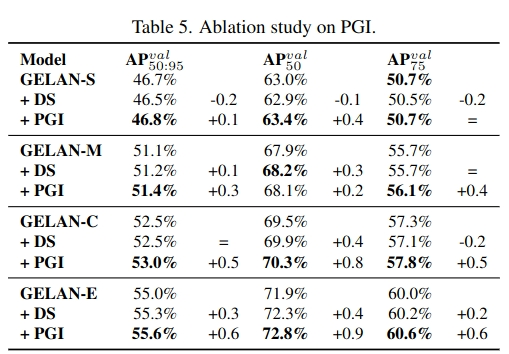

PGI的引入使得轻量级模型和深度模型都能实现精度的显著提升。通过结合PGI和GELAN设计的YOLOv9展现了强大的竞争力。其出色的设计使得深度模型与YOLOv8相比,参数数量减少了49%,计算量减少了43%,但在MS COCO数据集上仍然实现了0.6%的AP提升。