深度神经网络(DNN):原理、应用与代码实践

在人工智能与机器学习的浪潮中,深度神经网络(Deep Neural Network,简称DNN)以其强大的特征学习能力和非线性处理能力,成为解决复杂问题的利器。本文将深入剖析DNN的原理,探讨其在实际应用中的价值,并通过Python代码示例展示如何构建和训练一个DNN模型。

一、深度神经网络(DNN)的基本原理

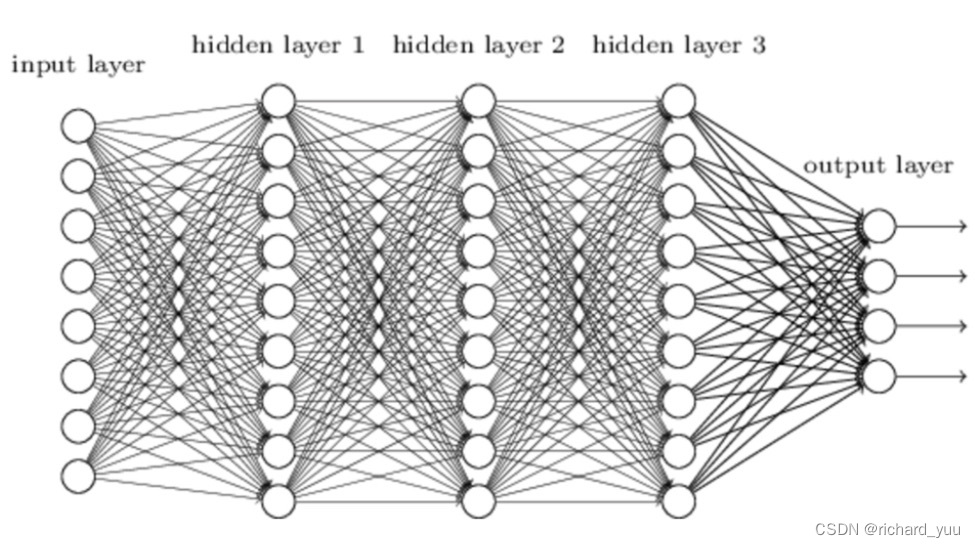

深度神经网络是一种模拟人脑神经网络结构和功能的计算模型。其基本单元是神经元,每个神经元接收来自其他神经元的输入,通过调整权重来改变输入对神经元的影响。神经网络通过多层的非线性隐藏层,可以实现对复杂函数的逼近,达到万能近似的效果。

在DNN中,数据从输入层开始,经过隐藏层的逐层计算,最终到达输出层。每一层神经元的输出都作为下一层神经元的输入,通过激活函数实现非线性变换。DNN的训练过程依赖于反向传播算法和梯度下降算法,通过计算输出层与真实标签之间的误差,并将误差反向传播到每一层神经元,更新神经元的权重和偏置项,以最小化预测误差。

二、DNN的优缺点分析

DNN的优点在于其强大的特征学习能力。相比于传统的手动设计特征方法,DNN可以自动从原始数据中提取有用的特征,大大提高了模型的泛化能力。此外,DNN的高度非线性的特性使其能够处理复杂的非线性关系,在图像识别、语音识别等领域取得了显著成果。

然而,DNN也存在一些缺点。首先,DNN需要大量的参数,这可能导致过拟合问题。过拟合是指模型在训练数据上表现良好,但在新数据上表现较差的现象。为了缓解过拟合,通常需要采用正则化、dropout等技术。其次,DNN的计算量很大,训练时间长,对硬件资源要求较高。最后,DNN的模型解释性较弱,其决策过程往往难以直观理解,这在一定程度上限制了其在某些领域的应用。

三、DNN的代码实践

下面我们将使用Python的Keras库来构建一个简单的深度神经网络模型,并对MNIST手写数字数据集进行分类。

首先,导入必要的库和数据集:

python

import numpy as np

from keras.datasets import mnist

from keras.models import Sequential

from keras.layers import Dense, Dropout, Flatten

from keras.layers import Conv2D, MaxPooling2D

from keras import backend as K

# 输入图像的维度

img_rows, img_cols = 28, 28

num_classes = 10

# 加载MNIST数据集

(x_train, y_train), (x_test, y_test) = mnist.load_data()

if K.image_data_format() == 'channels_first':

x_train = x_train.reshape(x_train.shape[0], 1, img_rows, img_cols)

x_test = x_test.reshape(x_test.shape[0], 1, img_rows, img_cols)

input_shape = (1, img_rows, img_cols)

else:

x_train = x_train.reshape(x_train.shape[0], img_rows, img_cols, 1)

x_test = x_test.reshape(x_test.shape[0], img_rows, img_cols, 1)

input_shape = (img_rows, img_cols, 1)

# 归一化数据

x_train = x_train.astype('float32')

x_test = x_test.astype('float32')

x_train /= 255

x_test /= 255

# 将类向量(整数)转换为二进制类矩阵

y_train = keras.utils.to_categorical(y_train, num_classes)

y_test = keras.utils.to_categorical(y_test, num_classes)

接下来,构建DNN模型:

python

model = Sequential()

model.add(Conv2D(32, kernel_size=(3, 3),

activation='relu',

input_shape=input_shape))

model.add(Conv2D(64, (3, 3), activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.25))

model.add(Flatten())

model.add(Dense(128, activation='relu'))

model.add(Dropout(0.5))

model.add(Dense(num_classes, activation='softmax'))

然后,编译和训练模型:

python

model.compile(loss=keras.losses.categorical_crossentropy,

optimizer=keras.optimizers.Adadelta(),

metrics=['accuracy'])

model.fit(x_train, y_train,

batch_size=128,

epochs=10,

verbose=1,

validation_data=(x_test, y_test))

最后,评估模型性能:

python

score = model.evaluate(x_test, y_test, verbose=0)

print('Test loss:', score[0])

print('Test accuracy:', score[1])

通过上述代码,我们成功构建了一个用于手写数字识别的DNN模型,并通过训练和优化,使其在测试集上达到了较高的准确率。这只是一个简单的示例,实际应用中DNN的结构和参数可能更加复杂,需要根据具体任务进行调整和优化。

四、总结与展望

深度神经网络作为人工智能领域的重要分支,以其强大的特征学习能力和非线性处理能力,为各种复杂问题的解决提供了有力工具。通过本文的介绍和代码实践,我们深入了解了DNN的基本原理、优缺点以及实际应用。随着技术的不断发展,DNN将在更多领域展现出其巨大的潜力,为我们的生活带来更多便利和创新。