Longitudinal Multimodal Transformer Integrating Imaging and Latent Clinical Signatures from Routine EHRs for Pulmonary Nodule Classification

摘要

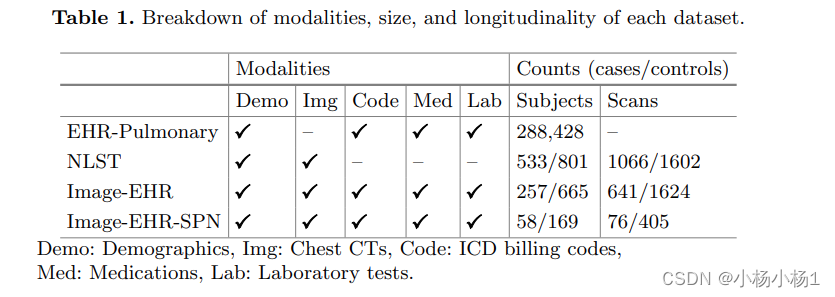

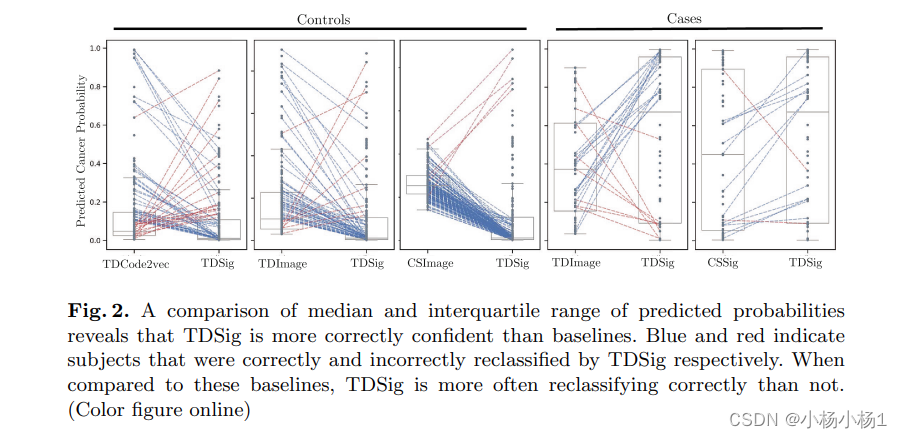

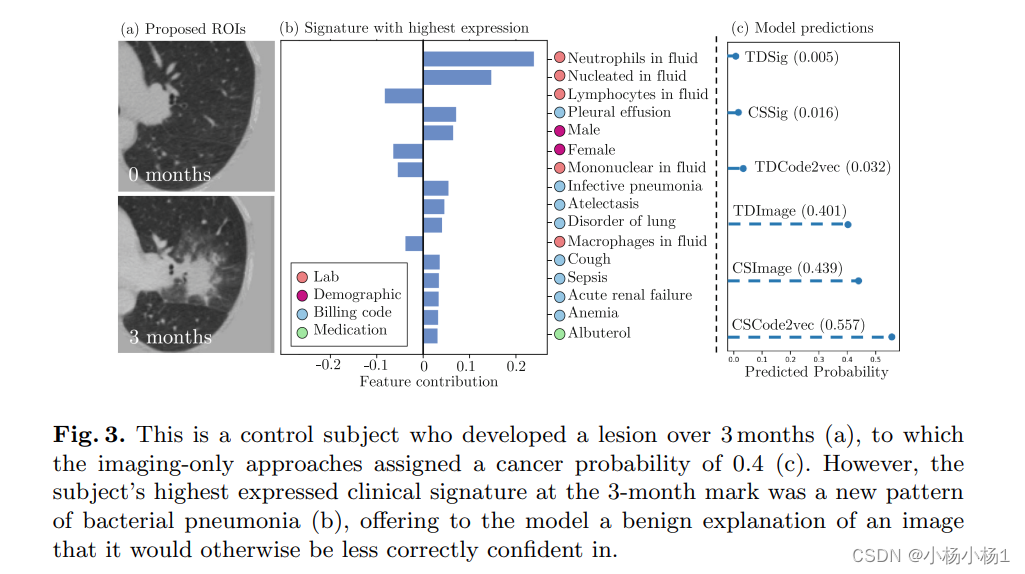

该研究提出了一种基于Transformer 的多模态策略,用于将重复成像与常规电子健康记录(EHRs)中的纵向临床特征整合,以进行孤立性肺结节(SPN)的分类。通过对潜在临床特征进行无监督解缠,并利用时间-距离缩放的自注意力机制,共同学习临床特征的表达和胸部计算机断层扫描(CT)。该分类器在一个公共数据集的2,668个扫描和1,149名具有纵向胸部CT、账单代码、药物和实验室检查的患者的EHRs上进行了预训练。对227名具有具有挑战性的SPN的患者进行评估,结果显示与纵向多模态基线相比,AUC显著提高(0.824 vs 0.752 AUC),并且在单个横截面多模态情景(0.809 AUC)和纵向仅成像情景(0.741 AUC)上也有所改善。这项研究证明了一种新颖方法,在利用Transformer 共同学习纵向成像和非成像表型方面具有显著优势。

代码地址

本文方法

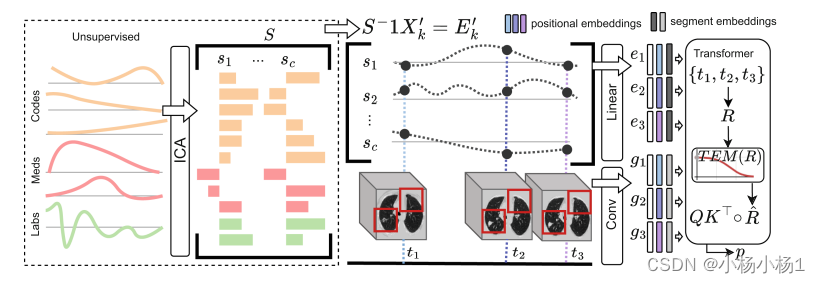

图1。左侧:非成像变量的事件流被转换为纵向曲线。ICA在一个大型的非成像队列上以无监督方式学习独立的潜在标志物S。

右侧:主体k对标志物的表达,Ek,在扫描日期进行采样。输入嵌入是由以下三部分组成的:

1)从标志物或成像中导出的标记嵌入,2)指示标记在序列中位置的固定位置嵌入,以及3)指示成像或非成像模态的可学习片段嵌入。扫描之间的时间间隔用于计算时间距离缩放的自注意力。这是一种灵活的方法,能够处理异步模态、不同序列长度上的不完整性和不规则的时间间隔。

通过概率独立性实现潜在临床特征

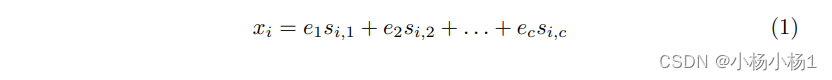

从电子健康记录队列中获取了医疗账单编码、药物和实验室检查的事件数据(长达22年)。删除了少于1000次事件的变量,并将医疗账单编码映射到SNOMED-CT本体后,得到了9195个唯一的变量。将每个变量转换为每天的纵向曲线,估算了每天的变量瞬时值。对连续变量使用了平滑插值,对事件数据使用了每个时间段的事件密度的连续估算。以前的研究使用了高斯过程推理来计算这两种类型的曲线。对于这项工作,我们为了提高计算效率而牺牲了近似值。为了将有限的记忆编码到曲线值中,每个曲线都使用了过去365天的滚动均匀平均值进行平滑处理。我们使用ICA模型来估算从EHR-肺部队列中观察到的曲线到独立的潜在源,即临床签名的线性分解。形式上,我们有数据集DEHR-肺部={Lk | k=1,…,n},其中纵向曲线表示为Lk={li | i=1,…,9195}。我们以三年的分辨率随机采样li ∀i∈[1,9195],并将所有主体的样本连接为xi ∈ Rm。对于DEHR-肺部,经验性地发现m为630037。我们做出了一个简化的假设,即xi是c个潜在来源s的线性混合,具有纵向表达水平e∈Rm。

Longitudinal Multimodal Transformer (TDSig)

将多模态数据集DImage-EHR和DImage-EHR-SPN表示为临床表达Ek = {ek,1,…,ek,T}和图像Gk = {gk,1,…,gk,T}的序列,其中T是最大的序列长度。设定T = 3,并添加了一个固定的填充嵌入来表示序列中的缺失项目。对于序列中的每个项目,计算包含位置和段信息的嵌入。图像的标记嵌入是由一个预训练的SPN检测模型提出的五个连接的3D块的卷积嵌入。我们使用一个16层的ResNet来计算这个嵌入。同样,临床特征表达的标记嵌入是对与图像标记嵌入相同维度的线性变换。然后将嵌入序列通过一个多头变压器进行传递。除了结节检测模型外,所有的嵌入都与变压器一起进行联合优化。我们将这种方法称为TDSig。

时间-距离 自注意力

使用时间重点模型(TEM)来强调最近观察结果的重要性,而不是旧的观察结果。此外,对于填充的嵌入,自注意力被屏蔽,能够适应不同主体之间的序列长度变化。形式上,如果主体k在相对获取的日期t1 …tT有一个长度为T的序列图像,我们构建一个相对时间矩阵R,其中条目Ri,j = |tT − ti|,其中ti是令牌ˆek,i和ˆgk,i的获取日期,或者如果它们是填充的嵌入,则为0。我们使用形式为的TEM将R中的相对时间映射到Rˆ中的[0,1]值:

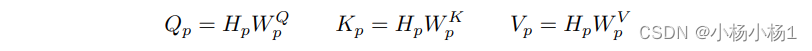

这是一个翻转的sigmoid函数,它随着相对时间从最近观察到现在单调递减。它的下降斜率和下降偏移由可学习的非负参数b和c控制。为每个注意力头实例化了一个单独的TEM,理由是单独的注意力头可以学习以不同的方式对时间进行条件判断。变压器编码器将查询、键和值矩阵计算为输入嵌入H = {Eˆ,Gˆ}的线性变换,其中p为注意力头索引。

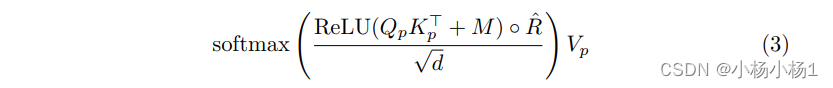

其中 M 是填充掩码,d 是查询和键矩阵的维度。查询键产品的 ReLU 门控允许 TEM 在无符号方向上调整注意力权重

实验结果