准备数据集 :

收集数据 :收集与目标检测任务相关的图像数据集,可以是公开数据集如COCO、Pascal VOC,也可以是自定义数据集。标注数据 :使用标注工具如LabelImg对图像进行标注,将标注结果保存为YOLO格式的文本文件,文件中包含类标签和边界框坐标。 配置环境 :

安装必要的软件,包括Python 3.x、CUDA(用于GPU加速)、CUDNN(用于优化性能),以及相关的Python库如PyTorch、OpenCV。

确保QT开发环境已正确安装和配置。

选择YOLO版本并配置文件 :

根据任务需求选择合适的YOLO版本,如YOLOv3、YOLOv5、YOLOv8等。不同版本的网络架构和性能有所差异。

修改对应的配置文件(.cfg),设置参数,如类别数量、过滤器数量等,以适应自定义数据集和任务。

开始训练 :

运行训练脚本,例如对于YOLOv5,可使用train.py脚本,并指定数据集路径、配置文件路径、训练的轮数(epochs)、批次大小(batch - size)等参数。

监控训练日志,观察损失(loss)和准确率等指标的变化,根据训练进度调整参数,如学习率等。

准备验证数据集 :从原始数据集中划分出一部分数据作为验证集,确保验证集与训练集相互独立,且具有代表性。运行验证测试 :使用训练好的模型对验证集进行测试,计算相关性能指标,如平均精度均值(mAP)、召回率(Recall)、精确率(Precision)等。分析验证结果 :根据性能指标评估模型的泛化能力。如果指标不理想,分析原因,如是否过拟合、欠拟合,是否需要调整模型结构、增加数据量或调整超参数,然后返回训练阶段进行改进。

模型转换(可选) :根据部署平台和需求,可能需要将训练好的模型转换为其他格式,如ONNX格式。例如,对于YOLOv8,可以使用以下代码将模型导出为ONNX格式:

from ultralytics import YOLO

model = YOLO( 'your_model.pt' )

model. export( format = 'onnx' , imgsz= ( 480 , 640 ) , opset= 12 )

在QT中集成模型 :

如果是C++ 项目,可使用OpenCV的DNN模块来加载和运行模型。首先将转换后的模型文件(如ONNX文件)加载到程序中,然后将输入图像进行预处理,如调整大小、归一化等,再将图像输入模型进行推理,得到检测结果。

对于基于PyQt的项目,可以在Python代码中使用相应的YOLO库(如Ultralytics库)加载模型,并进行推理。然后将推理结果传递给QT界面进行展示。

界面设计与交互 :

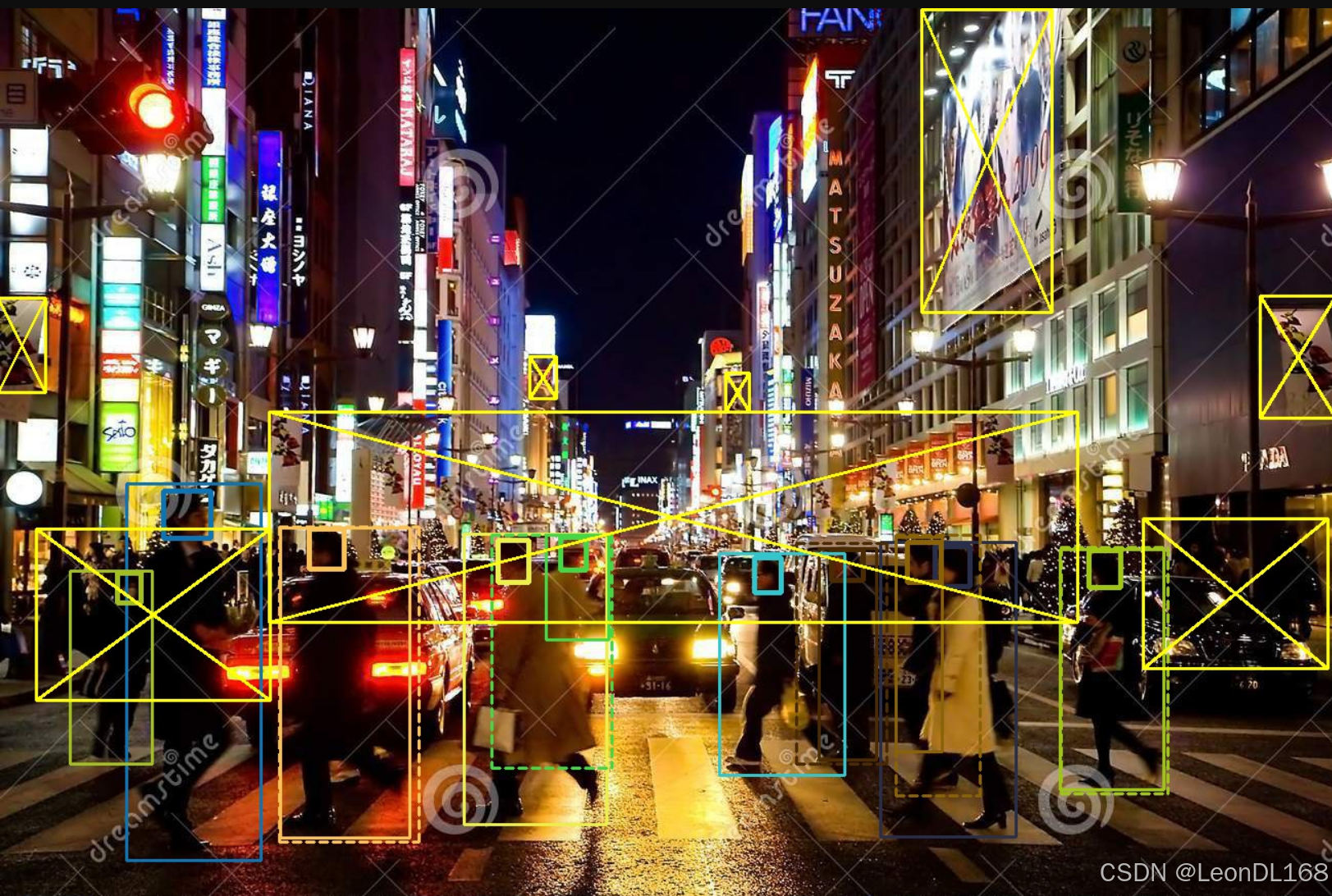

在QT中设计界面,用于显示图像、视频或实时摄像头画面,并在画面上绘制检测到的目标边界框和类别标签。

可以添加按钮、菜单等交互元素,如打开文件按钮用于选择图像或视频文件进行检测,开始/停止按钮用于控制实时检测的启停等。

性能优化 :

在部署过程中,根据目标硬件平台的特点进行性能优化。例如,对于边缘设备,可以考虑模型量化、剪枝等技术来减少模型大小和计算量,提高推理速度。

优化代码实现,减少不必要的计算和内存开销,例如合理使用图像缓存、优化检测算法的执行流程等。