人工神经网络是哪一年由谁提出来的

人工神经网络是1943年,心理学家W.S.McCulloch和数理逻辑学家W.Pitts提出来。

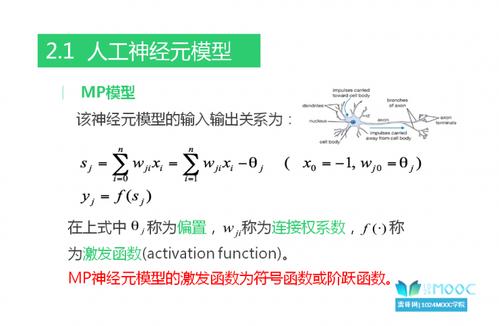

他们通过MP模型提出了神经元的形式化数学描述和网络结构方法,证明了单个神经元能执行逻辑功能,从而开创了人工神经网络研究的时代。1949年,心理学家提出了突触联系强度可变的设想。

60年代,人工神经网络得到了进一步发展,更完善的神经网络模型被提出,其中包括感知器和自适应线性元件等。

M.Minsky等仔细分析了以感知器为代表的神经网络系统的功能及局限后,于1969年出版了《Perceptron》一书,指出感知器不能解决高阶谓词问题。

扩展资料人工神经网络的特点和优越性,主要表现在三个方面:第一,具有自学习功能。

例如实现图像识别时,只在先把许多不同的图像样板和对应的应识别的结果输入人工神经网络,网络就会通过自学习功能,慢慢学会识别类似的图像。自学习功能对于预测有特别重要的意义。

预期未来的人工神经网络计算机将为人类提供经济预测、市场预测、效益预测,其应用前途是很远大的。第二,具有联想存储功能。用人工神经网络的反馈网络就可以实现这种联想。第三,具有高速寻找优化解的能力。

寻找一个复杂问题的优化解,往往需要很大的计算量,利用一个针对某问题而设计的反馈型人工神经网络,发挥计算机的高速运算能力,可能很快找到优化解。

人工智能的发展,主要经历哪几个阶段?

1孕育阶段这个阶段主要是指1956年以前AI爱发猫 www.aifamao.com。

自古以来,人们就一直试图用各种机器来代替人的部分脑力劳动,以提高人们征服自然的能力,其中对人工智能的产生、发展有重大影响的主要研究成果包括:早在公元前384-公元前322年,伟大的哲学家亚里士多德(Aristotle)就在他的名著《工具论》中提出了形式逻辑的一些主要定律,他提出的三段论至今仍是演绎推理的基本依据。

英国哲学家培根(F.Bacon)曾系统地提出了归纳法,还提出了“知识就是力量”的警句。这对于研究人类的思维过程,以及自20世纪70年代人工智能转向以知识为中心的研究都产生了重要影响。

德国数学家和哲学家莱布尼茨(G.W.Leibniz)提出了万能符号和推理计算的思想,他认为可以建立一种通用的符号语言以及在此符号语言上进行推理的演算。

这一思想不仅为数理逻辑的产生和发展奠定了基础,而且是现代机器思维设计思想的萌芽。英国逻辑学家布尔(C.Boole)致力于使思维规律形式化和实现机械化,并创立了布尔代数。

他在《思维法则》一书中首次用符号语言描述了思维活动的基本推理法则。

英国数学家图灵(A.M.Turing)在1936年提出了一种理想计算机的数学模型,即图灵机,为后来电子数字计算机的问世奠定了理论基础。

美国神经生理学家麦克洛奇(W.McCulloch)与匹兹(W.Pitts)在1943年建成了第一个神经网络模型(M-P模型),开创了微观人工智能的研究领域,为后来人工神经网络的研究奠定了基础。

美国爱荷华州立大学的阿塔纳索夫(Atanasoff)教授和他的研究生贝瑞(Berry)在1937年至1941年间开发的世界上第一台电子计算机“阿塔纳索夫-贝瑞计算机(Atanasoff-BerryComputer,ABC)”为人工智能的研究奠定了物质基础。

需要说明的是:世界上第一台计算机不是许多书上所说的由美国的莫克利和埃柯特在1946年发明。这是美国历史上一桩著名的公案。

由上面的发展过程可以看出,人工智能的产生和发展绝不是偶然的,它是科学技术发展的必然产物。2形成阶段这个阶段主要是指1956-1969年。

1956年夏季,由当时达特茅斯大学的年轻数学助教、现任斯坦福大学教授麦卡锡(J.MeCarthy)联合哈佛大学年轻数学和神经学家、麻省理工学院教授明斯基(M.L.Minsky),IBM公司信息研究中心负责人洛切斯特(N.Rochester),贝尔实验室信息部数学研究员香农(C.E.Shannon)共同发起,邀请普林斯顿大学的莫尔(T.Moore)和IBM公司的塞缪尔(A.L.Samuel)、麻省理工学院的塞尔夫里奇(O.Selfridge)和索罗莫夫(R.Solomonff)以及兰德(RAND)公司和卡内基梅隆大学的纽厄尔(A.Newell)、西蒙(H.A.Simon)等在美国达特茅斯大学召开了一次为时两个月的学术研讨会,讨论关于机器智能的问题。

会上经麦卡锡提议正式采用了“人工智能”这一术语。麦卡锡因而被称为人工智能之父。这是一次具有历史意义的重要会议,它标志着人工智能作为一门新兴学科正式诞生了。

此后,美国形成了多个人工智能研究组织,如纽厄尔和西蒙的Carnegie-RAND协作组,明斯基和麦卡锡的MIT研究组,塞缪尔的IBM工程研究组等。

自这次会议之后的10多年间,人工智能的研究在机器学习、定理证明、模式识别、问题求解、专家系统及人工智能语言等方面都取得了许多引人注目的成就,例如:在机器学习方面,1957年Rosenblatt研制成功了感知机。

这是一种将神经元用于识别的系统,它的学习功能引起了广泛的兴趣,推动了连接机制的研究,但人们很快发现了感知机的局限性。

在定理证明方面,美籍华人数理逻辑学家王浩于1958年在IBM-704机器上用3~5min证明了《数学原理》中有关命题演算的全部定理(220条),并且还证明了谓词演算中150条定理的85%,1965年鲁宾逊(J.A.Robinson)提出了归结原理,为定理的机器证明作出了突破性的贡献。

在模式识别方面,1959年塞尔夫里奇推出了一个模式识别程序,1965年罗伯特(Roberts)编制出了可分辨积木构造的程序。

在问题求解方面,1960年纽厄尔等人通过心理学试验总结出了人们求解问题的思维规律,编制了通用问题求解程序(GeneralProblemSolver,GPS),可以用来求解11种不同类型的问题。

在专家系统方面,美国斯坦福大学的费根鲍姆(E.A.Feigenbaum)领导的研究小组自1965年开始专家系统DENDRAL的研究,1968年完成并投入使用。

该专家系统能根据质谱仪的实验,通过分析推理决定化合物的分子结构,其分析能力已接近甚至超过有关化学专家的水平,在美、英等国得到了实际的应用。

该专家系统的研制成功不仅为人们提供了一个实用的专家系统,而且对知识表示、存储、获取、推理及利用等技术是一次非常有益的探索,为以后专家系统的建造树立了榜样,对人工智能的发展产生了深刻的影响,其意义远远超过了系统本身在实用上所创造的价值。

在人工智能语言方面,1960年麦卡锡研制出了人工智能语言(ListProcessing,LISP),成为建造专家系统的重要工具。

1969年成立的国际人工智能联合会议(InternationalJointConferencesOnArtificialIntelligence,IJCAI)是人工智能发展史上一个重要的里程碑,它标志着人工智能这门新兴学科已经得到了世界的肯定和认可。

1970年创刊的国际性人工智能杂志《ArtificialIntelligence》对推动人工智能的发展,促进研究者们的交流起到了重要的作用。3发展阶段这个阶段主要是指1970年以后。

进入20世纪70年代,许多国家都开展了人工智能的研究,涌现了大量的研究成果。

例如,1972年法国马赛大学的科麦瑞尔(A.Comerauer)提出并实现了逻辑程序设计语言PROLOG;斯坦福大学的肖特利夫(E.H.Shorliffe)等人从1972年开始研制用于诊断和治疗感染性疾病的专家系统MYCIN。

但是,和其他新兴学科的发展一样,人工智能的发展道路也不是平坦的。例如,机器翻译的研究没有像人们最初想象的那么容易。当时人们总以为只要一部双向词典及一些词法知识就可以实现两种语言文字间的互译。

后来发现机器翻译远非这么简单。实际上,由机器翻译出来的文字有时会出现十分荒谬的错误。例如,当把“眼不见,心不烦”的英语句子“Outofsight,outofmind”。

翻译成俄语变成“又瞎又疯”;当把“心有余而力不足”的英语句子“Thespiritiswillingbutthefleshisweak”翻译成俄语,然后再翻译回来时竟变成了“Thewineisgoodbutthemeatisspoiled”,即“酒是好的,但肉变质了”;当把“光阴似箭”的英语句子“Timeflieslikeanarrow”翻译成日语,然后再翻译回来的时候,竟变成了“苍蝇喜欢箭”。

由于机器翻译出现的这些问题,1960年美国政府顾问委员会的一份报告裁定:“还不存在通用的科学文本机器翻译,也没有很近的实现前景。”因此,英国、美国当时中断了对大部分机器翻译项目的资助。

在其他方面,如问题求解、神经网络、机器学习等,也都遇到了困难,使人工智能的研究一时陷入了困境。人工智能研究的先驱者们认真反思,总结前一段研究的经验和教训。

1977年费根鲍姆在第五届国际人工智能联合会议上提出了“知识工程”的概念,对以知识为基础的智能系统的研究与建造起到了重要的作用。大多数人接受了费根鲍姆关于以知识为中心展开人工智能研究的观点。

从此,人工智能的研究又迎来了蓬勃发展的以知识为中心的新时期。

这个时期中,专家系统的研究在多种领域中取得了重大突破,各种不同功能、不同类型的专家系统如雨后春笋般地建立起来,产生了巨大的经济效益及社会效益。

例如,地矿勘探专家系统PROSPECTOR拥有15种矿藏知识,能根据岩石标本及地质勘探数据对矿藏资源进行估计和预测,能对矿床分布、储藏量、品位及开采价值进行推断,制定合理的开采方案。

应用该系统成功地找到了超亿美元的钼矿。专家系统MYCIN能识别51种病菌,正确地处理23种抗菌素,可协助医生诊断、治疗细菌感染性血液病,为患者提供最佳处方。

该系统成功地处理了数百个病例,并通过了严格的测试,显示出了较高的医疗水平。美国DEC公司的专家系统XCON能根据用户要求确定计算机的配置。

由专家做这项工作一般需要3小时,而该系统只需要0.5分钟,速度提高了360倍。DEC公司还建立了另外一些专家系统,由此产生的净收益每年超过4000万美元。

信用卡认证辅助决策专家系统AmericanExpress能够防止不应有的损失,据说每年可节省2700万美元左右。

专家系统的成功,使人们越来越清楚地认识到知识是智能的基础,对人工智能的研究必须以知识为中心来进行。

对知识的表示、利用及获取等的研究取得了较大的进展,特别是对不确定性知识的表示与推理取得了突破,建立了主观Bayes理论、确定性理论、证据理论等,对人工智能中模式识别、自然语言理解等领域的发展提供了支持,解决了许多理论及技术上的问题。

人工智能在博弈中的成功应用也举世瞩目。人们对博弈的研究一直抱有极大的兴趣,早在1956年人工智能刚刚作为一门学科问世时,塞缪尔就研制出了跳棋程序。这个程序能从棋谱中学习,也能从下棋实践中提高棋艺。

1959年它击败了塞缪尔本人,1962年又击败了一个州的冠军。

1991年8月在悉尼举行的第12届国际人工智能联合会议上,IBM公司研制的“深思”(DeepThought)计算机系统就与澳大利亚象棋冠军约翰森(D.Johansen)举行了一场人机对抗赛,结果以1:1平局告终。

1957年西蒙曾预测10年内计算机可以击败人类的世界冠军。虽然在10年内没有实现,但40年后深蓝计算机击败国际象棋棋王卡斯帕罗夫(Kasparov),仅仅比预测迟了30年。

1996年2月10日至17日,为了纪念世界上第一台电子计算机诞生50周年,美国IBM公司出巨资邀请国际象棋棋王卡斯帕罗夫与IBM公司的深蓝计算机系统进行了六局的“人机大战”。

这场比赛被人们称为“人脑与电脑的世界决战”。参赛的双方分别代表了人脑和电脑的世界最高水平。当时的深蓝是一台运算速度达每秒1亿次的超级计算机。

第一盘,深蓝就给卡斯帕罗夫一个下马威,赢了这位世界冠军,给世界棋坛以极大的震动。但卡斯帕罗夫总结经验,稳扎稳打,在剩下的五盘中赢三盘,平两盘,最后以总比分4:2获胜。

一年后,即1997年5月3日至11日,深蓝再次挑战卡斯帕罗夫。这时,深蓝是一台拥有32个处理器和强大并行计算能力的RS/6000SP/2的超级计算机,运算速度达每秒2亿次。

计算机里存储了百余年来世界顶尖棋手的棋局,5月3日棋王卡斯帕罗夫首战击败深蓝,5月4日深蓝扳回一盘,之后双方战平三局。

双方的决胜局于5月11日拉开了帷幕,卡斯帕罗夫在这盘比赛中仅仅走了19步便放弃了抵抗,比赛用时只有1小时多一点。这样,深蓝最终以3.5:2.5的总比分赢得这场举世瞩目的“人机大战”的胜利。

深蓝的胜利表明了人工智能所达到的成就。尽管它的棋路还远非真正地对人类思维方式的模拟,但它已经向世人说明,电脑能够以人类远远不能企及的速度和准确性,实现属于人类思维的大量任务。

深蓝精湛的残局战略使观战的国际象棋专家们大为惊讶。卡斯帕罗夫也表示:“这场比赛中有许多新的发现,其中之一就是计算机有时也可以走出人性化的棋步。

在一定程度上,我不能不赞扬这台机器,因为它对盘势因素有着深刻的理解,我认为这是一项杰出的科学成就。”因为这场胜利,IBM的股票升值为180亿美元。

4人工智能的学派根据前面的论述,我们知道要理解人工智能就要研究如何在一般的意义上定义知识,可惜的是,准确定义知识也是个十分复杂的事情。

严格来说,人们最早使用的知识定义是柏拉图在《泰阿泰德篇》中给出的,即“被证实的、真的和被相信的陈述”(Justifiedtruebelief,简称JTB条件)。

然而,这个延续了两千多年的定义在1963年被哲学家盖梯尔否定了。盖梯尔提出了一个著名的悖论(简称“盖梯尔悖论”)。该悖论说明柏拉图给出的知识定文存在严重缺陷。

虽然后来人们给出了很多知识的替代定义,但直到现在仍然没有定论。但关于知识,至少有一点是明确的,那就是知识的基本单位是概念。精通掌握任何一门知识,必须从这门知识的基本概念开始学习。

而知识自身也是一个概念。因此,如何定义一个概念,对于人工智能具有非常重要的意义。

给出一个定义看似简单,实际上是非常难的,因为经常会涉及自指的性质(自指:词性的转化——由谓词性转化为体词性,语义则保持不变)。一旦涉及自指,就会出现非常多的问题,很多的语义悖论都出于概念自指。

自指与转指这一对概念最早出自朱德熙先生的《自指与转指》(《方言》1983年第一期,《朱德熙文集》第三卷)。

陆俭明先生在《八十年代中国语法研究》中(第98页)说:“自指和转指的区别在于,自指单纯是词性的转化-由谓词性转化为体词性,语义则保持不变;转指则不仅词性转化,语义也发生变化,尤指行为动作或性质本身转化为指与行为动作或性质相关的事物。

”举例:①教书的来了(“教书的”是转指,转指教书的“人”);教书的时候要认真(“教书的”语义没变,是自指)。②Unplug一词的原意为“不使用(电源)插座”,是自指;常用来转指为不使用电子乐器的唱歌。

③colored在表示havingcolour(着色)时是自指。colored在表示有色人种时,就是转指。④rich,富有的,是自指。therich,富人,是转指。知识本身也是一个概念。

据此,人工智能的问题就变成了如下三个问题:一、如何定义(或者表示)一个概念、如何学习一个概念、如何应用一个概念。因此对概念进行深人研究就非常必要了。那么,如何定义一个概念呢?

简单起见,这里先讨论最为简单的经典概念。

经典概念的定义由三部分组成:第一部分是概念的符号表示,即概念的名称,说明这个概念叫什么,简称概念名;第二部分是概念的内涵表示,由命题来表示,命题就是能判断真假的陈述句。

第三部分是概念的外延表示,由经典集合来表示,用来说明与概念对应的实际对象是哪些。举一个常见经典概念的例子——素数(primenumber),其内涵表示是一个命题,即只能够被1和自身整除的自然数。

概念有什么作用呢?或者说概念定义的各个组成部分有什么作用呢?经典概念定义的三部分各有作用,且彼此不能互相代替。具体来说,概念有三个作用或功能,要掌握一个概念,必须清楚其三个功能。

第一个功能是概念的指物功能,即指向客观世界的对象,表示客观世界的对象的可观测性。对象的可观测性是指对象对于人或者仪器的知觉感知特性,不依赖于人的主观感受。

举一个《阿Q正传》里的例子:那赵家的狗,何以看我两眼呢?句子中“赵家的狗”应该是指现实世界当中的一条真正的狗。

但概念的指物功能有时不一定能够实现,有些概念其设想存在的对象在现实世界并不存在,例如“鬼”。第二个功能是指心功能,即指向人心智世界里的对象,代表心智世界里的对象表示。

鲁迅有一篇著名的文章《论丧家的资本家的乏走狗》,显然,这个“狗”不是现实世界的狗,只是他心智世界中的狗,即心里的狗(在客观世界,梁实秋先生显然无论如何不是狗)。概念的指心功能一定存在。

如果对于某一个人,一个概念的指心功能没有实现,则该词对于该人不可见,简单地说,该人不理解该概念。最后一个功能是指名功能,即指向认知世界或者符号世界表示对象的符号名称,这些符号名称组成各种语言。

最著名的例子是乔姆斯基的“colorlessgreenideassleepfuriously”,这句话翻译过来是“无色的绿色思想在狂怒地休息”。

这句话没有什么意思,但是完全符合语法,纯粹是在语义符号世界里,即仅仅指向符号世界而已。当然也有另外,“鸳鸯两字怎生书”指的就是“鸳鸯”这两个字组成的名字。

一般情形下,概念的指名功能依赖于不同的语言系统或者符号系统,由人类所创造,属于认知世界。同一个概念在不同的符号系统里,概念名不一定相同,如汉语称“雨”,英语称“rain”。

根据波普尔的三个世界理论,认知世界、物理世界与心理世界虽然相关,但各不相同。因此,一个概念的三个功能虽然彼此相关,也各不相同。

更重要的是,人类文明发展至今,这三个功能不断发展,彼此都越来越复杂,但概念的三个功能并没有改变。

在现实生活中,如果你要了解一个概念,就需要知道这个概念的三个功能:要知道概念的名字,也要知道概念所指的对象(可能是物理世界)。更要在自己的心智世界里具有该概念的形象(或者图像)。

如果只有一个,那是不行的。知道了概念的三个功能之后,就可以理解人工智能的三个学派以及各学派之间的关系。人工智能也是一个概念,而要使一个概念成为现实,自然要实现概念的三个功能。

人工智能的三个学派关注于如何才能让机器具有人工智能,并根据概念的不同功能给出了不同的研究路线。

专注于实现AI指名功能的人工智能学派成为符号主义,专注于实现AI指心功能的人工智能学派称为连接主义,专注于实现AI指物功能的人工智能学派成为行为主义。

1.符号主义符号主义的代表人物是Simon与Newell,他们提出了物理符号系统假设,即只要在符号计算上实现了相应的功能,那么在现实世界就实现了对应的功能,这是智能的充分必要条件。

因此,符号主义认为,只要在机器上是正确的,现实世界就是正确的。说得更通俗一点,指名对了,指物自然正确。在哲学上,关于物理符号系统假设也有一个著名的思想实验——本章1.1.3节中提到的图灵测试。

图灵测试要解决的问题就是如何判断一台机器是否具有智能。图灵测试将智能的表现完全限定在指名功能里。但马少平教授的故事已经说明,只在指名功能里实现了概念的功能,并不能说明一定实现了概念的指物功能。

实际上,根据指名与指物的不同,哲学家约翰·塞尔勒专门设计了一个思想实验用来批判图灵测试,这就是著名的中文屋实验。

中文屋实验明确说明,即使符号主义成功了,这全是符号的计算跟现实世界也不一定搭界,即完全实现指名功能也不见得具有智能。

这是哲学上对符号主义的一个正式批评,明确指出了按照符号主义实现的人工智能不等同于人的智能。虽然如此,符号主义在人工智能研究中依然扮演了重要角色,其早期工作的主要成就体现在机器证明和知识表示上。

在机器证明方面,早期Simon与Newell做出了重要的贡献,王浩、吴文俊等华人也得出了很重要的结果。机器证明以后,符号主义最重要的成就是专家系统和知识工程,最著名的学者就是Feigenbaum。

如果认为沿着这条路就可以实现全部智能,显然存在问题。日本第五代智能机就是沿着知识工程这条路走的,其后来的失败在现在看来是完全合乎逻辑的。实现符号主义面临的观实挑成主要有三个。

第一个是概念的组合爆炸问题。每个人掌握的基本概念大约有5万个,其形成的组合概念却是无穷的。因为常识难以穷尽,推理步骤可以无穷。第二个是命题的组合悖论问题。

两个都是合理的命题,合起来就变成了没法判断真假的句子了,比如著名的柯里悖论(Curry’sParadox)(1942)。第三个也是最难的问题,即经典概念在实际生活当中是很难得到的,知识也难以提取。

上述三个问题成了符号主义发展的瓶颈。

2.连接主义连接主义认为大脑是一切智能的基础,主要关注于大脑神经元及其连接机制,试图发现大脑的结构及其处理信息的机制、揭示人类智能的本质机理,进而在机器上实现相应的模拟。

前面已经指出知识是智能的基础,而概念是知识的基本单元,因此连接主义实际上主要关注于概念的心智表示以及如何在计算机上实现其心智表示,这对应着概念的指心功能。

2016年发表在Nature上的一篇学术论文揭示了大脑语义地图的存在性,文章指出概念都可以在每个脑区找到对应的表示区,确确实实概念的心智表示是存在的。因此,连接主义也有其坚实的物理基础。

连接主义学派的早期代表人物有麦克洛克、皮茨、霍普菲尔德等。按照这条路,连接主义认为可以实现完全的人工智能。对此,哲学家普特南设计了著名的“缸中之脑实验”,可以看作是对连接主义的一个哲学批判。

缸中之脑实验描述如下:一个人(可以假设是你自己)被邪恶科学家进行了手术,脑被切下来并放在存有营养液的缸中。脑的神经末梢被连接在计算机上,同时计算机按照程序向脑传递信息。

对于这个人来说,人、物体、天空都存在,神经感觉等都可以输入,这个大脑还可以被输入、截取记忆,比如截取掉大脑手术的记忆,然后输入他可能经历的各种环境、日常生活,甚至可以被输入代码,“感觉”到自己正在阅读这一段有趣而荒唐的文字。

缸中之脑实验说明即使连接主义实现了,指心没有问题,但指物依然存在严重问题。因此,连接主义实现的人工智能也不等同于人的智能。尽管如此,连接主义仍是目前最为大众所知的一条AI实现路线。

在围棋上,采用了深度学习技术的AlphaGo战胜了李世石,之后又战胜了柯洁。在机器翻译上,深度学习技术已经超过了人的翻译水平。在语音识别和图像识别上,深度学习也已经达到了实用水准。

客观地说,深度学习的研究成就已经取得了工业级的进展。但是,这并不意味着连接主义就可以实现人的智能。更重要的是,即使要实现完全的连接主义,也面临极大的挑战。

到现在为止,人们并不清楚人脑表示概念的机制,也不清楚人脑中概念的具体表示形式表示方式和组合方式等。现在的神经网络与深度学习实际上与人脑的真正机制距离尚远。

3.行为主义行为主义假设智能取决于感知和行动,不需要知识、表示和推理,只需要将智能行为表现出来就好,即只要能实现指物功能就可以认为具有智能了。这一学派的早期代表作是Brooks的六足爬行机器人。

对此,哲学家普特南也设计了一个思想实验,可以看作是对行为主义的哲学批判,这就是“完美伪装者和斯巴达人”。

完美伪装者可以根据外在的需求进行完美的表演,需要哭的时候可以哭得让人撕心裂肺,需要笑的时候可以笑得让人兴高采烈,但是其内心可能始终冷静如常。

斯巴达人则相反,无论其内心是激动万分还是心冷似铁,其外在总是一副泰山崩于前而色不变的表情。完美伪装者和斯巴达人的外在表现都与内心没有联系,这样的智能如何从外在行为进行测试?

因此,行为主义路线实现的人工智能也不等同于人的智能。对于行为主义路线,其面临的最大实现困难可以用莫拉维克悖论来说明。

所谓莫拉维克悖论,是指对计算机来说困难的问题是简单的、简单的问题是困难的,最难以复制的反而是人类技能中那些无意识的技能。目前,模拟人类的行动技能面临很大挑战。

比如,在网上看到波士顿动力公司人形机器人可以做高难度的后空翻动作,大狗机器人可以在任何地形负重前行,其行动能力似乎非常强。但是这些机器人都有一个大的缺点一能耗过高、噪音过大。

大狗机器人原是美国军方订购的产品,但因为大狗机器人开动时的声音在十里之外都能听到,大大提高了其成为一个活靶子的可能性,使其在战场上几乎没有实用价值,美国军方最终放弃了采购。

人工神经网络的发展历史

1943年,心理学家W.S.McCulloch和数理逻辑学家W.Pitts建立了神经网络和数学模型,称为MP模型。

他们通过MP模型提出了神经元的形式化数学描述和网络结构方法,证明了单个神经元能执行逻辑功能,从而开创了人工神经网络研究的时代。1949年,心理学家提出了突触联系强度可变的设想。

60年代,人工神经网络得到了进一步发展,更完善的神经网络模型被提出,其中包括感知器和自适应线性元件等。

M.Minsky等仔细分析了以感知器为代表的神经网络系统的功能及局限后,于1969年出版了《Perceptron》一书,指出感知器不能解决高阶谓词问题。

他们的论点极大地影响了神经网络的研究,加之当时串行计算机和人工智能所取得的成就,掩盖了发展新型计算机和人工智能新途径的必要性和迫切性,使人工神经网络的研究处于低潮。

在此期间,一些人工神经网络的研究者仍然致力于这一研究,提出了适应谐振理论(ART网)、自组织映射、认知机网络,同时进行了神经网络数学理论的研究。以上研究为神经网络的研究和发展奠定了基础。

1982年,美国加州工学院物理学家J.J.Hopfield提出了Hopfield神经网格模型,引入了“计算能量”概念,给出了网络稳定性判断。

1984年,他又提出了连续时间Hopfield神经网络模型,为神经计算机的研究做了开拓性的工作,开创了神经网络用于联想记忆和优化计算的新途径,有力地推动了神经网络的研究,1985年,又有学者提出了波耳兹曼模型,在学习中采用统计热力学模拟退火技术,保证整个系统趋于全局稳定点。

1986年进行认知微观结构地研究,提出了并行分布处理的理论。1986年,Rumelhart,Hinton,Williams发展了BP算法。

Rumelhart和McClelland出版了《Paralleldistributionprocessing:explorationsinthemicrostructuresofcognition》。

迄今,BP算法已被用于解决大量实际问题。1988年,Linsker对感知机网络提出了新的自组织理论,并在Shanon信息论的基础上形成了最大互信息理论,从而点燃了基于NN的信息应用理论的光芒。

1988年,Broomhead和Lowe用径向基函数(Radialbasisfunction,RBF)提出分层网络的设计方法,从而将NN的设计与数值分析和线性适应滤波相挂钩。

90年代初,Vapnik等提出了支持向量机(Supportvectormachines,SVM)和VC(Vapnik-Chervonenkis)维数的概念。

人工神经网络的研究受到了各个发达国家的重视,美国国会通过决议将1990年1月5日开始的十年定为“脑的十年”,国际研究组织号召它的成员国将“脑的十年”变为全球行为。

在日本的“真实世界计算(RWC)”项目中,人工智能的研究成了一个重要的组成部分。

人工神经元的基本构成

人脑的神经元模型如图8.6所示。图中一个神经元由细胞核、一个轴突、多个树突、突触组成。生物电信号从树突传入,经过细胞核处理,从轴突输出一个电脉冲信号。

神经元通过树突与轴突之间的突触与其他神经元相连构成一个复杂的大规模并行网络。

图8.6人脑的神经元模型[8]1943年心理学家McCulloch和数学家Pitt将生物模型抽象化,建立了人工神经网络的数学模型——MP模型,如图8.7所示。

图8.7人工神经元模型[8]该人工神经元具有以下6点特征:(1)每个神经元是一个多输入单输出单元;(2)突触分兴奋和抑制两种;(3)神经元有空间整合性和阀值;(4)神经元的输入输出有固定的时间滞后,主要取决于突触延搁;(5)忽略时间整合及不应期;(6)神经元是非时变的,即突触延时和突触强度均为常数。

显然,上述假定是对生物神经元信息处理过程的简化和概括。

以上内容可以由式(8.25)进行抽象和概括:地球物理反演教程其中:xi(t)表示t时刻神经元j接受到来自神经元i的信息输入;oj(t)表示t时刻神经元j的输出;τij为输入输出间的突触时延;Tj为神经元j的阀值;wij为神经元i到神经元j的突触连接系数或权值;f{}为神经元的转移函数,有时又称激励函数。

为简单起见,将上式中的突触时延取为单位时间,则式(8.25)变为地球物理反演教程上式描述的神经元数学模型全面表达了神经元模型的6点假设。xi(t)有多个,而oj(t)只有一个,体现了“多输入单输出”。

权重值wij的正负体现了“突触的兴奋和抑制”。输入总和net'j(t)称为神经元在t时刻的净输入:地球物理反演教程上式体现了神经元j的“空间整合性”而忽略了“时间整合作用和不应期”。

当net'j(t)-Tj>0时,神经元才被激活。oj(t+1)与xi(t)的单位时间差代表所有神经元具有相同的、恒定的工作节律,对应于“突触延搁”。wij与时间无关,体现了“非时变”。

BP神经网络的起源学说

人工神经元的研究起源于脑神经元学说。19世纪末,在生物、生理学领域,Waldeger等人创建了神经元学说。人们认识到复杂的神经系统是由数目繁多的神经元组合而成。

大脑皮层包括有100亿个以上的神经元,每立方毫米约有数万个,它们互相联结形成神经网络,通过感觉器官和神经接受来自身体内外的各种信息,传递至中枢神经系统内,经过对信息的分析和综合,再通过运动神经发出控制信息,以此来实现机体与内外环境的联系,协调全身的各种机能活动。

人工神经网络是由大量的简单基本元件——神经元相互联接而成的自适应非线性动态系统。每个神经元的结构和功能比较简单,但大量神经元组合产生的系统行为却非常复杂。

人工神经网络反映了人脑功能的若干基本特性,但并非生物系统的逼真描述,只是某种模仿、简化和抽象。

与数字计算机比较,人工神经网络在构成原理和功能特点等方面更加接近人脑,它不是按给定的程序一步一步地执行运算,而是能够自身适应环境、总结规律、完成某种运算、识别或过程控制。

神经元也和其他类型的细胞一样,包括有细胞膜、细胞质和细胞核。但是神经细胞的形态比较特殊,具有许多突起,因此又分为细胞体、轴突和树突三部分。细胞体内有细胞核,突起的作用是传递信息。

树突是作为引入输入信号的突起,而轴突是作为输出端的突起,它只有一个。若从速度的角度出发,人脑神经元之间传递信息的速度要远低于计算机,前者为毫秒量级,而后者的频率往往可达几百兆赫。

但是,由于人脑是一个大规模并行与串行组合处理系统,因而,在许多问题上可以作出快速判断、决策和处理,其速度则远高于串行结构的普通计算机。

人工神经网络的基本结构模仿人脑,具有并行处理特征,可以大大提高工作速度。

利用突触效能的变化来调整存贮内容人脑存贮信息的特点为利用突触效能的变化来调整存贮内容,也即信息存贮在神经元之间连接强度的分布上,存贮区与计算机区合为一体。

虽然人脑每日有大量神经细胞死亡(平均每小时约一千个),但不影响大脑的正常思维活动。

普通计算机是具有相互独立的存贮器和运算器,知识存贮与数据运算互不相关,只有通过人编出的程序使之沟通,这种沟通不能超越程序编制者的预想。元器件的局部损坏及程序中的微小错误都可能引起严重的失常。

人类大脑有很强的自适应与自组织特性,后天的学习与训练可以开发许多各具特色的活动功能。如盲人的听觉和触觉非常灵敏;聋哑人善于运用手势;训练有素的运动员可以表现出非凡的运动技巧等等。

普通计算机的功能取决于程序中给出的知识和能力。显然,对于智能活动要通过总结编制程序将十分困难。

有人可以介绍一下什么是"神经网络"吗?

由于神经网络是多学科交叉的产物,各个相关的学科领域对神经网络都有各自的看法,因此,关于神经网络的定义,在科学界存在许多不同的见解。

目前使用得最广泛的是T.Koholen的定义,即"神经网络是由具有适应性的简单单元组成的广泛并行互连的网络,它的组织能够模拟生物神经系统对真实世界物体所作出的交互反应。

"如果我们将人脑神经信息活动的特点与现行冯·诺依曼计算机的工作方式进行比较,就可以看出人脑具有以下鲜明特征:1.巨量并行性。

在冯·诺依曼机中,信息处理的方式是集中、串行的,即所有的程序指令都必须调到CPU中后再一条一条地执行。而人在识别一幅图像或作出一项决策时,存在于脑中的多方面的知识和经验会同时并发作用以迅速作出解答。

据研究,人脑中约有多达10^(10)~10^(11)数量级的神经元,每一个神经元具有103数量级的连接,这就提供了巨大的存储容量,在需要时能以很高的反应速度作出判断。

2.信息处理和存储单元结合在一起。在冯·诺依曼机中,存储内容和存储地址是分开的,必须先找出存储器的地址,然后才能查出所存储的内容。一旦存储器发生了硬件故障,存储器中存储的所有信息就都将受到毁坏。

而人脑神经元既有信息处理能力又有存储功能,所以它在进行回忆时不仅不用先找存储地址再调出所存内容,而且可以由一部分内容恢复全部内容。

当发生"硬件"故障(例如头部受伤)时,并不是所有存储的信息都失效,而是仅有被损坏得最严重的那部分信息丢失。3.自组织自学习功能。

冯·诺依曼机没有主动学习能力和自适应能力,它只能不折不扣地按照人们已经编制好的程序步骤来进行相应的数值计算或逻辑计算。

而人脑能够通过内部自组织、自学习的能力,不断地适应外界环境,从而可以有效地处理各种模拟的、模糊的或随机的问题。神经网络研究的主要发展过程大致可分为四个阶段:1.第一阶段是在五十年代中期之前。

西班牙解剖学家Cajal于十九世纪末创立了神经元学说,该学说认为神经元的形状呈两极,其细胞体和树突从其他神经元接受冲动,而轴索则将信号向远离细胞体的方向传递。

在他之后发明的各种染色技术和微电极技术不断提供了有关神经元的主要特征及其电学性质。

1943年,美国的心理学家W.S.McCulloch和数学家W.A.Pitts在论文《神经活动中所蕴含思想的逻辑活动》中,提出了一个非常简单的神经元模型,即M-P模型。

该模型将神经元当作一个功能逻辑器件来对待,从而开创了神经网络模型的理论研究。

1949年,心理学家D.O.Hebb写了一本题为《行为的组织》的书,在这本书中他提出了神经元之间连接强度变化的规则,即后来所谓的Hebb学习法则。

Hebb写道:"当神经细胞A的轴突足够靠近细胞B并能使之兴奋时,如果A重复或持续地激发B,那么这两个细胞或其中一个细胞上必然有某种生长或代谢过程上的变化,这种变化使A激活B的效率有所增加。

"简单地说,就是如果两个神经元都处于兴奋状态,那么它们之间的突触连接强度将会得到增强。

五十年代初,生理学家Hodykin和数学家Huxley在研究神经细胞膜等效电路时,将膜上离子的迁移变化分别等效为可变的Na+电阻和K+电阻,从而建立了著名的Hodykin-Huxley方程。

这些先驱者的工作激发了许多学者从事这一领域的研究,从而为神经计算的出现打下了基础。2.第二阶段从五十年代中期到六十年代末。

1958年,F.Rosenblatt等人研制出了历史上第一个具有学习型神经网络特点的模式识别装置,即代号为MarkI的感知机(Perceptron),这一重大事件是神经网络研究进入第二阶段的标志。

对于最简单的没有中间层的感知机,Rosenblatt证明了一种学习算法的收敛性,这种学习算法通过迭代地改变连接权来使网络执行预期的计算。

稍后于Rosenblatt,B.Widrow等人创造出了一种不同类型的会学习的神经网络处理单元,即自适应线性元件Adaline,并且还为Adaline找出了一种有力的学习规则,这个规则至今仍被广泛应用。

Widrow还建立了第一家神经计算机硬件公司,并在六十年代中期实际生产商用神经计算机和神经计算机软件。

除Rosenblatt和Widrow外,在这个阶段还有许多人在神经计算的结构和实现思想方面作出了很大的贡献。例如,K.Steinbuch研究了称为学习矩阵的一种二进制联想网络结构及其硬件实现。

N.Nilsson于1965年出版的《机器学习》一书对这一时期的活动作了总结。3.第三阶段从六十年代末到八十年代初。

第三阶段开始的标志是1969年M.Minsky和S.Papert所著的《感知机》一书的出版。

该书对单层神经网络进行了深入分析,并且从数学上证明了这种网络功能有限,甚至不能解决象"异或"这样的简单逻辑运算问题。同时,他们还发现有许多模式是不能用单层网络训练的,而多层网络是否可行还很值得怀疑。

由于M.Minsky在人工智能领域中的巨大威望,他在论著中作出的悲观结论给当时神经网络沿感知机方向的研究泼了一盆冷水。

在《感知机》一书出版后,美国联邦基金有15年之久没有资助神经网络方面的研究工作,前苏联也取消了几项有前途的研究计划。

但是,即使在这个低潮期里,仍有一些研究者继续从事神经网络的研究工作,如美国波士顿大学的S.Grossberg、芬兰赫尔辛基技术大学的T.Kohonen以及日本东京大学的甘利俊一等人。

他们坚持不懈的工作为神经网络研究的复兴开辟了道路。4.第四阶段从八十年代初至今。

1982年,美国加州理工学院的生物物理学家J.J.Hopfield采用全互连型神经网络模型,利用所定义的计算能量函数,成功地求解了计算复杂度为NP完全型的旅行商问题(TravellingSalesmanProblem,简称TSP)。

这项突破性进展标志着神经网络方面的研究进入了第四阶段,也是蓬勃发展的阶段。Hopfield模型提出后,许多研究者力图扩展该模型,使之更接近人脑的功能特性。

1983年,T.Sejnowski和G.Hinton提出了"隐单元"的概念,并且研制出了Boltzmann机。

日本的福岛邦房在Rosenblatt的感知机的基础上,增加隐层单元,构造出了可以实现联想学习的"认知机"。Kohonen应用3000个阈器件构造神经网络实现了二维网络的联想式学习功能。

1986年,D.Rumelhart和J.McClelland出版了具有轰动性的著作《并行分布处理-认知微结构的探索》,该书的问世宣告神经网络的研究进入了高潮。

1987年,首届国际神经网络大会在圣地亚哥召开,国际神经网络联合会(INNS)成立。

随后INNS创办了刊物《JournalNeuralNetworks》,其他专业杂志如《NeuralComputation》,《IEEETransactionsonNeuralNetworks》,《InternationalJournalofNeuralSystems》等也纷纷问世。

世界上许多著名大学相继宣布成立神经计算研究所并制订有关教育计划,许多国家也陆续成立了神经网络学会,并召开了多种地区性、国际性会议,优秀论著、重大成果不断涌现。

今天,在经过多年的准备与探索之后,神经网络的研究工作已进入了决定性的阶段。日本、美国及西欧各国均制订了有关的研究规划。日本制订了一个"人类前沿科学计划"。

这项计划为期15-20年,仅初期投资就超过了1万亿日元。在该计划中,神经网络和脑功能的研究占有重要地位,因为所谓"人类前沿科学"首先指的就是有关人类大脑以及通过借鉴人脑而研制新一代计算机的科学领域。

在美国,神经网络的研究得到了军方的强有力的支持。美国国防部投资4亿美元,由国防部高级研究计划局(DAPRA)制订了一个8年研究计划,并成立了相应的组织和指导委员会。

同时,海军研究办公室(ONR)、空军科研办公室(AFOSR)等也纷纷投入巨额资金进行神经网络的研究。DARPA认为神经网络"看来是解决机器智能的唯一希望",并认为"这是一项比原子弹工程更重要的技术"。

美国国家科学基金会(NSF)、国家航空航天局(NASA)等政府机构对神经网络的发展也都非常重视,它们以不同的形式支持了众多的研究课题。欧共体也制订了相应的研究计划。

在其ESPRIT计划中,就有一个项目是"神经网络在欧洲工业中的应用",除了英、德两国的原子能机构外,还有多个欧洲大公司卷进这个研究项目,如英国航天航空公司、德国西门子公司等。

此外,西欧一些国家还有自己的研究计划,如德国从1988年就开始进行一个叫作"神经信息论"的研究计划。我国从1986年开始,先后召开了多次非正式的神经网络研讨会。

1990年12月,由中国计算机学会、电子学会、人工智能学会、自动化学会、通信学会、物理学会、生物物理学会和心理学会等八个学会联合在北京召开了"中国神经网络首届学术会议",从而开创了我国神经网络研究的新纪元。